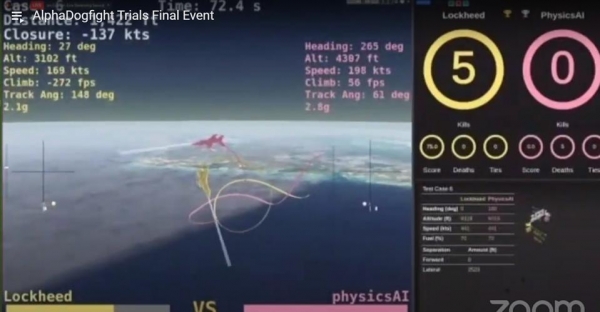

AI在空中缠斗对抗中5:0大胜人类飞行员?

图:DARPA的“Dogfight”空中缠斗视图,可模拟F-16飞行员与人工智能之间的对抗较量。右侧五比零的比分分外显眼。

代理“Heron”。

Heron公司诞生于上世纪九十年代初,总部位于加利福尼亚的NAS Patuxent River海军飞行测试中心附近。该公司专门开发用于AI场景的自动代理与多代理系统算法。Heron的AI代理,曾经通过多次模拟AlphaDogfight,与约翰霍普金斯大学应用物理实验室和一些大企业的AI解决方案较量,在一一击败各AI对手之后,赢得了此次与F-16人类飞行员正面交锋的机会。

Heron的发展之路可谓是踏血前行,先后击败了包括Aurora Flight Sciences、EpiSys Science、乔治亚理工学院、洛克希德·马丁、Perspecta Labs、PhysicsAI以及SoarTech等多位强劲对手。

此次胜利,标志着这家私营公司再下一城。凭借在DARPA试验性演习与更大规模的空战演进(ACE)项目中的出色表现,这家企业的前途可谓一片光明。

DARPA方面表示,此次AlphaDogfight演习在YouTube等频道上吸引了超过5000位观众,包括全球各敌对国家。不过,ACE项目负责人、美国空军上校Dan “Animal” Javorsek仍然以更中肯的立场,探讨了AI代理的胜利与模拟场景的局限性,以提醒大家,应该在比分之外以更客观的态度看待这样的结果。

在提到Twitter上大量散布的、关于人类战场终结论的观点时,Javorsek不禁笑了起来。他强调,空中缠斗AI的最大价值,在于压制敌对方在战场上建立威胁的能力。

“只要我们能够让无人系统像具有智能、且富有创造力的实体那样,表现出更多的行为、外观与模式,就能给敌对手带来更多麻烦。”

他也承认,AI代理在此次缠斗模拟中确实带来了令人印象深刻的表现,而且极具发展潜力。但问题在于,AI本身很可能受到攻击,甚至可能是在飞机起飞之前就,已经被敌对方渗透。

作为此次演习中的人类一方,F-16飞行员Banger表示,他确实对缠斗算法产生了信任,特别是在观察到对方表现出“精细运动”(以及据此做出的机动判断)、迅速决策以及瞄准能力之后。

“AI不会受到人类训练环境里种种规则与约束的影响。因此,大家可以看到AI操纵的固有优势,包括使用更精细的瞄准技术,并完美消化各项提示信息等。但除此之外,AI与我们在常规模拟演习中看到的人类对手已经非常相似。”

尽管AI的学习能力很强,但Banger的成长速度也不慢。随着对抗的进行,他已经找到了压制AI飞行员的技巧。在针对算法的第五局对战中,他采用了新的方法,开始模仿AI的作战思路。

“在第三轮与第四轮对抗中,我一直在努力维持自己当前的位置优势。这是个错误,AI借此抓住了机会。在第五局中,我开始适应AI的战斗思路,跟着它爬升以拉近两架飞机之间的距离。以往我很少会这么做,但现在我得做出改变,因为我的对手已经有所区别。我得逼着它犯错。”

Javorsek上校断言,未来人类与自主系统之间的比例将产生明确区分——要么是少数人管理大量自主系统,要么是很多人管理同一套自主系统。此次AlphaDogfight演习中总结的经验,将帮助美军继续在这条道路上摸索前进。

当然,这一切的基础在于信任。通过此次演习,Javorsek上校认为,建立信任的目标已经初步达成。

“只要我们能说服哪怕几位飞行员,让他们观看Heron自主代理的实际表现,并承认其确实拥有良好的智能、足以在高度动态的场景下做出正确的决定,那我认为这次演习就已经达到了目的。”

Banger肯定道,“必须承认,在经历了这场比赛之后,我完全相信,AI有能力执行精细的操作并实施杀伤性打击。”

ACE项目的下一步,自然就是将AI代理整合至现实环境中的小型飞行设备,并最终将其添加到全尺寸战斗机当中。Javorsek上榜估计,这项工作可能“要十多年后,甚至是二十年后才会完成。这还是在技术已经完全准备就绪的前提下,但目前技术显然还不够成熟。”

▲ 图:DARPA讲解员在AlphaDogfight演习中进行实况转播

单是将AI代理转换为自动驾驶战机,就可能需要十多年的时间。ACE项目还提出了其他更为严苛的发展目标,包括将AI代理在一对一缠斗中表现出的“本地作战自主能力”推广到两架/多架战机、甚至是小型战术编队上,借此实现团队战术行为。

“我们的目标是,通过多机操作行为,将我们积累到的战斗经验扩展到更具全局视角的战场环境当中。”

好文章,需要你的鼓励

-

从“互联”到“智联”:荣耀MagicOS 10如何用“自进化”重构人机关系?

过去十年,终端厂商比拼的是“性能”和“参数”,如今,竞争的焦点正转向“智能程度”。

-

让AI学会深度搜索:Fractal AI Research实验室开发出能像侦探一样追踪真相的智能助手

Fractal AI Research实验室开发了Fathom-DeepResearch智能搜索系统,该系统由两个4B参数模型组成,能够进行20多轮深度网络搜索并生成结构化报告。研究团队创新了DUETQA数据集、RAPO训练方法和认知行为奖励机制,解决了AI搜索中的浅层化、重复性和缺乏综合能力等问题,在多项基准测试中显著超越现有开源系统,为AI助手向专业研究工具转变奠定了基础。

-

快手科技重磅突破:AI语言模型训练的"权重平衡术"让机器学习更聪明

快手科技与清华大学合作发现当前AI语言模型训练中存在严重的权重分配不平衡问题,提出了非对称重要性采样策略优化(ASPO)方法。该方法通过翻转正面样本的重要性权重,让模型把更多注意力放在需要改进的部分而非已经表现良好的部分,显著提升了数学推理和编程任务的性能,并改善了训练稳定性。