高通专用AI芯片的竞争格局分析

去年,高通大事宣传Cloud AI 100,并承诺它具有强大的性能和能效,可以在边缘计算、自动驾驶汽车和5G基础设施中实现人工智能。今天,高通宣布现在正对该平台进行采样,并计划于2021年上半年实现批量出货。

这就引出了一个问题:为什么一家以低功耗手机芯片和IP闻名的公司决定进入数据中心市场?要知道那个市场里已经有不少拥有几十年历史的老玩家了。

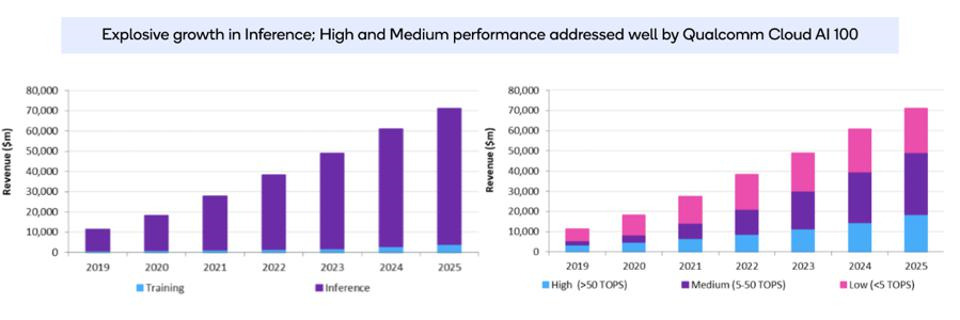

高通长期以来一直关注数据中心解决方案,认为该行业有吸引力的增长和利润率是增加收入的潜在来源。它的电源效率和性能方案非常适合扩展到数据中心产品,而人工智能的爆炸式增长是一个理想的切入点。此外,高通5G调制解调器和Snapdragon应用处理器可以帮助该公司构建完整的解决方案,从而避免与仅有人工智能 SoC的、规模较小的公司正面进行价格战。高通估计,到2025年,用于人工智能推理处理的SAM可能超过700亿美元,其中约500亿美元在Cloud AI 100的目标市场空间中。

▲图1: Cloud AI100瞄准了中高性能应用的高利润细分市场

高通宣布了什么?

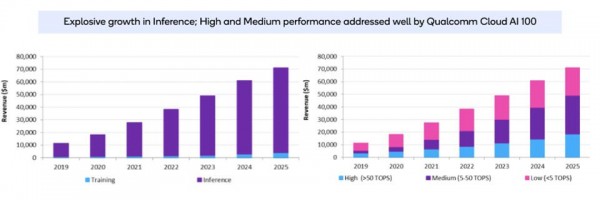

除了宣布生产时间表外,高通还分享了AI 100芯片及其打算出售的交付平台的技术细节和一些规格参数。高通计划提供一系列设备,包括一个仅消耗15瓦TDP的70 TOPS M.2边缘卡,一个以25W功率运行的200 TOPS M.2卡以及一个数据中心级PCIe平台,能够提供400 TOPS的性能,功耗仅为75W,能效高达8 TOPS/Watt。

▲图2: 新的Cloud AI 100和Edge AI开发套件产品简介

高通还展示了新的5G开发套件,该套件计划于下个月上市。新的Cloud Edge AI开发套件伴随的是高通的X55 5G调制解调器-RF系统和顶级Snapdragon 865处理器。想了解有关该套件的更多规格信息,请参见图2。

竞争格局

英特尔至强系列处理器在人工智能推理市场上占据着主导地位,但是随着人工智能模型变得越来越复杂,这种情况正在发生变化。行业组织ai.org估计,人工智能模型的大小每3.5个月翻一番。这为英伟达之类的公司以及数十家初创企业创造了满足这些计算要求的机会。尽管高通并没有将Blaize和Tenstorrent的最新公告纳入其中。就是说,Cloud AI100看起来在该领域具有领先优势,在Resnet50模型上可以每秒处理约25,000张图片,而功耗只需要75W。我要指出,Resnet50是一个很小的基准,尤其是与谷歌的BERT等自然语言处理模型相比的时候更是如此。但是,在相同基准下,Cloud AI 100 M2的每瓦性能大约是前“推理之王”——英特尔Goya的每瓦性能的四倍,这仍然令人印象深刻。

▲图3:高通提供的ResNet-50 Benchmark结果分析

在谈到更大、更复杂的模型时,高通显然预计需要更多的内存。该芯片的144MB片上SRAM补充了PCIe卡上高达32 GB的LPDDR4。此外,该芯片还支持一系列数字精度,包括8位和16位整数以及16位和32位浮点数学运算。

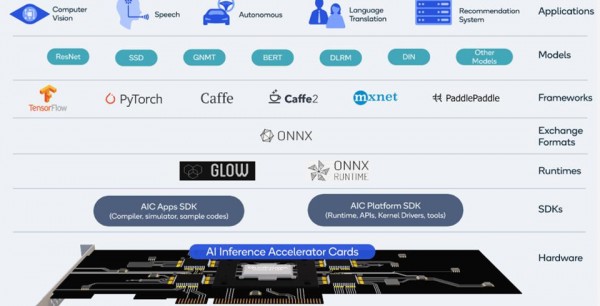

至于软件,通常会是人工智能初创企业的致命弱点,Cloud AI 100充分利用了高通丰富的移动推理生态系统,并且已经提供了完整的框架和优化工具库。

▲图4:新AI芯片配备完整的软件堆栈是非常不寻常的,但是高通Snapdragon为Cloud AI 100铺平了道路

人工智能芯片的“寒武纪生命大爆炸”(Cambrian Explosion)持续不断,随着此次的新闻发布,新的重量级竞争者出现了。如果高通宣布的400 TOPS性能得到了证实,那这就将是我见过的、最快的用于推理处理的芯片。也就是说,我们将不得不等待GROQ的正式官宣,表明它的产品可能处于同一性能水平,但是功率却要大得多,而Tenstorrent在最近的HotChips会议上提出了一些有趣的人工智能方法。此外,我们仍然在等待英特尔和SambaNova等公司的详细信息。我也非常有兴趣获得更多NVIDIA A100在多实例GPU功能方面的性能数据,该功能可以在七个推理实例上分摊大型GPU的成本和功能。我相信这种方法在数据中心具有巨大的潜力。

除了规格之外,我相信许多客户会选择与一家老牌半导体公司(例如高通)而不是与一家初创公司进行业务往来——除非年轻的公司能够提供好得多的性能和效率。高通凭借着多年在Snapdragon上的经验,为人工智能推理处理提供了坚实的质量、性能、效率、支持和完善的软件生态系统。这是一个强大的前提,我期待看到更多的基准测试结果。让这场“寒武纪生命大爆炸”继续下去吧!

好文章,需要你的鼓励

-

利用大语言模型探索科学创新前沿:南洋理工大学团队开发检测学术新颖性的突破性方法

这项研究利用大语言模型解决科学新颖性检测难题,南洋理工大学团队创新性地构建了闭合领域数据集并提出知识蒸馏框架,训练轻量级检索器捕捉想法层面相似性而非表面文本相似性。实验表明,该方法在市场营销和NLP领域显著优于现有技术,为加速科学创新提供了有力工具。

-

un?CLIP:通过反转unCLIP来提升CLIP模型的视觉细节捕捉能力

un?CLIP是一项创新研究,通过巧妙反转unCLIP生成模型来增强CLIP的视觉细节捕捉能力。中国科学院研究团队发现,虽然CLIP在全局图像理解方面表现出色,但在捕捉细节时存在不足。他们的方法利用unCLIP生成模型的视觉细节表示能力,同时保持与CLIP原始文本编码器的语义对齐。实验结果表明,un?CLIP在MMVP-VLM基准、开放词汇语义分割和视觉中心的多模态任务上显著优于原始CLIP和现有改进方法,为视觉-语言模型的发展提供了新思路。

-

角色扮演能力大考验:里尔大学研究团队开发的大语言模型角色扮演评估新标准

这项研究介绍了RPEval,一个专为评估大语言模型角色扮演能力而设计的新基准。研究团队从法国里尔大学开发的这一工具专注于四个关键维度:情感理解、决策制定、道德对齐和角色一致性,通过单轮交互实现全自动评估。研究结果显示Gemini-1.5-Pro在总体表现上领先,而GPT-4o虽在决策方面表现出色,但在角色一致性上存在明显不足。这一基准为研究人员提供了一个可靠、可重复的方法来评估和改进大语言模型的角色扮演能力。

-

LegalSearchLM:北大团队打造突破性法律案例检索新方法,将案例检索重新定义为法律要素生成

这篇论文介绍了LegalSearchLM,一种创新的法律案例检索方法,将检索任务重新定义为法律要素生成。研究团队构建了LEGAR BENCH数据集,涵盖411种犯罪类型和120万案例,并开发了能直接生成关键法律要素的检索模型。实验表明,该模型在准确率上超越传统方法6-20%,且在未见犯罪类型上展现出强大泛化能力。这一突破为法律专业人士提供了更高效、精准的案例检索工具。