计算机也能当“心理医生”?「知心情感计算」带你领略脑科学前沿技术

人随时随地都会有喜怒哀乐等情感的起伏变化。那么在人与人工智能交互过程中,机器是否能够体会人的喜怒哀乐,并见机行事呢?

2021年7月7日,2021世界人工智能大会的H2-B110展台,我们看到一个大屏幕上出现一位AI头像——“知心”,站在“知心”对面,它能够跟你对话,通过对话,生成一份心理情绪检测报告。这就是深圳市亚略特生物识别科技有限公司推出的“知心”情感计算。

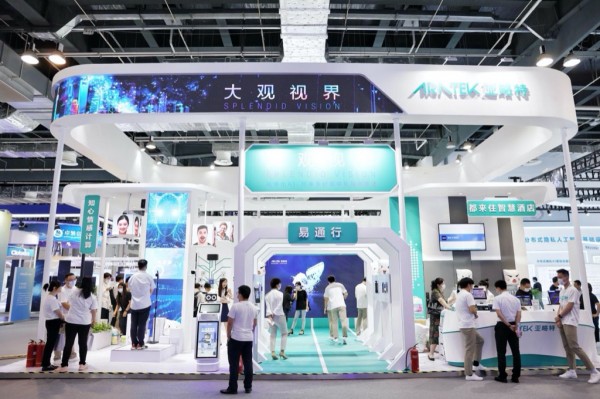

亚略特展台——“大观视界”

情感计算研究就是试图创建一种能感知、识别和理解人的情感,并能针对人的情感做出智能、灵敏、友好反应的计算系统,即赋予计算机像人一样的观察、理解和生成各种情感特征的能力。

亚略特展台——“知心情感计算”

知心系统是基于脑电科学领域前庭情绪反馈(VER技术)的研究,是远程非接触式的生物信号技术和人工智能的深度学习技术为基础的情感计算产品。通过赋予人工智能识别、理解、表达和适应人的情感的能力来建立和谐人机环境,并使人工智能具有更高的、全面的智能。这是人工智能从感知到认知智能发展的关键技术之一。

知心系统由算法、应用、专用硬件三大类组成,由于亚略特公司具有自主的“算法、芯片、模块、应用、平台、智能硬件制造”六位一体能力,也率先突破了“无感检测、深度描述、多人群动态切割、环境去噪、动静分离、专用设备一体化”等重大技术难题,从2020年1月份起将“技术”搬到了“应用现场”,目前已经应用到社会层面多个“重点岗位”等领域的心理监测。

观众现场体验“知心情感计算”

亚略特在人工智能和生物识别行业耕耘的17年间,拥有200多项多模态生物识别技术专利,生物识别算法和产品已通过中国相关部门GA评测、印度STQC认证和美国MINEX/FBI认证,相关产品及解决方案已落地覆盖全国30多个省市,并销往美国、意大利、墨西哥、西班牙、印度、菲律宾、泰国、安哥拉、尼日利亚、乌干达等十余个国家,正为全球超20亿人口提供生物认证产品和服务。

亚略特在“情感计算”领域,不管是在底层算法还是实际项目经验上,都已经具备了产业化的底蕴和能力,亚略特希望能够赋能更多的友商、合作伙伴、行业,实现更多的场景化AI落地。

好文章,需要你的鼓励

-

Snowflake AI挑战传统语言学:万千茫茫文字中,LLM真的只是"随机鹦鹉"吗?

这项由Snowflake AI Research发表的研究挑战了传统语言学对大型语言模型的批评,通过引入波兰语言学家Mańczak的理论框架,论证了LLM的成功实际上验证了"频率驱动语言"的观点。研究认为语言本质上是文本总和而非抽象系统,频率是其核心驱动力,为重新理解AI语言能力提供了新视角。

-

Yale大学团队推出"免费博士劳工":让AI研究助手像真人团队一样工作的革命性框架

freephdlabor是耶鲁大学团队开发的开源多智能体科研自动化框架,通过创建专业化AI研究团队替代传统单一AI助手的固化工作模式。该框架实现了动态工作流程调整、无损信息传递的工作空间机制,以及人机协作的质量控制系统,能够自主完成从研究构思到论文发表的全流程科研工作,为科研民主化和效率提升提供了革命性解决方案。

-

德国马普所团队发明"智能大脑重新布线"技术:让AI专家模型学会即时调整自己

德国马普智能系统研究所团队开发出专家混合模型的"即时重新布线"技术,让AI能在使用过程中动态调整专家选择策略。这种方法无需外部数据,仅通过自我分析就能优化性能,在代码生成等任务上提升显著。该技术具有即插即用特性,计算效率高,适应性强,为AI的自我进化能力提供了新思路。

-

聊天机器人怎么不在线聊天中"迷路"?Algoverse AI研究团队的熵值导航新突破

Algoverse AI研究团队提出ERGO系统,通过监测AI对话时的熵值变化来检测模型困惑程度,当不确定性突然升高时自动重置对话内容。该方法在五种主流AI模型的测试中平均性能提升56.6%,显著改善了多轮对话中AI容易"迷路"的问题,为构建更可靠的AI助手提供了新思路。