展锐第二代5G芯片平台实现量产 CEO称“明年芯片将不再供应短缺”

12月27日,紫光展锐CEO楚庆通过线上发布会官宣,公司的第二代5G芯片平台实现客户产品量产——这是公司首款6nm 5G芯片,支持5G Rel-16标准,意味着公司已具备先进制程芯片的研发与商用能力。

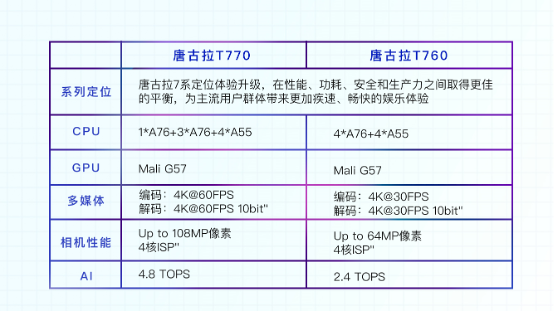

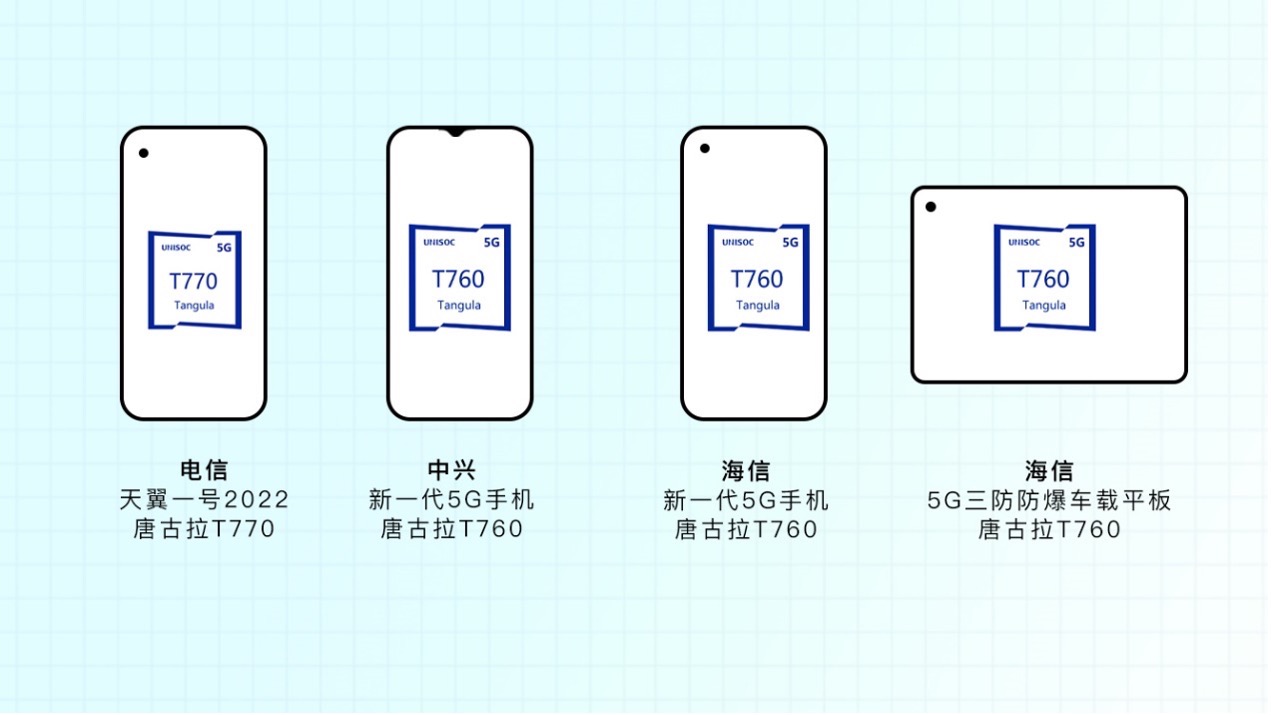

当下,展锐正在全力冲击5G芯片,过去两年内发布了两代5G芯片,第二代包括两款产品:唐古拉T770、唐古拉T760。目前,T770搭载在中国电信的新一代云手机天翼1号上,T760搭载在中兴和海信的新一代5G手机上,其中中国电信和中兴的手机将于2022年上市,另外T760芯片还搭载在海信的一款5G车载平板上。

据官方介绍,相比第一代,第二代芯片在性能上最高提升100%以上,在集成度上提升超过100%,在性能、功耗、安全、生产力之间也取得最佳的平衡。实现客户产品量产,意味着芯片平台的产品成熟度和质量都已达到了能够直接面向消费者等最终用户的状态,只有实现客户产品量产,才真正代表芯片平台完全达到了设计目标。

紫光展锐的5G芯片在第一代产品上采用12nm工艺,第二代采用6nm工艺,两种工艺都属于先进工艺范畴。楚庆表示,后者的经济投入要比前者大5倍以上,越往下一代工艺,投入就越大,从6nm到5nm的经济投入会提升2.5至3倍。

5G手机的基带芯片,一直是芯片技术最为复杂的领域之一。作为一种让全球各个区域都能使用的通用芯片,要支持不同国家地区的不同频段,这使得芯片设计极为复杂,仅仅是对2G、3G、4G兼容这一项要求,就足以让大多数厂商望而却步。研发5G,考验着公司团队的前期研发、技术储备、资金实力,投入巨大。

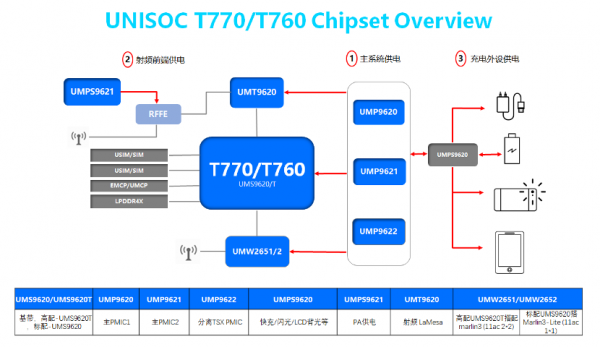

楚庆坦言,5G芯片研发难度很大,因为那是一整套方案,且“覆盖了人类有关芯片知识的全版图”。展锐第二代5G芯片平台拥有完整的5G主平台套片+可选配的5G射频前端套片等多达十多颗芯片。其中5G主平台套片包含主芯片、Transceiver、电源管理芯片以及connectivity芯片等7颗芯片;5G射频前端套片包含PA等多颗芯片。

楚庆称,客户现在也要求紫光展锐提高到先进厂商的行列,“后面的竞争只会是越来越激烈,所以在每一款芯片上,公司都是在赌命,如果赌输了的话,后果可能是倒闭”。同时,展锐也在进行治理架构的调整,这也是一项巨大挑战和不确定因素。

对于产业未来,楚庆表示乐观。“2022年,按我的判断,会发生一个逆转。”楚庆说道,芯片经历了近一年的供应短缺之后,到明年第三季度,将从供应短缺阶段进入到供应充足阶段、再到供过于求的阶段。“在供过于求的局面里,大家都可以获得丰富的产业资源,如果这个时候不能利用好这些机会给自己填满燃料、全速前进,别人将超过你,你将失去机会。”

他认为,无论是处于紧缺时代,还是供应充足的时代,对于5G玩家而言,都有不同的赛道,但最终竞争结果是一样的,就是优胜劣汰。

楚庆还称,当前中国的5G发展带来了巨大机遇。他表示,只有东亚还在正常且迅速地推进5G,其中主要是东亚三国——中国、日本和韩国,尤以中国为甚。“现在中国的六百多个地级市都被5G覆盖了。”他认为,“如果你是一商人,必须发现这一点。而且,一定要有实际行动,与其临渊羡鱼,不如退而结网,赶紧做好发掘未来金矿的准备,否则会错过这辈子最好的机遇。”

尤其是今年才封板公布的5G Rel-16标准,它才是真正释放5G全部潜力的标准。“我们有关它是如何改造人类社会的,如何改造工业体系的,这些想象力,全部都写在R16里面。我们需要长期集中重兵攻坚它。”楚庆说。

过去近1年内,展锐与运营商在5G Rel-16技术方面进行了深入合作。今年7月30号,展锐与联通一起首发全球第一个R16的版本,另外,展锐与三大运营商共同做了切片的全链路的测试,获得了成功。

好文章,需要你的鼓励

-

openGauss熊伟:oGRAC+超节点,AI数据库的下一个五年

openGauss的目标是探索oGRAC和超节点深度融合的可能,打造超节点原生数据库。

-

清华团队让机器学会"透视眼":用视频AI破解透明物体深度估计难题

清华团队开发DKT模型,利用视频扩散AI技术成功解决透明物体深度估计难题。该研究创建了首个透明物体视频数据集TransPhy3D,通过改造预训练视频生成模型,实现了准确的透明物体深度和法向量估计。在机器人抓取实验中,DKT将成功率提升至73%,为智能系统处理复杂视觉场景开辟新路径。

-

ByteDance推出全新混合专家模型训练法:让AI专家团队各司其职,大幅提升大语言模型性能

字节跳动研究团队提出了专家-路由器耦合损失方法,解决混合专家模型中路由器无法准确理解专家能力的问题。该方法通过让每个专家对其代表性任务产生最强响应,同时确保代表性任务在对应专家处获得最佳处理,建立了专家与路由器的紧密联系。实验表明该方法显著提升了从30亿到150亿参数模型的性能,训练开销仅增加0.2%-0.8%,为混合专家模型优化提供了高效实用的解决方案。

-

上海AI实验室创造"无限视频世界",用键盘就能探索!

上海AI实验室团队开发的Yume1.5是一个革命性的AI视频生成系统,能够从单张图片或文字描述创造无限可探索的虚拟世界。用户可通过键盘控制实时探索,系统8秒内完成生成,响应精度达0.836,远超现有技术。该系统采用创新的时空通道建模和自强制蒸馏技术,支持文本控制的事件生成,为虚拟现实和内容创作领域开辟了新的可能性。