LayerFlow:香港大学和阿里巴巴共同打造的层级视频生成技术,让你轻松创建前景、背景可分离的视频

**探索视频创作的新维度:认识LayerFlow**

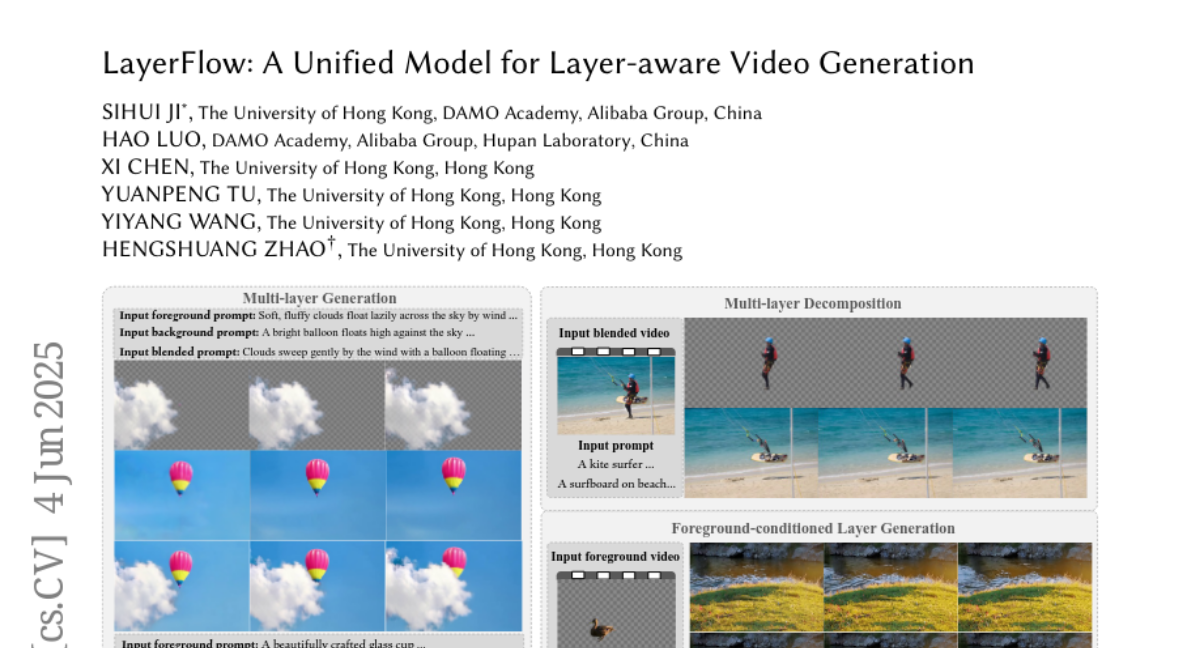

2025年6月,香港大学与阿里巴巴达摩院的研究团队共同发表了一篇名为《LayerFlow: A Unified Model for Layer-aware Video Generation》的研究论文,该论文将于2025年8月10-14日在温哥华举行的SIGGRAPH会议上正式发布。这项由香港大学的司四慧、陈希、涂源鹏、王一阳和赵恒双,以及阿里巴巴达摩院与湖畔实验室的罗浩共同完成的研究,为视频创作领域带来了革命性的突破。DOI链接为:https://doi.org/10.1145/3721238.3730662。

你是否曾经想过,如果能像Photoshop处理图层那样创建和编辑视频,会是什么样的体验?LayerFlow正是这样一项技术,它让你能够同时生成透明的前景视频、干净的背景视频,以及两者自然融合的混合场景。想象一下,你可以让一只可爱的小鸟在蓝天中飞翔,然后轻松地更换背景为山峦或海洋,而不需要复杂的视频剪辑技术。

在传统视频制作中,要实现这种效果通常需要专业的抠像技术和后期处理,过程既复杂又耗时。但LayerFlow的出现彻底改变了这一切。它不仅能根据文本描述生成多层次的视频内容,还能根据用户提供的视频条件进行创造性的视频分解和重组。例如,你可以输入一段沙滩冲浪者的视频,LayerFlow能够自动将冲浪者(前景)与沙滩(背景)分离,让你可以单独编辑或替换其中任一部分。

这项技术的核心在于它的统一框架设计,通过巧妙的模型结构和训练策略,解决了层级视频生成中的关键挑战。接下来,让我们深入了解这项令人振奋的技术背后的原理和应用。

**一、理解视频层级生成的挑战与解决方案**

想象你正在尝试制作一个动画,你需要先画出主角,再画出背景,最后将它们合成到一起。这个过程在专业动画制作中很常见,但在AI视频生成领域却是一个巨大的挑战。为什么?

首先,传统的视频生成模型通常生成的是整体视频,没有分层的概念。这就像你只能看到最终合成的动画,而无法分别获取角色和背景的素材。LayerFlow要解决的第一个问题就是:如何让AI理解并生成视频的不同层级?

其次,透明效果的表示十分复杂。想象一下透明玻璃杯中的液体,或者烟雾缭绕的场景,这些半透明效果在视频中需要通过Alpha通道(透明度通道)来实现。但将透明度的概念引入到视频生成中,尤其是当视频还包含时间维度的变化时,难度大大增加。

最后,高质量的多层视频数据极其稀缺。就像学习绘画需要大量范例一样,AI也需要看到大量分层的视频才能学会如何生成它们。然而,带有精确前景、背景分离的视频数据集几乎不存在,这为模型训练带来了巨大障碍。

面对这些挑战,LayerFlow团队提出了三个关键解决方案:

首先,他们设计了一种巧妙的层级表示方法。他们将不同层级的视频(前景RGB、前景Alpha通道、背景、混合场景)作为子片段连接在一起,形成一个长序列。就像把四部不同的短片拼接成一部长片,每部短片负责展示视频的一个层面。

其次,他们引入了层级嵌入(Layer Embedding)的概念,使模型能够区分每个视频片段所对应的层级。这就像给每个短片加上了特殊标记,告诉模型"这段是前景","这段是背景"等。

最后,他们设计了一个精巧的三阶段训练策略,充分利用有限的训练数据。通过组合低质量视频数据与高质量图像数据,借助两个特殊设计的LoRA(低秩适应)模块,他们成功训练出了能够生成高质量层级视频的模型。

**二、LayerFlow的模型架构:如何让一个模型同时理解多个视频层级**

要理解LayerFlow的工作原理,我们可以把它比作一个特殊的烹饪过程。在传统烹饪中,厨师通常一次准备一道菜。但想象一位能同时烹饪前菜、主菜和甜点的大厨,而且这三道菜还能完美搭配在一起——这就是LayerFlow的神奇之处。

LayerFlow的核心是一个基于Transformer架构的扩散模型。如果把传统视频生成模型比作能烹饪一道菜的厨师,那么LayerFlow就是能同时掌控多道菜的大厨,它能协调前景、Alpha通道、背景和混合视频这四个"菜品"的生成过程。

模型的工作流程大致是这样的:首先,它接收三个文本描述作为输入,分别描述前景、背景和混合场景。例如,"一只白色小鸟"(前景)、"蓝天白云"(背景)和"一只白色小鸟在蓝天中飞翔"(混合场景)。

接着,模型会在文本描述前添加索引号,如"0,一只白色小鸟"、"1,蓝天白云"、"2,一只白色小鸟在蓝天中飞翔"。这些索引会被转换为特殊的层级嵌入向量,加到文本嵌入中,使模型能够将每段文本与对应的视频层级关联起来。

在视频表示方面,模型采用了一种巧妙的拼接方式。它将前景RGB序列、前景Alpha序列、背景序列和混合序列拼接成一个长视频序列,然后送入3D VAE编码器进行编码。这就像把四个短片段连接成一个长片,但模型能理解每个片段代表的是视频的不同层面。

最神奇的是,通过这种设计,LayerFlow能够实现各种复杂的层级视频操作,包括:

1. 多层生成:同时生成前景、背景和混合视频。 2. 多层分解:将一个混合视频分解为前景和背景。 3. 条件层生成:给定前景视频,生成匹配的背景;或给定背景视频,生成匹配的前景。

这就像一位大厨不仅能同时烹饪多道菜,还能将一道复杂的菜分解为各种原料,或者根据已有的前菜推断出适合搭配的主菜。

**三、创新的训练策略:如何从有限数据中学习复杂技能**

训练一个像LayerFlow这样复杂的模型面临一个巨大挑战:缺乏高质量的多层视频训练数据。这就像要教一个厨师烹饪精美料理,却没有足够的示范视频。研究团队针对这一挑战,设计了一个三阶段的训练策略,巧妙地结合了视频数据和图像数据。

第一阶段:基础模型训练。这个阶段可以比作教厨师基本烹饪技能。研究团队首先使用粗糙的多层视频数据训练模型,这些数据是通过视频分割和修复技术粗略制作的。虽然质量不高,但能让模型初步掌握层级视频生成的概念。具体来说,他们使用SAM-Track工具从原始视频中分割前景,然后用视频修复模型生成背景视频。这些粗糙的数据让模型学会了基本的"菜谱",但做出的"菜肴"还不够精致。

第二阶段:Motion LoRA训练。这个阶段相当于教厨师适应静态食材。研究团队设计了一个称为Motion LoRA的低秩适应模块,使模型能够处理静态图像数据(即重复帧的视频)。这就像教厨师如何在没有动态示范的情况下,从静态食材图片学习烹饪技巧。通过这个阶段的训练,模型学会了在静态和动态之间切换的能力,为下一阶段做好准备。

第三阶段:Content LoRA训练。这是最关键的阶段,相当于教厨师精细烹饪技艺。研究团队设计了另一个低秩适应模块——Content LoRA,并使用混合数据进行训练:高质量的多层图像数据和拷贝粘贴的视频数据。当训练图像数据时,打开Motion LoRA让模型适应静态帧;当训练视频数据时,关闭Motion LoRA保持动态特性。这就像厨师同时从精美的静态菜品照片和动态烹饪视频中学习,全面提升烹饪技艺。

在推理(实际生成视频)阶段,模型会应用Content LoRA来提升生成质量,而移除Motion LoRA以恢复视频的动态特性。通过这种精巧的训练策略,LayerFlow成功从有限的训练数据中学会了生成高质量的层级视频。

**四、多样化的应用场景:LayerFlow如何改变视频创作**

LayerFlow的强大之处不仅在于它的技术创新,更在于它开启的丰富应用可能性。让我们来看看这项技术能够支持的几种创意应用场景。

首先,最基本的应用是多层视频生成。想象你是一位视频创作者,你希望制作一段云朵飘过天空的视频,天空中还漂浮着一个气球。使用LayerFlow,你只需输入三个文本描述:"柔软蓬松的云朵在风中缓缓飘过天空"(前景)、"一个明亮的气球高高飘在天空中"(背景)和"云朵被风轻轻吹过,天空中漂浮着一个气球"(混合场景)。LayerFlow会同时生成透明的云朵前景视频、气球背景视频和自然融合的混合视频,让你可以灵活地进行后期编辑。

其次,LayerFlow支持多层视频分解。假设你找到了一段喜欢的冲浪者视频,但想把冲浪者单独提取出来放到另一个场景中。传统方法需要专业的视频抠像技术,而且往往效果不理想。使用LayerFlow,你只需输入视频和相应的文本描述,它就能自动将视频分解为冲浪者(前景)和沙滩(背景)两个部分,而且前景保留透明效果,背景填充完整场景,没有抠像常见的边缘问题。

第三,LayerFlow支持前景条件层生成。比如你有一段鸭子走路的前景视频,想给它创建一个草地背景。使用LayerFlow,你可以输入前景视频和描述文本,它会自动生成与前景匹配的背景视频和自然融合的混合视频。这就像给一个角色自动创建舞台背景一样神奇。

第四,LayerFlow还支持背景条件层生成。想象你有一段山丘背景视频,希望在上面添加一只飞翔的鸟。LayerFlow可以根据背景视频和描述文本,自动生成与背景协调的前景(飞鸟)视频和融合场景。

这些应用场景极大地简化了复杂的视频创作流程,使普通用户也能轻松实现专业级的视频效果。更令人兴奋的是,LayerFlow的这些功能都在一个统一的框架中实现,不需要切换不同的工具或模型。

**五、技术评估:LayerFlow的表现如何**

研究团队通过多种方式评估了LayerFlow的性能。由于这是一个全新的研究方向,没有直接可比较的模型,他们创建了一个替代方案——将LayerDiffuse(一个层级图像生成模型)与AnimateDiff(一个视频动画模型)结合,作为比较基准。

在定量评估方面,他们使用了四个指标:帧一致性(视频帧之间的连贯性)、美学质量(视觉吸引力)、文本对齐度(与描述文本的匹配程度)和动态程度(视频中的运动量)。评估结果表明,LayerFlow在所有指标上都显著优于替代方案,特别是在保持动态性的同时实现高文本对齐度方面。

在用户研究中,30位评估者从五个关键方面对生成的视频进行评分:艺术质量、前景质量、背景质量、混合质量和文本对齐度。结果显示,LayerFlow获得了压倒性的好评,特别是在联合图像-视频训练版本上。

研究团队还进行了多项消融研究,验证了他们设计的各个组件的有效性。例如,他们比较了仅使用视频数据训练的模型与联合图像-视频数据训练的模型,结果表明后者生成的视频质量更高、边界更清晰、背景更完整。他们还比较了不同的模型架构,证明了他们提出的框架设计优于其他替代架构。

这些评估结果充分证明了LayerFlow在层级视频生成领域的卓越表现,以及其创新设计的有效性。

**六、未来展望与局限性**

尽管LayerFlow展现了令人印象深刻的能力,研究团队也坦诚地指出了当前技术的局限性。最主要的限制是模型目前不支持可变数量的层级生成。换句话说,它被设计为固定生成三个层级:前景、背景和混合场景。在未来的工作中,研究团队希望开发能够支持灵活数量层级的模型,这将允许更加复杂和动态的场景构成。

未来的研究方向可能包括:增强模型对更复杂透明效果的处理能力,如多层半透明效果的叠加;提高视频的时间一致性,使生成的动态更加自然流畅;以及探索更高效的训练策略,减少对大量训练数据的依赖。

此外,随着这项技术的发展,我们可以期待看到它在电影制作、游戏开发、虚拟现实和增强现实等领域的广泛应用。例如,电影制作人可以快速创建复杂的视觉效果场景,游戏开发者可以生成动态的游戏资产,VR/AR创作者可以创建沉浸式的交互体验。

总的来说,LayerFlow代表了视频生成技术的一个重要里程碑,它不仅解决了层级视频生成的技术挑战,还为创意表达和内容创作开辟了新的可能性。

**结语:视频创作的新时代**

LayerFlow的出现标志着视频创作进入了一个新时代。它打破了传统视频制作的限制,让我们能够以前所未有的方式操控视频内容。就像Photoshop彻底改变了图像编辑一样,LayerFlow有潜力彻底革新视频创作流程。

归根结底,LayerFlow最令人兴奋的地方在于它降低了创意表达的门槛。以前,创建带有透明效果的复杂视频需要专业的技能和工具,而现在,只需简单的文本描述,普通用户也能创建出专业级的视频效果。这种民主化的创作工具将释放更多人的创意潜能,带来更加丰富多样的视觉内容。

当然,技术永远是在不断发展的。LayerFlow代表了当前研究的最前沿,但它也只是未来更加强大的视频生成技术的开始。随着研究的深入,我们可以期待看到支持更多层级、更复杂效果、更高质量的视频生成模型。

如果你对这项技术感兴趣,欢迎查阅原始论文获取更多技术细节,论文DOI链接为:https://doi.org/10.1145/3721238.3730662。或许在不久的将来,你也能使用这项技术,创作出令人惊叹的视频作品。

好文章,需要你的鼓励

-

如何让AI像电影配乐师一样创作完整的长篇音频故事——腾讯ARC实验室团队AudioStory突破性进展

腾讯ARC实验室推出AudioStory系统,首次实现AI根据复杂指令创作完整长篇音频故事。该系统结合大语言模型的叙事推理能力与音频生成技术,通过交错式推理生成、解耦桥接机制和渐进式训练,能够将复杂指令分解为连续音频场景并保持整体连贯性。在AudioStory-10K基准测试中表现优异,为AI音频创作开辟新方向。

-

Meta与特拉维夫大学联手打造VideoJAM:让AI生成的视频动起来不再是奢望

Meta与特拉维夫大学联合研发的VideoJAM技术,通过让AI同时学习外观和运动信息,显著解决了当前视频生成模型中动作不连贯、违反物理定律的核心问题。该技术仅需添加两个线性层就能大幅提升运动质量,在多项测试中超越包括Sora在内的商业模型,为AI视频生成的实用化应用奠定了重要基础。

-

上海AI实验室重磅发布:让AI看图"说人话"的神奇训练法,解决多模态AI与人类价值观对齐难题

上海AI实验室发布OmniAlign-V研究,首次系统性解决多模态大语言模型人性化对话问题。该研究创建了包含20万高质量样本的训练数据集和MM-AlignBench评测基准,通过创新的数据生成和质量管控方法,让AI在保持技术能力的同时显著提升人性化交互水平,为AI价值观对齐提供了可行技术路径。

-

谷歌研究团队发布超级预测模型:让AI像天气预报员一样预测全球大气变化

谷歌DeepMind团队开发的GraphCast是一个革命性的AI天气预测模型,能够在不到一分钟内完成10天全球天气预报,准确性超越传统方法90%的指标。该模型采用图神经网络技术,通过学习40年历史数据掌握天气变化规律,在极端天气预测方面表现卓越,能耗仅为传统方法的千分之一,为气象学领域带来了效率和精度的双重突破。