上海AI实验室重大突破:用普通相机就能拍出超高速慢镜头,4D重建技术颠覆传统拍摄

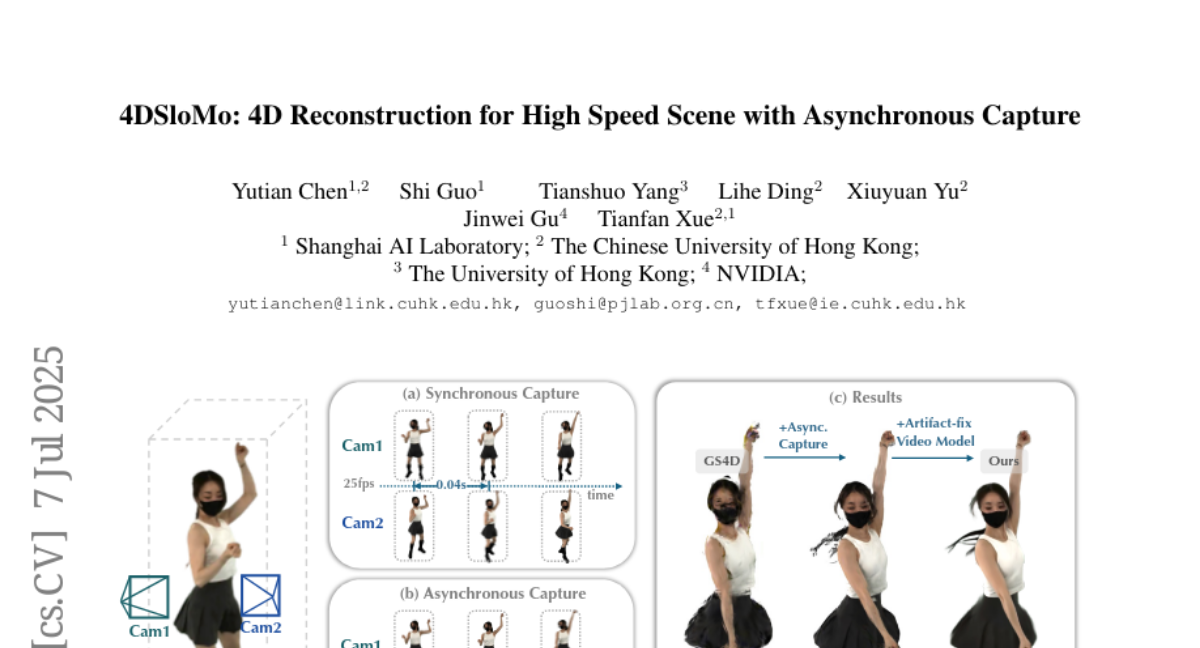

这项由上海AI实验室与香港中文大学、香港大学、NVIDIA联合完成的研究发表于2025年7月,论文题为"4DSloMo: 4D Reconstruction for High Speed Scene with Asynchronous Capture"。有兴趣深入了解的读者可以通过arXiv:2507.05163访问完整论文,也可访问项目网站https://openimaginglab.github.io/4DSloMo/获取更多信息。

当我们看体育比赛时,那些令人叹为观止的超慢镜头回放总是让人印象深刻。一个舞者旋转时裙摆的每一个褶皱变化,一个篮球入网时的每一个细微动作,这些都需要专业的高速摄影设备才能捕捉。然而,这些设备往往价格昂贵,操作复杂,普通人很难接触到。现在,研究团队找到了一个巧妙的解决方案,就像魔术师变魔术一样,用普通的相机就能实现高速摄影的效果。

一、传统拍摄的困境:就像用慢速相机拍飞鸟

要理解这项研究的重要性,我们先来看看传统4D重建技术面临的问题。4D重建简单来说,就是不仅要拍出物体的立体形状,还要记录它随时间的变化过程,就像给一个运动的物体拍摄全方位的"时光相册"。

传统的4D拍摄系统就像一群摄影师站成一圈,同时按下快门拍照。虽然这样能从不同角度记录同一时刻的画面,但存在一个根本性问题:当被拍摄的物体运动很快时,普通相机的拍摄速度跟不上。就好比你想用每秒只能拍25张照片的相机去记录蜂鸟的翅膀振动,结果只能拍到模糊的残影。

目前大多数4D拍摄系统的帧率都不超过30FPS(每秒30帧),有些甚至只有15FPS。这个速度对于拍摄慢动作还可以,但面对快速运动时就显得力不从心。比如一块布料在风中飘动,或者舞者快速旋转的动作,用这样的拍摄频率很难捕捉到中间的运动细节,最终重建出的4D模型会出现明显的跳跃和失真。

更要命的是,提升拍摄频率需要更昂贵的专业设备,不仅增加成本,还会大大增加数据传输的负担。这就像为了拍好照片而买一堆顶级相机,既不现实也不经济。

二、巧妙的异步拍摄方案:让相机"接力"工作

面对这个难题,研究团队想出了一个绝妙的办法,就像指挥一个交响乐团一样,让不同的相机在不同的时间开始工作,而不是所有相机同时开始。

在传统同步拍摄中,假设有8台相机围成一圈,它们会在同一时刻"咔嚓"一声同时拍照,然后等到下一个时间点再同时拍照。这样虽然每个时刻都有8个不同角度的照片,但时间间隔较大,快速运动的中间过程就丢失了。

而在新的异步拍摄方案中,研究团队将这8台相机分成4组,每组2台。第一组在0秒开始拍摄,第二组在0.01秒开始拍摄,第三组在0.02秒开始拍摄,第四组在0.03秒开始拍摄。这样,虽然每个时刻只有2台相机在工作,但整个系统的有效拍摄频率从原来的25FPS提升到了100FPS,相当于把时间分辨率提高了4倍。

这就像原本只有一个人在记录运动员的动作,现在有4个人轮流记录,虽然每个人看到的角度有限,但合在一起就能还原出更加连续流畅的运动过程。通过这种巧妙的时间错位安排,研究团队在不增加任何硬件成本的情况下,显著提升了系统捕捉快速运动的能力。

实际实验中,研究团队使用了12台25FPS的普通相机,将它们分成4组或8组,成功实现了100FPS甚至200FPS的等效拍摄效果。相机被安排在三个不同高度,每个高度均匀分布4台相机,相互间隔约22.5度,形成一个完整的拍摄网络。

三、解决稀疏视角问题:用AI修复"缺失"的画面

异步拍摄虽然解决了时间分辨率的问题,但也带来了新的挑战:在任何给定时刻,可用的相机数量减少了,这会导致某些角度的信息缺失,就像拼图少了几块一样。

当系统试图根据这些"不完整"的信息重建4D模型时,会出现一些奇怪的"浮动伪影",这些伪影看起来像是悬浮在空中的噪点或错误的几何结构。这个问题在3D重建领域被称为稀疏视角重建难题。

为了解决这个问题,研究团队开发了一个基于视频扩散模型的"修复工具"。这个工具的工作原理有点像一个经验丰富的修复师,能够根据已有的画面信息,智能地"猜测"和补全缺失的部分。

首先,研究团队需要训练这个修复工具。他们巧妙地构造了训练数据:从完整的4D视频序列中故意删除一些帧,模拟异步拍摄的情况,然后用这些"有缺陷"的数据训练4D高斯模型。这个过程产生的渲染结果自然包含各种伪影,研究团队将这些有问题的视频与原始完美视频配对,形成了训练数据。

这个修复模型基于视频扩散技术构建,而不是简单的图像修复。这一点很关键,因为视频修复能够保持时间上的连续性,避免相邻帧之间出现突兀的变化。就像修复一部老电影,不仅要让每一帧看起来清晰,还要确保整个播放过程流畅自然。

令人惊讶的是,仅用750对训练样本,这个修复模型就展现出了强大的泛化能力,能够处理各种不同场景的伪影问题。这得益于视频扩散模型本身强大的时空先验知识,就像一个见多识广的专家,即使面对新情况也能做出合理的判断。

四、完整的重建流程:从拍摄到成果的全过程

整个4D重建过程就像一个精心设计的生产流水线。首先,异步拍摄系统收集到时间密集但空间稀疏的多视角视频数据。这些原始数据被输入到4D高斯模型中进行初步重建,这个阶段会产生一个包含伪影的粗糙版本。

接下来,修复模型登场。对于每个训练视角,系统都会渲染一个高帧率的视频,这个视频覆盖了所有相机观察到的时间点。虽然这些初始渲染包含浮动伪影,但它们为修复模型提供了重要的空间视角信息和时间运动信息。

修复模型将这些有问题的视频转换到潜在空间进行处理,然后生成清晰、锐利的修复版本。这些修复后的视频随后被用来监督4D高斯模型的进一步优化,通过结合L1损失和感知损失,确保重建结果既在像素级别准确,又在视觉感知上自然。

整个训练过程分为两个阶段:前7000次迭代进行初始优化,后7000次迭代结合修复模型的指导进行精细化调整。这种两阶段策略确保了模型能够充分利用异步拍摄的时间信息,同时最大化地减少稀疏视角带来的重建伪影。

五、实验验证:从合成数据到真实场景

为了全面验证方法的有效性,研究团队设计了多层次的实验方案。在合成数据测试中,他们使用了DNA-Rendering和Neural3DV两个广泛认可的4D数据集。为了模拟快速运动和异步拍摄的条件,研究团队对这些数据集进行了时间下采样,将DNA-Rendering的帧率从15FPS降到约4FPS,将Neural3DV的帧率从30FPS降到约2.5FPS。

在这些极具挑战性的条件下,新方法在所有评估指标上都显著超越了现有技术。与K-Planes、4DGS、GS4D等先进方法相比,新方法在PSNR(峰值信噪比)、SSIM(结构相似性)和LPIPS(感知损失)等关键指标上都取得了明显优势。例如,在DNA-Rendering数据集上,PSNR从24.75提升到26.76,LPIPS从0.337降低到0.293,这些数字背后代表着显著的视觉质量改善。

更重要的是真实场景的测试。由于这是首个采用异步拍摄策略的4D重建研究,现有的数据集都没有相应的真实拍摄数据。因此,研究团队专门构建了一个包含12台同步相机的拍摄系统,通过手动引入触发延迟来实现异步拍摄。

他们拍摄了12个包含快速复杂动态场景的序列,包括舞蹈、体育活动和快速物体交互等。每个视频的分辨率达到2048×2248像素,涵盖了各种非线性大幅度运动场景。在这些真实拍摄的数据上,新方法同样展现出了优异的性能,能够准确重建快速运动区域,恢复复杂的纹理细节。

六、深入分析:各个组件的贡献

通过详细的消融实验,研究团队分析了异步拍摄和修复模型各自的贡献。结果显示,单独使用异步拍摄就能带来显著的改善,PSNR从24.75提升到26.23,证明了增加时间分辨率对于处理快速运动的重要性。而在异步拍摄的基础上加入修复模型,性能进一步提升,PSNR达到26.76,SSIM从0.831提高到0.845。

研究团队还对比了视频修复与图像修复的效果。结果表明,虽然图像扩散模型在单帧质量上可能更出色,但视频修复模型在保持时间连续性方面具有明显优势。在相邻帧之间,视频修复能够保持纹理的一致性,而图像修复往往会引入随机变化,导致时间上的不连贯。

为了进一步提升性能,研究团队还探索了逐场景微调的策略。通过采用留一法构造噪声-清洁视频对,然后对修复模型进行少量迭代的微调,可以让模型更好地适应特定场景的特点。这种策略在处理复杂场景时表现尤为突出,能够恢复更精细的服装细节和纹理信息。

七、技术创新的深层意义

这项研究的创新不仅仅在于技术层面,更在于它展示了一种全新的问题解决思路。传统上,提高拍摄质量往往意味着更昂贵的设备和更复杂的系统。而这项研究证明了,通过巧妙的算法设计和智能的数据处理,可以在不增加硬件成本的情况下显著提升系统性能。

异步拍摄策略的核心思想是时间和空间的权衡。通过牺牲每个时刻的空间采样密度,换取更高的时间分辨率,然后用AI技术来弥补空间信息的不足。这种设计哲学对于许多其他计算摄影和计算机视觉任务都具有启发意义。

修复模型的设计也体现了深度学习技术的成熟。通过合理构造训练数据和精心设计损失函数,一个相对简单的模型就能处理复杂的重建伪影问题。特别是视频扩散模型的应用,展现了生成式AI在解决传统计算机视觉问题上的巨大潜力。

从数据效率的角度来看,仅用750个训练样本就能达到良好的泛化效果,这在深度学习领域是相当罕见的。这得益于预训练模型强大的先验知识和精心设计的微调策略,为资源受限环境下的AI应用提供了有价值的参考。

八、实际应用前景与挑战

这项技术的应用前景非常广阔。在体育分析领域,教练可以用普通相机阵列来分析运动员的技术动作,获得以前只有专业高速摄影设备才能提供的详细信息。在生物力学研究中,研究人员可以更经济地进行人体运动分析,为康复治疗和运动损伤预防提供支持。

在娱乐产业中,这项技术为VR/AR内容制作打开了新的可能性。制作团队可以用相对低成本的设备捕捉高质量的动态表演,创造更加逼真的数字人物和虚拟场景。对于自动驾驶和机器人技术,精确的高速4D重建能力有助于更好地理解和预测动态环境中的物体行为。

然而,技术也面临一些挑战。当前方法仍然依赖于预训练扩散模型的质量,在处理某些精细纹理时可能会有细节损失。此外,逐场景微调虽然能提升性能,但会增加计算成本和处理时间,这在实时应用中可能成为限制因素。

系统的可扩展性也是一个考虑因素。虽然12台相机的配置已经相当实用,但在更大规模的场景或需要更高时间分辨率的应用中,如何平衡相机数量、时间分组和重建质量仍需要进一步研究。

九、与现有技术的对比优势

相比于传统的高速摄影方案,这项技术的最大优势在于成本效益。专业的高速相机往往价格昂贵,而且数据存储和传输的要求很高。新方法使用普通相机就能达到类似效果,大大降低了技术门槛。

与其他4D重建方法相比,这项技术在处理大幅度运动方面具有明显优势。传统方法在面对快速变化时往往会产生运动模糊或时间不连贯的问题,而异步拍摄方案通过提高时间采样率,从根本上缓解了这个问题。

在AI辅助重建方面,视频修复模型相比传统的几何约束方法具有更强的泛化能力。传统方法往往针对特定类型的伪影设计特定的算法,而基于深度学习的修复模型能够自动学习和处理各种复杂的重建问题。

从系统的实用性角度来看,整个流程的自动化程度很高,不需要复杂的手工调参或专业知识。这使得技术更容易被非专业用户采用,有利于技术的推广和应用。

十、未来发展方向与改进空间

研究团队在论文中也坦诚地讨论了当前方法的局限性和未来的改进方向。修复模型虽然效果显著,但仍然受限于基础扩散模型的能力。随着更先进的视频生成模型的出现,修复质量有望进一步提升。

在算法优化方面,如何更好地平衡时间采样和空间采样是一个持续的研究课题。当前的分组策略相对简单,未来可能会有更智能的自适应分组方案,根据场景内容和运动特点动态调整拍摄策略。

实时处理能力也是一个重要的发展方向。当前的方法需要离线处理才能得到最终结果,如果能够实现实时或近实时的4D重建,将大大扩展应用场景,特别是在直播、游戏和交互应用中。

硬件和软件的协同优化也值得关注。通过专门设计的相机硬件和优化的算法实现,可能能够进一步提升系统的性能和效率。特别是在边缘计算设备上的部署,将使这项技术更加实用和普及。

说到底,这项研究为我们展示了一个重要的技术发展趋势:通过巧妙的算法设计和AI技术的结合,我们能够在不大幅增加硬件成本的情况下实现显著的性能提升。这种"软硬结合"的创新思路不仅适用于4D重建领域,对整个计算摄影和计算机视觉领域都具有重要的启发意义。

对于普通用户来说,这项技术意味着高质量4D内容创作的门槛将大大降低。无论是专业的内容创作者还是普通的摄影爱好者,都有机会用相对简单的设备创造出令人惊叹的动态视觉效果。随着技术的不断成熟和普及,我们有理由期待一个更加丰富多彩的视觉世界。

**Q&A**

**Q1:什么是异步拍摄?它和普通拍摄有什么区别?** A:异步拍摄就是让不同的相机在不同时间开始工作,而不是同时按快门。就像接力赛一样,虽然每个时刻工作的相机较少,但整体的拍摄频率提高了。普通拍摄是所有相机同时拍照,时间间隔较大,容易丢失快速运动的细节。

**Q2:为什么需要AI来修复画面?直接用异步拍摄不行吗?** A:异步拍摄虽然提高了时间分辨率,但每个时刻可用的相机数量减少了,会导致某些角度信息缺失,产生"浮动伪影"。AI修复模型就像经验丰富的修复师,能根据已有信息智能补全缺失部分,确保最终效果自然流畅。

**Q3:这项技术什么时候能普及到普通用户?成本高吗?** A:目前还处于研究阶段,但技术优势明显:只需要普通相机而非昂贵的专业高速设备。随着算法优化和硬件成本降低,预计未来几年内可能会有商业化产品出现,让普通用户也能享受到高质量4D拍摄的乐趣。

好文章,需要你的鼓励

-

AI玩游戏能让推理变聪明?新加坡国立大学发现自对弈训练的神奇效果

新加坡国立大学研究团队开发了SPIRAL框架,通过让AI与自己对弈零和游戏来提升推理能力。实验显示,仅训练AI玩简单扑克游戏就能让其数学推理能力提升8.6%,通用推理提升8.4%,且无需任何数学题目作为训练材料。研究发现游戏中的三种推理模式能成功转移到数学解题中,为AI训练提供了新思路。

-

同济大学突破性研究:让3D相机告别"噪点困扰"的智能降噪新技术

同济大学团队开发的GIGA-ToF技术通过融合多帧图像的"图结构"信息,创新性地解决了3D相机噪声问题。该技术利用图像间的不变几何关系,结合深度学习和数学优化方法,在合成数据集上实现37.9%的精度提升,并在真实设备上展现出色泛化能力,为机器人、AR和自动驾驶等领域提供更可靠的3D视觉解决方案。

-

AI视觉推理模型的"顿悟时刻"真的存在吗?伊利诺伊大学研究揭示令人意外的真相

伊利诺伊大学研究团队通过对比实验发现,经过强化学习训练的视觉语言模型虽然表现出"顿悟时刻"现象,但这些自我纠错行为并不能实际提升推理准确率。研究揭示了AI模型存在"生成-验证差距",即生成答案的能力强于验证答案质量的能力,且模型在自我验证时无法有效利用视觉信息,为AI多模态推理发展提供了重要启示。

-

MIT团队发明"智能减肥法"让AI训练快1.6倍:只需要一半的算力就能教会大模型新技能

MIT等顶尖机构联合提出SparseLoRA技术,通过动态稀疏性实现大语言模型训练加速1.6倍,计算成本降低2.2倍。该方法使用SVD稀疏性估计器智能选择重要计算部分,在保持模型性能的同时显著提升训练效率,已在多个任务上验证有效性。