字节跳动AI团队推出UNO:图像"魔法师"实现从一到多主题的自由创作

这项突破性研究来自字节跳动智能创作团队,由吴少金、黄梦琪、吴文旭、程宇峰、丁飞、何倩等研究人员共同完成,于2025年4月发表在计算机视觉顶级会议上。感兴趣的读者可以通过项目主页 https://bytedance.github.io/UNO 或GitHub仓库 https://github.com/bytedance/UNO 获取完整的研究资料和代码。

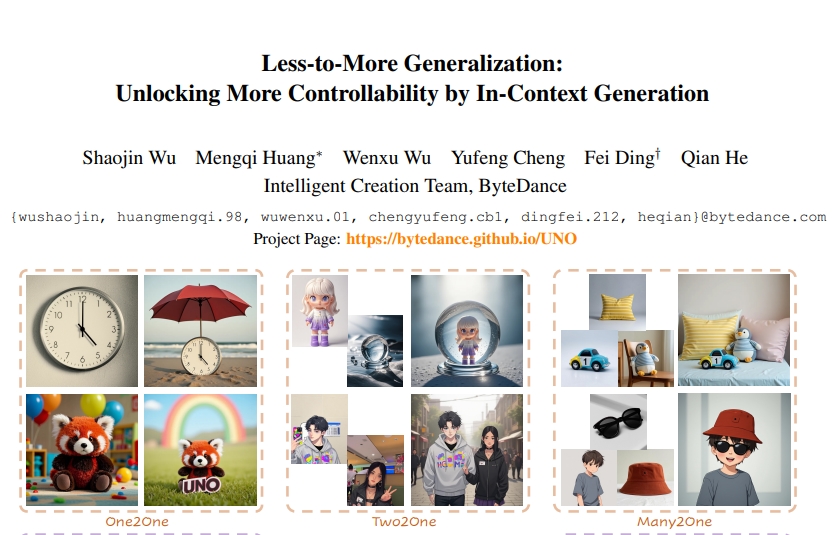

当你看到一张钟表的照片,能否让AI帮你生成这个钟表在向日葵田中摆放的全新画面?或者把你心爱的玩具和宠物同时放到一幅梦幻的场景中?这些看似天马行空的想法,现在都可以通过字节跳动团队最新开发的UNO系统轻松实现。这个名为"UNO"的AI系统就像一位神奇的图像魔法师,它不仅能够根据一张参考图片生成全新的场景,更令人惊奇的是,它还能同时处理多个不同的物体,将它们和谐地融合到同一幅画面中。

传统的图像生成技术就像只会画单人肖像的画家,虽然能画得很好,但当你要求他在同一幅画中绘制多个不同的人物时,往往会出现风格不统一、细节混乱的问题。而UNO就像一位全能的艺术大师,不仅能够完美还原单个物体的特征,还能巧妙地将多个物体组合在一起,创造出既保持各自特色又和谐统一的全新作品。

这项研究的独特之处在于,它首次提出了一种"循序渐进"的训练方法。就像学画画要从简单的几何图形开始,逐步过渡到复杂的风景画一样,UNO系统也是先学会处理单个物体的图像生成,然后再逐步掌握多物体的复杂场景创作。更重要的是,研究团队还开发了一套自动化的数据生成流水线,让AI能够自己"制造"高质量的训练素材,这就像让学徒画家能够自己临摹大师作品来不断提升技艺。

一、解决图像定制化生成的根本难题

在探讨UNO的技术细节之前,我们需要理解当前图像生成领域面临的核心挑战。当你想要AI根据特定的参考图片生成新图像时,就像要求一位画家根据你提供的照片重新创作一样,这个过程被称为"主题驱动生成"。

目前的技术路线主要分为两种类型,每种都有其固有的局限性。第一种类型就像请私人定制画家,每当你想要生成某个特定物体的新图像时,都需要重新训练整个AI模型。这种方法虽然效果不错,但就像每次都要重新教会画家认识你的宠物一样,耗时耗力,在实际应用中显然不现实。

第二种类型则像培训通用画家,通过大量的训练数据让AI学会处理各种不同的物体。然而,这种方法面临的最大问题是高质量训练数据的匮乏。收集真实的多主题配对图像数据就像收集珍贵的艺术品一样困难——你很难找到大量既包含同一个茶杯、又将这个茶杯放置在不同场景中的照片。即使有一些合成数据,质量往往不高,分辨率有限,涵盖的场景类型也相对单一。

这种数据短缺的困境就像厨师缺少优质食材一样,直接限制了最终成品的质量。现有的方法经常在主题相似度和文本控制能力之间徘徊——要么生成的图像虽然符合文字描述,但与原始参考图片相差甚远;要么很好地保持了参考图片的特征,但无法灵活地根据新的文字指令进行调整。

更加棘手的是,当需要处理多个不同主题的组合时,问题变得更加复杂。就像同时指挥多个乐器演奏和谐乐曲一样,AI需要在保持每个物体各自特征的同时,还要确保它们在新场景中的协调统一。大多数现有方法都专注于单主题生成,当面对多主题场景时往往力不从心。

字节跳动团队敏锐地意识到,要从根本上解决这些问题,不能仅仅从模型设计角度入手,更需要重新思考数据和模型之间的关系。他们提出了一个全新的"模型-数据协同进化"理念,这种方法就像培养一个能够自我提升的学习系统——能力较弱的初级模型通过生成训练数据来帮助更强大的高级模型学习,而高级模型又能生成更好的数据来训练下一代模型,形成了一个正向循环的自我完善机制。

这种理念的核心洞察在于,与其被动地等待高质量数据的出现,不如主动利用现有模型的能力来创造所需的训练素材。这就像让一位初级画家通过不断练习基础技法来为高级画家提供草图参考,最终整个艺术团队的水平都得到了提升。通过这种方式,不仅解决了数据稀缺的问题,还为模型的持续改进提供了可持续的路径。

二、巧妙的数据生成流水线设计

要让AI学会创作高质量的图像,就像培养一位优秀的画家一样,首先需要为它提供丰富多样的"临摹素材"。字节跳动团队设计的数据生成流水线就像一个自动化的艺术创作工厂,能够源源不断地生产出高质量的训练数据。

这个流水线的设计理念非常巧妙,它充分利用了现有文本到图像生成模型(如FLUX.1)已经具备的"上下文生成能力"。什么是上下文生成能力呢?简单来说,就像一个聪明的画家能够理解"请画两幅相关的画作"这样的指令,并确保两幅画中的主要物体保持一致的特征。比如,当你要求AI生成"左边是一个红色茶杯在桌子上,右边是同一个红色茶杯在花园里"时,AI能够确保两边画面中的茶杯看起来确实是同一个。

为了充分发挥这种能力,研究团队首先构建了一个庞大的"素材库"。这个素材库就像一个分类详细的百科全书,包含了365个大类的物体,从日常用品到动物植物,应有尽有。但他们并不满足于简单的分类,而是让AI助手进一步细化每个类别。比如,对于"帽子"这个类别,AI会生成"彩虹条纹帽"、"蘑菇形状帽"、"军官帽"、"巴拿马帽"等更具体的描述,甚至还包括带有文字装饰的创意设计,如"在帽檐上绣着'保持冷静'字样的渔夫帽"。

接下来,系统会为每个具体的物体生成多样化的场景描述。这就像为每个"演员"安排不同的"舞台背景"。同样是一顶白色巴拿马帽,它可能出现在"阳光海滩的躺椅上,在海风中轻柔摆动,棕榈树投下斑驳的影子",也可能放置在"纯白色背景的摄影棚中,展现每一个细节"。通过这种方式,系统能够生成数百万个丰富多样的文本提示。

有了这些精心设计的文本提示,系统就开始利用FLUX.1模型的上下文生成能力来制作图像对。这个过程就像使用一个特殊的"双联画"模板,让AI在同一幅图像中生成两个相关的场景。左边可能是物体在简单背景中的参考图像,右边则是同一物体在复杂场景中的目标图像。更重要的是,系统能够直接生成高分辨率的图像(1024×1024、1024×768、768×1024),这比之前的方法有了显著提升。

然而,自动生成的图像对难免会出现质量问题,比如两边的物体看起来不像同一个,或者某一边缺少了应该出现的物体。为了解决这个问题,研究团队设计了一个多层次的质量筛选机制,就像多道质检流程确保产品质量。

第一道筛选使用DINOv2技术,这是一种能够精确比较图像相似度的AI工具。系统会将双联画分割成两个独立的图像,然后计算它们之间的相似度。如果相似度过低,说明两边的物体差异太大,这对图像就会被淘汰。这就像用精密仪器检测两个零件是否匹配。

第二道筛选则更加精细,使用了视觉语言模型(VLM)进行多维度评估。这个过程采用了"思维链"的方法,让AI像人类专家一样逐步分析图像质量。首先,AI会详细描述两幅图像的内容,识别出需要重点关注的物体部分。然后,它会从外观、细节、属性等多个维度逐一比较这些部分的差异。最后,基于这些详细的分析,AI会为每个方面打分,并给出最终的综合评价。

这种筛选机制的效果非常显著。通过多轮筛选,只有大约35%的原始数据能够通过质检,但这些保留下来的数据质量极高,物体一致性优秀。研究团队的实验证明,使用高质量筛选后的数据训练出来的模型,在主题相似度方面有显著提升,这验证了"宁缺毋滥"的数据筛选策略的正确性。

通过这套巧妙的数据生成流水线,研究团队成功地为单主题场景创建了23万对高质量图像,为多主题场景创建了1.5万对图像。这些数据不仅数量庞大,质量也远超以往的合成数据集,为后续的模型训练奠定了坚实的基础。

三、从简单到复杂的渐进式训练策略

有了高质量的训练数据,接下来的关键是如何设计一个能够充分利用这些数据的模型架构。UNO系统的核心创新在于采用了"渐进式交叉模态对齐"的训练策略,这种方法就像教小孩学画画一样,先从简单的单个物体开始,然后逐步过渡到复杂的多物体组合。

UNO的基础架构建立在Diffusion Transformer(DiT)之上,这是目前最先进的图像生成技术之一。可以把DiT想象成一个功能强大的"数字画家",它能够理解文字描述并将其转化为图像。不过,原始的DiT主要是一个"文字到图像"的画家,而UNO需要将它改造成能够理解参考图像的"图像到图像"画家。

这个改造过程的巧妙之处在于,研究团队没有对DiT进行大刀阔斧的结构性修改,而是采用了一种更加温和的"渐进适应"策略。这就像让一位习惯了根据文字描述作画的画家,逐步学会同时参考实物照片来创作。

第一阶段的训练专注于单图像条件生成。在这个阶段,系统学习如何根据一张参考图像和一段文字描述来生成新的图像。原本的DiT输入包括文字标记和加了噪声的目标图像,现在系统在这个基础上添加了经过编码的参考图像信息。这个过程可以用一个简单的公式来描述:新的输入 = 文字信息 + 噪声图像 + 参考图像。

这种设计的聪明之处在于,它保持了原有DiT架构的稳定性。因为原始模型已经习惯了处理文字和图像的组合,添加参考图像信息并不会造成太大的干扰。就像一位画家已经熟悉了某种绘画技法,学习在其中加入新的元素相对容易,而不需要完全重新学习整套技艺。

经过第一阶段的训练,模型已经能够很好地处理单主题的图像生成任务。此时,研究团队开始进入第二阶段:多图像条件生成。在这个阶段,系统需要同时参考多张不同的图像来创作新作品。输入变成了:文字信息 + 噪声图像 + 第一个参考图像 + 第二个参考图像 + ...

为什么要采用这种两阶段的策略,而不是直接训练多图像模型呢?这背后有深刻的技术考虑。当模型同时面对多个图像输入时,很容易出现"信息冲突"的问题。就像一个画家同时看着多张不同的参考照片,可能会感到困惑,不知道该重点参考哪一张。通过先让模型在单图像场景下稳定掌握基础技能,再逐步引入更复杂的多图像场景,能够大大降低训练的难度和不稳定性。

实验结果证明了这种渐进策略的有效性。与直接进行多图像训练的方法相比,采用两阶段训练的模型在各项指标上都有显著提升。更重要的是,即使在单图像生成任务上,经过两阶段训练的模型也比只进行单阶段训练的模型表现更好,这说明多样化的训练确实能够提升模型的整体理解能力。

四、解决多图像混淆的巧妙方案

当AI同时处理多张参考图像时,会遇到一个类似于"张冠李戴"的问题。想象一下,如果你给一位画家看了一张红色跑车和一张蓝色自行车的照片,然后要求他画出"红色自行车",画家可能会混淆这些属性,画出蓝色的跑车或者红色的自行车但带着跑车的特征。这种属性混淆问题在多图像生成中尤为突出。

为了解决这个问题,字节跳动团队开发了一种叫做"通用旋转位置编码"(UnoPE)的技术。要理解这个技术,我们首先需要了解什么是位置编码。

在DiT模型中,每个图像都被切分成很多小块(就像拼图的碎片),每个小块都需要一个"身份标识"来告诉模型它在整张图像中的位置。这就是位置编码的作用。原始的FLUX模型使用旋转位置编码(RoPE),为每个图像块分配一个二维坐标 (i, j),其中i表示行位置,j表示列位置。

在原始设计中,文字信息被分配固定的位置坐标(0, 0),而图像块则根据它们在图像中的实际位置获得不同的坐标。这种设计对于单图像生成来说运行良好,但当引入多个参考图像时,问题就出现了。

传统的解决方案是简单地为每个新增的参考图像重复使用相同的位置编码规则。但这样做会产生一个严重的副作用:模型会过度关注参考图像的空间布局,试图在生成的新图像中复制这种布局。这就像告诉画家不仅要画出参考照片中的物体,还要完全按照参考照片中的位置摆放这些物体。

UnoPE的创新在于重新设计了多图像场景下的位置编码策略。对于第二个参考图像,系统不再从(0, 0)开始分配坐标,而是从第一个图像的最大坐标开始。具体来说,如果第一个图像的最大坐标是(w-1, h-1),那么第二个图像的坐标就从(w, h)开始分配。

这种看似简单的调整产生了profound的效果。通过给不同的参考图像分配不同的"坐标空间",模型能够更清楚地区分来自不同图像的信息,避免属性混淆。同时,由于参考图像的位置编码与目标图像的位置编码存在明显差异,模型不会试图复制参考图像的空间布局,而是更专注于提取和组合物体的视觉特征。

为了验证UnoPE的有效性,研究团队进行了详细的对比实验。他们测试了不同的位置编码策略,包括不使用偏移、只在宽度方向使用偏移、只在高度方向使用偏移,以及同时在两个方向使用偏移。结果显示,UnoPE(同时使用偏移)在所有评估指标上都达到了最佳性能。

特别值得注意的是,当不使用任何位置偏移时,模型的性能急剧下降,生成的图像往往能够跟随文字描述,但几乎无法参考输入的图像特征。这说明适当的位置编码对于多图像生成的重要性。而UnoPE通过巧妙的设计,在保持文字控制能力的同时,显著提升了图像参考的准确性。

这种技术上的创新体现了UNO团队对于多模态学习深层机制的理解。他们没有简单地增加模型的复杂度,而是通过精心设计的编码策略,让模型能够更好地理解和处理多源信息。这种"四两拨千斤"的设计哲学,正是优秀AI系统的典型特征。

五、多主题数据的自动生成策略

在解决了单主题图像生成的基础问题后,UNO团队面临着一个更大的挑战:如何为多主题场景创建高质量的训练数据。这个问题就像要求一位摄影师同时捕捉多个移动的主体,并确保它们在同一个画面中都表现完美。

传统的方法通常采用简单粗暴的裁剪策略。比如,如果系统已经生成了一张包含两个物体的图像,最直接的做法就是用物体检测工具将其中一个物体裁剪出来,作为第二个参考图像。这种方法看似合理,但实际上会导致严重的"复制粘贴"问题。

什么是复制粘贴问题呢?想象一下,如果你给一位画家看一幅完整的风景画,然后从中剪下一块碎片作为参考,要求画家在新的场景中重现这个碎片。画家很可能会机械地将这个碎片的视觉特征直接复制到新画面中,而不是真正理解其本质特征并进行创造性的重新演绎。AI模型也面临同样的问题——它们倾向于直接"粘贴"裁剪出来的图像片段,而不是理解物体的本质特征。

为了解决这个问题,UNO团队采用了一种更加智能的策略。他们首先使用开放词汇物体检测器(OVD)来识别目标图像中的多个物体,并获得这些物体的裁剪版本。但关键的创新在于,他们不直接使用这些裁剪图像,而是将其输入到已经训练好的单主题生成模型中,让模型重新生成这些物体在不同场景中的图像。

这个过程可以比作"艺术家的重新创作"。原始的裁剪图像就像一个粗糙的草图,而单主题生成模型则像一位技艺精湛的艺术家,能够根据这个草图重新创作出一幅完整、高质量的作品。重新生成的图像虽然保持了原物体的核心特征,但在场景、光照、角度等方面都有所不同,这样就避免了直接复制的问题。

这种方法的巧妙之处在于它形成了一个自我改进的循环。单主题生成模型的训练数据质量越高,它生成的多主题参考图像质量就越好;而高质量的多主题数据又能进一步提升整个系统的性能。这就像一个良性循环的生态系统,各个组件相互促进,共同提升。

为了确保生成的多主题数据质量,研究团队对新生成的参考图像也进行了严格的质量筛选,使用与单主题数据相同的DINOv2和VLM评估流程。这样,最终的多主题训练数据不仅在数量上满足需求,在质量上也达到了很高的标准。

更有趣的是,由于文本到图像生成和物体检测的随机性,有时候系统会意外地发现一些包含三个或更多主题的图像。虽然这些情况相对较少,但它们为模型提供了处理更复杂场景的训练机会,进一步增强了UNO的泛化能力。

通过这种自动化的多主题数据生成策略,UNO团队成功地创建了1.5万对高质量的多主题训练数据。虽然数量上比单主题数据少,但这些数据的复杂性和多样性为模型学习多物体组合提供了宝贵的训练素材。实验结果表明,这种精心设计的数据生成策略对于模型最终性能的提升起到了关键作用。

六、全面的性能评估与对比分析

为了验证UNO系统的实际效果,研究团队进行了全面而严格的评估实验。这些实验就像对一位画家进行全方位的技艺考核,不仅要看他能否画得像,还要看他能否画得美,能否准确理解并执行复杂的创作要求。

在技术实现方面,UNO基于目前最先进的FLUX.1 dev模型进行改进。整个训练过程采用了相对轻量级的LoRA(低秩适应)微调技术,这就像在原有的绘画技艺基础上学习新的专门技法,而不是完全重新学习绘画。具体的训练分为两个阶段:第一阶段使用23万对单主题数据训练5000步,第二阶段使用1.5万对多主题数据继续训练5000步。整个过程在8张NVIDIA A100 GPU上完成,展现了良好的计算效率。

在单主题图像生成的评估中,UNO与多个当前最先进的方法进行了对比,包括传统的微调方法(如DreamBooth、Textual Inversion)和现代的免微调方法(如IP-Adapter、OminiControl、RealCustom++等)。评估使用了广泛认可的DreamBench数据集,这个数据集包含了30个不同类别的物体,每个物体都有详细的测试提示。

评估指标包括三个重要维度:DINO分数衡量生成图像与参考图像在语义特征上的相似度,CLIP-I分数衡量视觉相似度,CLIP-T分数衡量生成图像与文字描述的匹配程度。可以把这三个指标想象成评判一幅画作的三个标准:是否保持了参考物体的本质特征、是否在视觉上相似、是否符合文字要求。

在这些指标上,UNO都取得了令人印象深刻的成绩。DINO分数达到0.760,CLIP-I分数达到0.835,在所有对比方法中均排名第一,而CLIP-T分数0.304也处于领先水平。这意味着UNO不仅能够生成与参考图像高度相似的物体,还能很好地遵循文字指令进行创作。

更重要的是,UNO在多主题生成这个更具挑战性的任务上也表现出色。研究团队构建了一个包含30种不同物体组合的评估集,每个组合生成6张图像,使用25个不同的文字提示,总共产生4500个测试样本。在这个更复杂的测试中,UNO的DINO分数达到0.542,CLIP-I分数达到0.733,继续在所有对比方法中保持领先。

除了自动化评估,研究团队还进行了用户研究,邀请30位评估者(包括领域专家和非专家)对300个图像组合进行主观评价。评价维度包括主题层面的文字保真度、背景层面的文字保真度、主题相似度、构图质量和视觉吸引力。结果显示,UNO在所有维度上都获得了最高的用户评分,特别是在主题相似度和构图质量方面表现突出。

为了深入理解UNO各个组件的贡献,研究团队进行了详细的消融实验。这些实验就像拆解一台精密机器来理解每个零件的作用。结果显示,每个创新组件都对最终性能有重要贡献:没有重新生成的第二参考图像,性能下降明显;没有渐进式交叉模态对齐,效果也大打折扣;而没有UnoPE位置编码,性能下降最为严重。

特别值得注意的是渐进式训练策略的效果。对比实验表明,直接进行多图像训练的模型不仅在多主题任务上表现较差,即使在单主题任务上也不如采用渐进式策略的模型。这验证了"循序渐进"训练理念的正确性。

在计算资源的使用上,UNO也展现出良好的效率。通过LoRA微调技术,模型只需要调整很少的参数就能获得优秀的性能。研究团队测试了不同的LoRA秩(从4到512),发现秩为512时能够获得最佳的性能平衡。

七、丰富的应用场景展示

UNO系统的强大能力不仅体现在技术指标上,更体现在其丰富的应用场景中。通过大量的实际案例,我们可以看到这个系统如何在各种创意任务中发挥作用,就像一位多才多艺的艺术家能够适应不同的创作需求。

在基础的单主题和多主题生成任务中,UNO展现出了出色的细节保持能力。比如,当给定一个时钟的参考图像时,UNO不仅能够在新场景中准确再现时钟的整体形状和颜色,甚至连表盘上的数字、指针的位置等细微特征都能完美保留。这种精细度远超其他现有方法,有些方法虽然能生成类似的时钟,但往往丢失了这些关键细节。

在多主题组合方面,UNO能够巧妙地处理复杂的物体关系。例如,当要求同时展示一个玩具和一辆小车时,UNO不仅能保持每个物体的独特特征,还能根据文字描述将它们自然地融合到指定的场景中。更令人印象深刻的是,系统能够理解物体之间的相对关系,比如"玩具坐在小车上"或"小车停在玩具旁边"等复杂的空间配置。

值得特别关注的是UNO在一些特殊应用场景中的表现。在虚拟试穿领域,虽然UNO并没有专门针对这类任务进行训练,但它展现出了令人惊喜的泛化能力。系统能够理解服装与人体的关系,生成自然的试穿效果。这种能力的获得主要归功于训练数据中包含的丰富人物-物品组合,以及模型对物体关系的深层理解。

在身份保持任务中,UNO同样表现出色。系统能够在保持人物面部特征的同时,根据文字描述改变其服装、姿态或所处环境。比如,同一个人可以被置于不同的职业场景中——在实验室中作为科学家,在舞台上作为小提琴演奏家,或在艺术gallery中作为观众。每次转换都能保持人物的核心特征,同时完美适应新的环境要求。

令研究团队自己也感到意外的是,UNO在风格化生成方面也展现出了强大的能力。尽管训练数据中缺乏专门的风格化配对数据,但由于采用了从文本到图像再到主题到图像的渐进训练方式,模型继承了原始DiT在风格转换方面的能力。用户可以要求系统以吉卜力工作室的动画风格、漫画风格或3D卡通风格来重新演绎参考图像,效果都相当不错。

在产品设计和logo集成方面,UNO展现出了商业应用的潜力。系统能够理解品牌标识与产品的关系,将logo自然地融入到各种产品设计中。比如,可以将一个公司的logo印在T恤上、马克杯上,或者设计成贴纸贴在其他物品上。这种能力对于品牌营销和产品设计具有重要价值。

特别有趣的是UNO在故事生成方面的应用。通过连续的多主题生成,系统能够创造出连贯的视觉故事。比如,一个穿绿色衣服的男孩可以出现在游戏厅、城市街道、花园湖边、古塔脚下等不同场景中,每个场景都保持角色的一致性,同时展现不同的故事情节。这种能力为儿童读物插图、广告故事板制作等应用开辟了新的可能性。

在技术层面,这些丰富的应用场景说明了UNO的一个重要特点:强大的泛化能力。模型能够在没有专门训练的情况下处理各种不同的任务,这主要得益于其训练数据的多样性和渐进式训练策略的有效性。这种泛化能力使得UNO不仅仅是一个技术演示,而是一个真正具有实用价值的创作工具。

八、技术局限性与未来发展方向

尽管UNO在多个方面都取得了显著的突破,但研究团队也诚实地指出了当前系统的一些局限性,这种客观的态度体现了严谨的科学精神。

首先,当前的数据生成框架主要专注于主题驱动的生成任务。虽然系统在风格化和编辑方面展现出了一定的能力,但这些能力更多是从原始模型继承而来,而不是通过专门的训练获得的。因此,在复杂的图像编辑、精细的风格转换等任务上,UNO可能还无法达到专门为这些任务设计的系统的水平。

这个局限性的根源在于训练数据的特化程度。目前的自动化数据生成流水线主要产生主题一致性的图像对,缺乏其他类型的配对数据,比如同一场景的不同风格版本、同一物体的不同编辑状态等。要解决这个问题,需要进一步扩展数据生成策略,开发能够产生更多样化任务数据的自动化流程。

另一个潜在的局限性是对极端复杂场景的处理能力。虽然UNO能够很好地处理2-3个主题的组合,但当场景变得更加复杂,包含更多物体、更复杂的空间关系时,系统的表现可能会有所下降。这主要是因为当前的训练数据中,超过两个主题的样本相对较少,模型在这类场景上的训练还不够充分。

在计算效率方面,虽然UNO采用了LoRA微调技术来减少训练成本,但完整的数据生成流水线仍然需要相当的计算资源。特别是在数据质量筛选阶段,需要运行大型的视觉语言模型来评估每个图像对的质量,这在大规模应用时可能成为瓶颈。

研究团队也认识到,当前的评估体系主要关注技术指标,对于用户体验和创意质量的评估还有待完善。虽然进行了用户研究,但样本规模和评估维度都还有扩展的空间。特别是在创意产业的实际应用中,可能需要更加专业和细致的评估标准。

展望未来,研究团队提出了几个重要的发展方向。首先是数据类型的扩展,计划开发能够生成更多样化任务数据的自动化流程,包括风格转换、图像编辑、场景变换等。这将使UNO发展成为一个真正的多功能创作平台。

其次是模型架构的进一步优化。虽然当前的设计已经取得了良好的效果,但研究团队认为还有继续改进的空间。比如,可能开发更加高效的多模态注意力机制,或者设计专门针对多主题场景的架构模块。

在应用层面,研究团队计划与创意产业的实际用户进行更深入的合作,了解他们的具体需求,并据此改进系统功能。这种以用户为中心的开发策略将确保UNO能够真正解决实际问题,而不仅仅是技术展示。

另一个重要方向是系统的民主化。目前UNO的训练和部署还需要相当的技术门槛,研究团队希望能够开发更加用户友好的界面和工具,让更多的创作者能够使用这项技术。这可能包括开发Web应用、移动应用,或者与现有的创作软件进行集成。

最后,研究团队也在关注AI生成内容的伦理和安全问题。随着技术能力的不断提升,如何确保系统不被恶意使用,如何保护用户隐私和版权,都是需要认真考虑的问题。他们计划在未来的版本中加入更完善的安全机制和使用指导。

通过这种开放和前瞻性的态度,UNO项目不仅展现了当前的技术成就,也为整个AI图像生成领域的未来发展指明了方向。这种将技术突破与实际应用、伦理考量相结合的研究方式,正是推动AI技术健康发展的重要途径。

**Q&A**

Q1:UNO是什么?它能做什么? A:UNO是字节跳动开发的AI图像生成系统,它的核心能力是根据参考图片生成全新场景的图像。最特别的是,它不仅能处理单个物体,还能同时处理多个不同物体,将它们自然地融合到新场景中,就像一位能够同时参考多张照片进行创作的数字画家。

Q2:UNO会不会取代传统的图像设计工作? A:目前不会完全取代,但会大大改变图像设计的工作方式。UNO更像是设计师的智能助手,能够快速生成创意原型和多种方案,让设计师把更多时间投入到创意构思和细节优化上。它特别适合需要大量变体设计的场景,比如产品展示、广告创意等。

Q3:普通人如何使用UNO?有什么技术要求? A:目前UNO主要面向研究和开发社区,代码已在GitHub开源(https://github.com/bytedance/UNO)。不过运行它需要专业的GPU设备和一定的技术背景。研究团队表示正在开发更友好的用户界面,未来可能会有更容易使用的版本供普通用户体验。

好文章,需要你的鼓励

-

Adobe与UCLA联手突破AI模型速度瓶颈:让图像生成快一倍的"稀疏化魔法"

Adobe研究院与UCLA合作开发的Sparse-LaViDa技术通过创新的"稀疏表示"方法,成功将AI图像生成速度提升一倍。该技术巧妙地让AI只处理必要的图像区域,使用特殊"寄存器令牌"管理其余部分,在文本到图像生成、图像编辑和数学推理等任务中实现显著加速,同时完全保持了输出质量。

-

不用再训练AI模型,香港科技大学团队发明"智能管家",让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

-

韩国KAIST让SVG动画脱胎换骨:AI如何破解矢量图形的"语义迷宫"让静态图标活起来

韩国KAIST开发的Vector Prism系统通过多视角观察和统计推理,解决了AI无法理解SVG图形语义结构的难题。该系统能将用户的自然语言描述自动转换为精美的矢量动画,生成的动画文件比传统视频小54倍,在多项评估中超越顶级竞争对手,为数字创意产业带来重大突破。

-

华为诺亚方舟实验室新突破:不加内存也能让AI变聪明的神奇方法

华为诺亚方舟实验室提出VersatileFFN创新架构,通过模仿人类双重思维模式,设计了宽度和深度两条并行通道,在不增加参数的情况下显著提升大语言模型性能。该方法将单一神经网络分割为虚拟专家并支持循环计算,实现了参数重用和自适应计算分配,为解决AI模型内存成本高、部署难的问题提供了全新思路。