约翰霍普金斯大学重新定义视觉生成:VAR原来是伪装的扩散模型

这项由约翰霍普金斯大学的阿曼迪普·库马尔(Amandeep Kumar)、尼廷·戈帕拉克里希南·奈尔(Nithin Gopalakrishnan Nair)和维沙尔·帕特尔(Vishal M. Patel)领导的突破性研究发表于2025年9月,论文编号为arXiv:2509.22636v1。有兴趣深入了解的读者可以通过此编号查询完整论文。

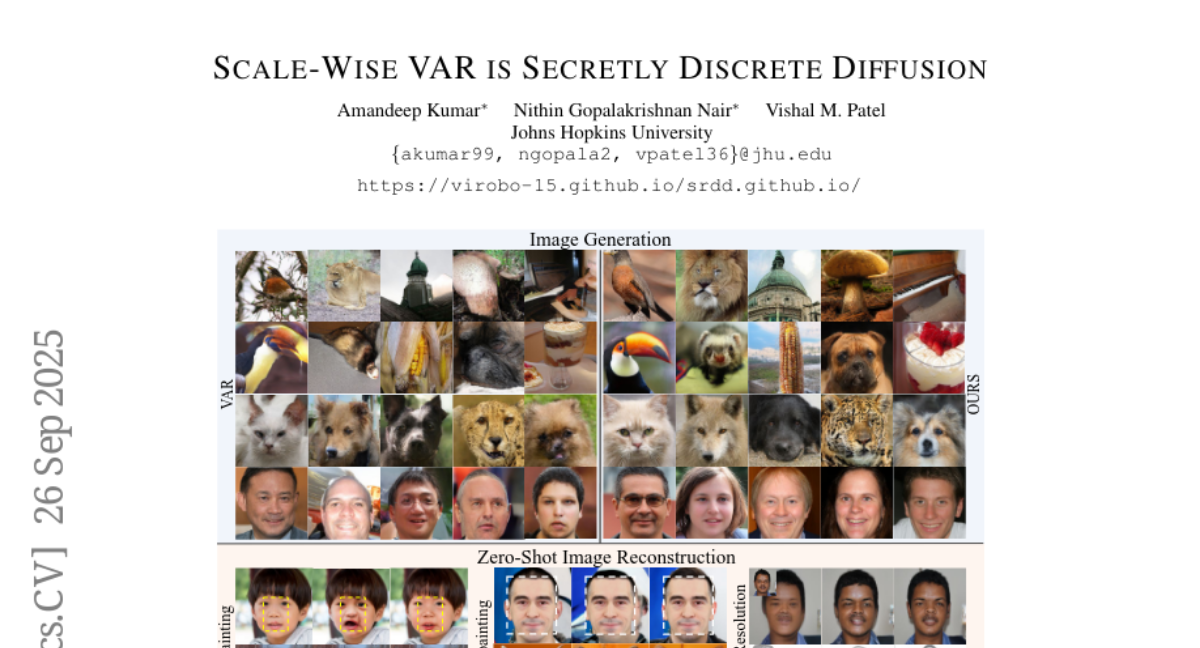

当人工智能在图像生成领域掀起一波又一波浪潮时,研究人员们一直在寻找更快、更好的方法来让机器"画画"。过去几年里,两种主要的技术路线一直在暗中较劲:一种是像写文章一样逐字逐句生成图像的自回归模型,另一种是像雕刻家一样从噪声中逐步雕琢出图像的扩散模型。最近,一种名为VAR(Visual Autoregressive Generation,视觉自回归生成)的新技术横空出世,它不是像传统方法那样一个像素一个像素地生成图像,而是一层一层地,从模糊到清晰地构建图像,就像摄影师调焦一样。

然而,约翰霍普金斯大学的研究团队在深入研究VAR的工作原理时,意外发现了一个令人震惊的秘密:当你对VAR做一些看似微小的调整后,它实际上就是一个扩散模型的变形!这就像发现两个看起来完全不同的菜谱,实际上做的是同一道菜。研究团队将这个新发现命名为SRDD(Scalable Visual Refinement with Discrete Diffusion,可扩展的离散扩散视觉精化),为这两种看似不同的技术架起了一座理论桥梁。

这个发现不仅仅是学术上的巧合,它带来了实实在在的好处。通过运用扩散模型的成熟技术,研究团队让VAR跑得更快、效果更好,在图像修复、超分辨率等任务上也表现得更加出色。更重要的是,这为未来的视觉生成技术发展指明了一条更加清晰的道路。

一、揭开VAR的神秘面纱:从像素艺术家到焦距调节师

要理解这项研究的重大意义,我们首先需要了解传统的图像生成方法存在什么问题。早期的自回归图像生成模型就像一个按部就班的画家,必须严格按照从左到右、从上到下的顺序来画每一个像素点。这种方法有个明显的缺陷:当画家在画左上角的时候,他根本不知道右下角要画什么,这就导致整幅画缺乏全局的协调性。

VAR的出现改变了这个游戏规则。它不再一个像素一个像素地工作,而是像摄影师调节镜头焦距一样,先拍出一张模糊的照片,然后逐渐调清晰。具体来说,VAR会先生成一个非常小的、模糊的图像版本,然后逐步增加分辨率,每一步都让图像变得更加清晰和详细。这就像你在显微镜下观察细胞:先用低倍镜看到大致轮廓,再用高倍镜看清细节。

VAR的这种"分层生成"方法带来了显著的优势。由于它在每个分辨率层级都能看到整幅图像的全貌,所以生成的图像在全局一致性方面要比传统方法好得多。而且,由于不需要按照固定顺序生成每个像素,VAR的训练和推理过程都更加高效。

然而,约翰霍普金斯大学的研究团队在深入分析VAR的数学原理时,发现了一个有趣的现象。原始的VAR在生成下一个分辨率层级时,会参考之前所有的分辨率层级,就像一个学生在考试时可以翻阅之前所有的笔记。但研究团队发现,如果让VAR只参考紧邻的上一个分辨率层级(就像只能看前一页笔记),不仅效果不会变差,反而会变得更好。

这个发现引起了研究团队的好奇心。他们决定深入探究这种"马尔可夫"变体(只依赖前一步状态的模型)的数学本质,结果发现了一个令人震惊的真相。

二、意外的发现:VAR的真面目

当研究团队仔细分析VAR的马尔可夫变体时,他们发现了一个数学上的巧合,这个巧合改变了他们对VAR本质的理解。原来,当VAR只依赖前一个分辨率层级来生成下一个层级时,它的数学形式与离散扩散模型几乎完全一致。

这里需要解释一下什么是扩散模型。扩散模型就像一个魔法师的逆向表演:正常情况下,如果你把一滴墨水滴到水中,墨水会慢慢扩散直到完全消失在水中。扩散模型就是要学会这个过程的反向操作——从一杯看似清澈的水中,重新聚集出那滴墨水。在图像生成中,这意味着从纯噪声开始,逐步"去噪"直到得到清晰的图像。

研究团队发现,VAR的分层生成过程实际上可以理解为一种特殊的扩散过程。在这个过程中,最低分辨率的图像相当于"噪声状态",而最高分辨率的图像相当于"清晰状态"。每一次分辨率的提升,都相当于扩散模型中的一次"去噪"步骤。

这个发现有三个关键的证据支撑。首先,VAR在生成过程中确实在处理不同程度的"降质"信息——低分辨率图像可以看作是高分辨率图像的降质版本,这与扩散模型处理不同噪声水平的方式一致。其次,VAR使用交叉熵损失函数来训练模型预测分类分布,这与离散扩散模型的训练方式完全相同。最后,也是最重要的,VAR在生成过程中展现出了逐渐增加的信噪比(SNR)模式,这正是扩散模型的典型特征。

基于这个发现,研究团队提出了SRDD(Scalable Visual Refinement with Discrete Diffusion)的概念,正式将VAR的马尔可夫变体与离散扩散模型联系起来。这不仅是一个理论上的突破,更重要的是,它为改进VAR的性能提供了全新的思路。

三、理论指导实践:扩散模型的智慧如何改进VAR

既然发现VAR本质上是一种离散扩散模型,研究团队立即意识到,他们可以借鉴扩散模型领域多年积累的经验和技术来改进VAR。这就像发现两个看似不同的机器实际上使用相同的原理,你就可以把一个机器的优化技术应用到另一个上。

第一个重要的改进是分类器自由引导(Classifier-Free Guidance)的应用。这个技术在扩散模型中已经非常成熟,它的工作原理就像一个有经验的导游:在带你参观博物馆时,导游不仅会告诉你"这是什么"(条件信息),还会提醒你"这不是什么"(无条件信息)。通过这种正反两面的引导,模型生成的图像会更加符合用户的要求。

研究团队发现,原始VAR在使用分类器自由引导时表现不稳定,引导强度稍高就会导致图像质量急剧下降。但是,SRDD由于其扩散模型的本质,能够更好地处理这种引导,即使在较高的引导强度下也能保持稳定的性能。这就像一个熟练的司机能够在各种路况下平稳驾驶,而新手司机遇到复杂路况就容易出问题。

第二个重要改进是令牌重采样(Token Resampling)技术。这个技术的思路很直观:在每个生成步骤中,模型会对自己生成的结果进行"自我检查",如果发现某些部分的置信度较低(就像写作时对某个词汇不确定),就会重新生成这些部分。具体来说,SRDD会计算每个图像区域的预测概率,对于概率低于某个阈值的区域进行重新采样,这样可以显著提高最终图像的质量。

第三个改进是简单重采样策略,灵感来自扩散模型增加采样步数可以提高质量的经验。SRDD允许在每个分辨率层级进行多次精化,就像画家在完成一幅画时会反复修改细节一样。虽然这会增加一些计算时间,但换来的是显著的质量提升。

第四个重要改进是模型蒸馏技术。这个技术的核心思想是"师傅带徒弟":先训练一个复杂的"教师"模型,然后训练一个简化的"学生"模型来模仿教师的行为。在SRDD中,研究团队发现可以跳过某些中间分辨率层级而不显著影响最终质量,这样就能在保持性能的同时大幅减少计算量。

这些改进的效果是立竿见影的。在多个数据集上的实验表明,SRDD相比原始VAR在图像质量指标上有显著提升,同时推理速度更快,内存使用更少。

四、实验验证:数字说话的时刻

理论再漂亮,也需要实实在在的实验数据来验证。研究团队在四个不同的数据集上进行了全面的实验,这些数据集就像不同类型的考试,每个都测试模型的不同能力。

首先是MiniImageNet数据集,这是一个包含各种物体和场景的图像集合,就像一个小型的"万物图鉴"。在这个数据集上,SRDD相比VAR的FID(Fréchet Inception Distance,一个衡量图像质量和多样性的指标)从21.01降低到16.76,相当于提升了20.2%。FID分数越低表示生成的图像质量越好,这个提升幅度相当可观。

在SUN397数据集(一个场景识别数据集)上,SRDD的表现同样出色,FID从15.72降低到13.26,提升了15.6%。FFHQ数据集专门用于人脸图像生成,SRDD在这里的FID从19.23降低到17.37。AFHQ数据集则专注于动物脸部图像,SRDD同样实现了显著改进。

除了FID指标,研究团队还测试了IS(Inception Score,另一个图像质量指标)。在所有测试的数据集上,SRDD都实现了一致的改进,提升幅度从6.7%到31.1%不等。这些数字可能看起来抽象,但在图像生成领域,即使几个百分点的改进也代表着巨大的进步。

更有趣的是零样本性能测试。所谓零样本,就是让模型做它从来没有专门训练过的任务,就像让一个只学过画静物的画家去画人像。研究团队测试了SRDD在图像修复(修补图像中的缺失部分)、图像外扩(扩展图像边界)和超分辨率(将低分辨率图像变成高分辨率)等任务上的表现。

在图像修复任务中,SRDD的LPIPS指标(衡量图像感知相似度)从0.26降低到0.23,FID从29.92降低到28.79。虽然改进幅度看起来不大,但要知道这是在模型没有专门针对这个任务训练的情况下实现的,这说明SRDD确实具有更好的泛化能力。

研究团队还进行了详细的消融实验,就像医生要弄清楚是哪种药物起了作用一样。他们逐个测试了每项改进技术的贡献。结果表明,从原始VAR改为马尔可夫注意力机制这一步就能带来显著改进,然后加入分类器自由引导、重采样技术等进一步提升性能,每一步改进都有其独特的价值。

五、技术细节:魔鬼藏在细节里

对于想要深入理解这项研究的读者来说,一些技术细节值得进一步探讨。首先是马尔可夫注意力机制的具体实现。原始VAR使用块状因果掩码,允许每个分辨率层级的生成过程参考之前所有层级的信息。而SRDD使用的马尔可夫掩码只允许参考紧邻的前一个层级,这种限制看似减少了可用信息,但实际上提高了模型的效率和效果。

这种改进的原理可以用信息过载来解释。当一个学生在学习新知识时,如果同时接收太多相关信息,反而可能会分散注意力,影响学习效果。同样,当VAR试图同时参考太多之前的分辨率层级时,也可能会被无关信息干扰,影响当前层级的生成质量。

令牌重采样技术的实现也有其巧妙之处。SRDD在每个分辨率层级计算每个令牌的预测概率,然后设定一个阈值(实验中发现0.01是一个较好的选择)。对于概率低于阈值的令牌,系统会进行重新采样。这个过程通常重复5次左右就能获得最佳效果,继续增加重采样次数带来的改进会越来越小。

分类器自由引导的实现则更加微妙。这个技术需要在训练时同时学习条件生成(比如"生成一只猫的图像")和无条件生成("生成任意图像")。在推理时,模型会同时产生这两种预测,然后通过数学运算将结果推向条件分布而远离无条件分布。引导强度的选择很关键:太低起不到引导作用,太高会导致图像看起来不自然。

模型蒸馏技术允许SRDD在保持性能的同时减少计算量。研究团队发现,可以从原始的10个分辨率层级减少到6个,只要保留最后两个高分辨率层级(因为它们包含重要的细节信息),就能实现约20%的速度提升而几乎不损失质量。

六、更广阔的影响:一座桥梁的意义

这项研究的意义远远超出了技术层面的改进。它在自回归模型和扩散模型之间架起了一座理论桥梁,这种连接为未来的研究开启了新的可能性。

从理论角度来看,这项研究证明了看似不同的技术路线实际上可能有着深层的内在联系。这种发现在科学史上并不罕见:比如波动光学和粒子光学最终统一为量子光学,看似矛盾的理论实际上描述的是同一现象的不同侧面。SRDD的发现可能预示着视觉生成领域也将出现类似的理论统一。

从实用角度来看,这项研究为改进现有技术提供了新的思路。既然VAR可以看作是离散扩散模型,那么扩散模型领域积累的大量技术和经验都可以应用到VAR上。这就像发现了一个新的"技术移植"路径,可以让两个领域的进展互相促进。

研究团队还展示了SRDD在扩展性方面的优势。他们发现,随着模型参数的增加,SRDD展现出了与VAR相似的扩展规律,这意味着这种方法可以很好地适应未来更大规模的模型。这种扩展性对于实际应用来说至关重要,因为在AI领域,模型的规模往往与性能直接相关。

另一个重要的影响是对多模态生成的启发。现在越来越多的应用需要同时处理文本、图像、音频等多种模态的信息。SRDD建立的理论框架可能为开发统一的多模态生成模型提供思路,让同一个模型能够在不同模态之间灵活切换。

七、未来展望:开启新的可能性

基于这项研究的发现,未来的研究方向变得更加清晰和丰富。首先是扩大实验规模的问题。由于计算资源的限制,当前的实验主要在中等规模的数据集上进行。未来的研究需要在更大规模的数据集(如完整的ImageNet)和更高分辨率的图像上验证SRDD的效果。

学习型重采样策略是另一个有前途的方向。目前的重采样使用固定的概率阈值,但理想情况下,这个阈值应该根据图像内容和生成阶段动态调整。研究团队建议开发小型的策略网络来学习何时何地进行重采样,这可能会进一步提高效率和效果。

连续离散混合扩散是一个更加雄心勃勃的想法。SRDD在离散潜在空间中操作,而传统扩散模型在连续空间中工作。一个自然的想法是开发混合系统:在粗分辨率层级使用SRDD的高效性,在细分辨率层级使用连续扩散的精细控制能力。

扩展到更多应用场景也是重要的发展方向。除了静态图像生成,SRDD的原理可能也适用于视频生成、3D模型生成等更复杂的任务。视频生成尤其有趣,因为它本质上也是一个分层的过程:从关键帧到中间帧,从粗略运动到精细细节。

最后,这项研究为开发更统一的生成模型理论奠定了基础。随着对不同生成模型之间内在联系的理解加深,未来可能出现能够无缝集成各种生成技术优势的统一框架。

说到底,约翰霍普金斯大学这项研究的最大价值不仅在于改进了一个具体的技术,更在于它展示了科学研究中"意外发现"的力量。当研究人员抱着开放的心态深入探索技术的本质时,往往会发现令人惊喜的联系和可能性。VAR与扩散模型的内在联系就是这样一个例子,它提醒我们,在快速发展的AI领域,保持好奇心和深入思考的重要性。

这种发现不仅推动了技术的进步,也为整个领域的发展指明了新的方向。正如研究团队在论文中所说,这项工作"为可扩展和统一的视觉生成开启了新的方向"。对于普通人来说,这意味着未来我们可能会看到更快、更好、更智能的图像和视频生成技术,这些技术将在创意设计、娱乐制作、教育培训等各个领域发挥重要作用。

有兴趣深入了解这项研究技术细节的读者,可以通过论文编号arXiv:2509.22636v1查询完整的研究报告,其中包含了详细的数学推导、实验设置和结果分析。

Q&A

Q1:SRDD相比原始VAR模型有什么具体改进?

A:SRDD主要有四个方面的改进:首先是使用马尔可夫注意力机制,只参考前一个分辨率层级而不是所有层级;其次是应用分类器自由引导技术,提高生成图像的质量;再次是令牌重采样,对低置信度区域进行重新生成;最后是模型蒸馏,可以跳过某些分辨率层级来提高效率。实验显示,SRDD在FID指标上相比VAR提升了15-20%。

Q2:为什么说VAR本质上是扩散模型?

A:研究团队发现VAR的马尔可夫变体在数学形式上与离散扩散模型几乎完全一致。VAR的分层生成过程可以理解为特殊的扩散过程:低分辨率图像相当于"噪声状态",高分辨率图像相当于"清晰状态",每次分辨率提升都相当于一次"去噪"步骤。而且VAR在生成过程中展现出逐渐增加的信噪比模式,这正是扩散模型的典型特征。

Q3:SRDD技术有什么实际应用价值?

A:SRDD不仅在图像生成质量上有显著提升,还在零样本任务上表现出色,包括图像修复、超分辨率和图像外扩等。由于其扩散模型的本质,SRDD可以借鉴扩散模型领域的成熟技术,为未来开发更统一的多模态生成模型提供思路。这意味着在创意设计、娱乐制作、教育培训等领域都将有更好的AI工具可用。

好文章,需要你的鼓励

-

Queen's大学重磅研究:程序员的角色即将彻底改变,从码农到智能体指挥官

Queen's大学研究团队提出结构化智能体软件工程框架SASE,重新定义人机协作模式。该框架将程序员角色从代码编写者转变为AI团队指挥者,建立双向咨询机制和标准化文档系统,解决AI编程中的质量控制难题,为软件工程向智能化协作时代转型提供系统性解决方案。

-

医疗AI的"显微镜革命":西北工业大学团队发布首个超声影像专用智能助手EchoVLM

西北工业大学与中山大学合作开发了首个超声专用AI视觉语言模型EchoVLM,通过收集15家医院20万病例和147万超声图像,采用专家混合架构,实现了比通用AI模型准确率提升10分以上的突破。该系统能自动生成超声报告、进行诊断分析和回答专业问题,为医生提供智能辅助,推动医疗AI向专业化发展。

-

上海AI实验室突破自回归图像生成瓶颈:ST-AR让AI"先理解再创造"

上海AI实验室团队发现自回归图像生成模型存在局部依赖、语义不一致和空间不变性缺失三大问题,提出ST-AR训练方法。该方法通过掩码注意力、跨步骤对比学习和跨视角对比学习,让AI"先理解再生成"。实验显示,ST-AR将LlamaGen模型的图像理解准确率提升一倍以上,图像生成质量提升42-49%,为构建更智能的多模态AI系统开辟新路径。