所有节目1秒钟变裸眼3D 今年国内或可见成品上市

裸眼3D技术已经推出多年,各种不同原理的技术纷纷出现在市场上,但整个3D市场一直都处于不温不火的状态,其中的原因,3D观看不舒服是一个方面,3D片源过少又是一个方面,在CES2014上,有一家厂商试图去解决这个问题,并且据了解他们已经和国内一些电视厂商展开合作,今年一些成品有可能将会陆续上市。

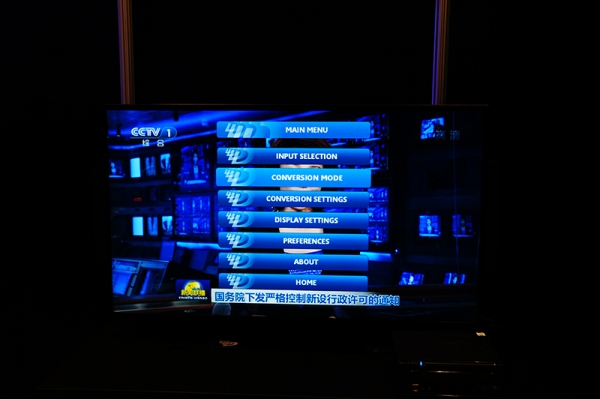

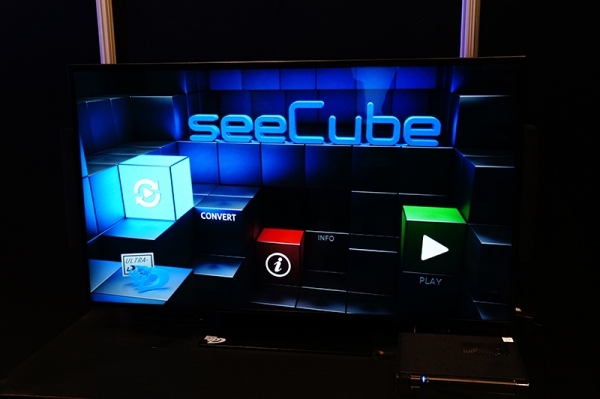

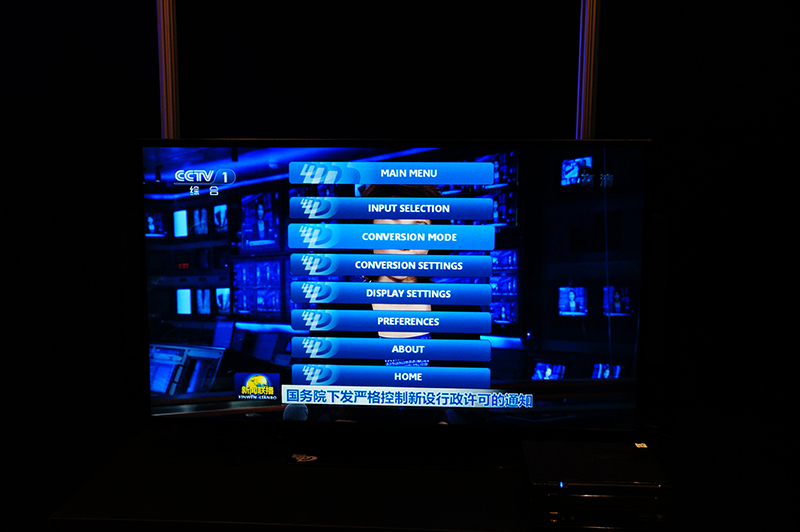

这家裸眼3D解决方案供应商叫做StreamTV Networks,他们采用柱状透镜式的裸眼3D原理,比较有特色的功能有几点:首先,我们可以自由的调节3D的景深,这个主要用于防止长期观看3D视频造成的眩晕,我们可以根据家庭电视摆放位置和每个人对景深的不同感受调节到最舒适的位置;其次是,它们可以实现将普通的2D电视节目信号实时的转换成为3D输出,经过我们的现场体验,效果还是比较明显的,尤其对于体育节目,立体感极强,当然效果仍然比不上3D片源的输出效果,配图就是我们在现场实时的将新闻联播转成3D信号,当然相机拍不出3D效果,从人眼角度看还是很不错的;第三是成本较低,我们了解到StreamTV Networks的技术不会给电视厂商带来过大的成本压力,他们可以用更低的成本向市场销售裸眼3D电视终端。

目前StreamTV Networks已经和一些电视厂商展开合作,今年这些厂商或许将会推出一些裸眼3D的成品。

[video]uu=dfa091e731&vu=5aebbf53b3&auto_play=0&width=600&height=450[/video]

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。