Linux主导超级计算机领域 占有率达97%

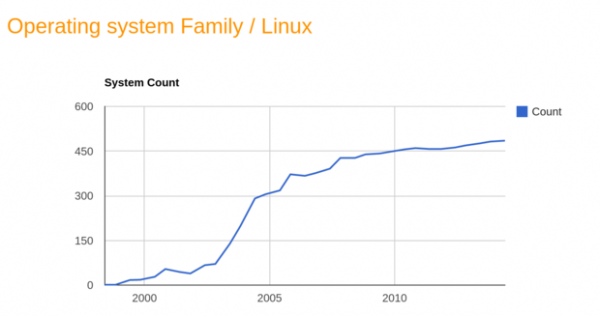

在世界最快超级计算机500强排行中,Linux不仅占据主导地位,而且逐渐将对手远远甩在身后。500强中,有97%的超级计算机是基于Linux。剩余的16强中,有13台运行Unix,2台是Windows超级计算机,剩余一台是AIX/Unix和Linux综合体。Solaris与BSD Unix不再出现在榜单中。

此次排名中,超级计算机的总体性能增长出现下降趋势。第500名超级计算机的性能增长远远落后于过去5年最后一名的性能增长,仅为55%,而在1994年到2008年间,第500名的超级计算机的年均性能增长是90%。

为了让超级计算机的运行速度更快,硬件厂商不断推出更快的处理器。英特尔即将发布的Xeon Phi处理器的单颗处理核心每秒的运行速度将达到3 Teraflops,这种处理器为多核芯片。这一速度比英特尔目前最快处理器的速度快三倍。

与此同时,Linux正在突破自身的性能瓶颈。在Linux已经成为超级计算机的主流系统的背景下,这样做的动因不仅是出于追求更快计算机的理想,而且是来自股票市场和交易公司的压力。

好文章,需要你的鼓励

-

当善良声音变身恶意武器:AIM Intelligence团队揭秘音频AI的隐藏危机

AIM Intelligence联合多所知名大学揭示了音频AI系统的重大安全漏洞,开发出名为WhisperInject的攻击方法。这种攻击能让看似无害的音频指令操控AI生成危险内容,成功率超过86%,完全绕过现有安全机制。研究暴露了多模态AI系统的系统性安全风险,对全球数十亿智能设备构成潜在威胁。

-

新加坡国立大学团队揭示:让AI既能看又能做的视觉强化学习新突破

新加坡国立大学研究团队系统梳理了视觉强化学习领域的最新进展,涵盖超过200项代表性工作。研究将该领域归纳为四大方向:多模态大语言模型、视觉生成、统一模型框架和视觉-语言-动作模型,分析了从RLHF到可验证奖励范式的政策优化策略演进,并识别出样本效率、泛化能力和安全部署等关键挑战,为这一快速发展的交叉学科提供了完整的技术地图。

-

浙大团队揭秘:为什么AI机器人在现实世界中总是"掉链子"?OmniEAR基准测试暴露惊人真相

浙江大学研究团队通过OmniEAR基准测试揭示了当前AI模型在物理世界推理方面的严重缺陷。测试显示,即使最先进的AI在明确指令下能达到85-96%成功率,但面对需要从物理约束推断行动的任务时,成功率骤降至56-85%。研究发现信息过载反而降低AI协作能力,监督学习虽能改善单体任务但对多智能体协作效果甚微,表明当前架构存在根本局限性。

-

AI模型训练中藏着的秘密巨人:纽约大学和Aimpoint Digital Labs发现Transformer里的"超级激活"如何悄悄控制整个模型

纽约大学和Aimpoint Digital Labs的研究团队首次揭示了Transformer模型训练中"大规模激活"的完整发展轨迹。这些影响力比普通激活大千倍的"超级激活"遵循可预测的数学规律,研究者开发出五参数公式能以98.4%准确率预测其变化。更重要的是,通过调整模型架构参数如注意力密度、宽深比等,可以在训练前就预测和控制这些关键激活的行为,为设计更高效、量化友好的AI模型提供了全新工具。