Google:新版Android将使应用性能提高1倍

Google当地时间周三在Google I/O开发者会议上宣布,“L”版Android将采用一种全新的软件基础技术,使应用性能提升1倍。

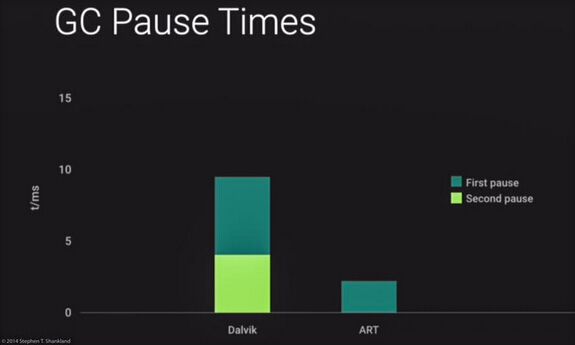

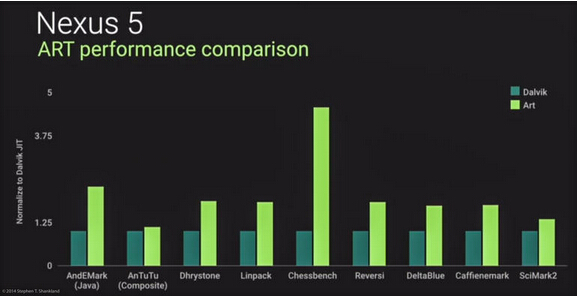

名为Android Runtime(ART)的软件层将取代目前的Dalvik软件。Dalvik的任务是运行为Android智能手机和平板电脑编写的应用。Android技术主管戴夫·伯格(Dave Burke)援引大量测试结果称,ART将能使Android应用性能翻一番,“应用无须进行任何调整、优化,应用性能的提升是‘免费’的”。

性能对于移动应用非常重要。性能的提高使开发者能开发具有更复杂功能的应用,为工具类软件添加更有趣的界面,吸引用户更多地运行移动应用。

Google去年在Android 4.4 KitKat中引入了原型版ART,但默认情况下没有激活。原型版ART存在部分兼容性问题,现在Google显然认为它已经解决了这一ART存在的问题。伯克说,开发者无须对软件进行任何改动。

ART还引入了一个大变化:支持64位芯片。ART支持ARM的64位ARMv8架构、英特尔和AMD的64位X86、MIPS的MIPS64。

苹果已经转向64位计算技术,使用户能使用新的加速功能,访问超过4GB的内存。Android生态链也将转向64位。

好文章,需要你的鼓励

-

如何让AI像电影配乐师一样创作完整的长篇音频故事——腾讯ARC实验室团队AudioStory突破性进展

腾讯ARC实验室推出AudioStory系统,首次实现AI根据复杂指令创作完整长篇音频故事。该系统结合大语言模型的叙事推理能力与音频生成技术,通过交错式推理生成、解耦桥接机制和渐进式训练,能够将复杂指令分解为连续音频场景并保持整体连贯性。在AudioStory-10K基准测试中表现优异,为AI音频创作开辟新方向。

-

Meta与特拉维夫大学联手打造VideoJAM:让AI生成的视频动起来不再是奢望

Meta与特拉维夫大学联合研发的VideoJAM技术,通过让AI同时学习外观和运动信息,显著解决了当前视频生成模型中动作不连贯、违反物理定律的核心问题。该技术仅需添加两个线性层就能大幅提升运动质量,在多项测试中超越包括Sora在内的商业模型,为AI视频生成的实用化应用奠定了重要基础。

-

上海AI实验室重磅发布:让AI看图"说人话"的神奇训练法,解决多模态AI与人类价值观对齐难题

上海AI实验室发布OmniAlign-V研究,首次系统性解决多模态大语言模型人性化对话问题。该研究创建了包含20万高质量样本的训练数据集和MM-AlignBench评测基准,通过创新的数据生成和质量管控方法,让AI在保持技术能力的同时显著提升人性化交互水平,为AI价值观对齐提供了可行技术路径。

-

谷歌研究团队发布超级预测模型:让AI像天气预报员一样预测全球大气变化

谷歌DeepMind团队开发的GraphCast是一个革命性的AI天气预测模型,能够在不到一分钟内完成10天全球天气预报,准确性超越传统方法90%的指标。该模型采用图神经网络技术,通过学习40年历史数据掌握天气变化规律,在极端天气预测方面表现卓越,能耗仅为传统方法的千分之一,为气象学领域带来了效率和精度的双重突破。