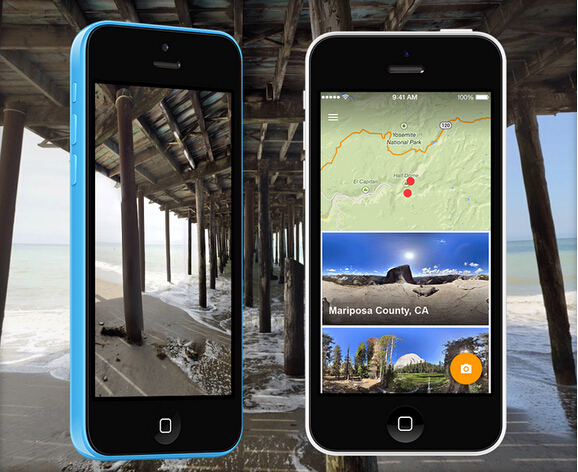

谷歌发布iOS版Photo Sphere照片应用

谷歌于当地时间本周二表示,该公司将发布iOS版Photo Sphere应用,此前该应用仅可在Android操作系统上使用。

Photo Sphere应用允许用户对某一景象360度全景抓拍,并自动将图片合成为一张全景图,用户可向左、向右、向上、向下全方位地欣赏其全景照片。此外用户还可以将这些照片分享到他们的社交网络或谷歌地图中。而且当用户在谷歌地图上浏览这些照片时,该公司将自动为用户挑选一些与当地相匹配的照片。

谷歌地图和全景照片产品经理伊凡·兰普波特(Evan Rapoport)曾在一份声明中表示,将该照片应用与地图一体化的目标之一是帮助人们“探索世界。”

对谷歌来说,推出iOS版Photo Sphere照片应用这种小拓展的效果是双重的。它有助于增建该公司的地图应用,争取更多用户,帮助他们标记下每一个独特的地方。同时这也符合谷歌要确保其照片产品得以最大推广的愿望——即使这意味着这款应用将登陆其竞争对手的移动平台。

本月早些时候,有新闻报道称谷歌正计划解除其广受欢迎的照片功能与其羽翼未丰的Google +社交网络之间的绑定。此外,谷歌还在去年10月份对这项功能进行了改进,其中包括一些新的算法,它们能够使用户在大量存储的照片中更容易地进行搜索,更好地备份照片文件。该公司还推出了一项名为Auto Awesome Movie的视频直播版照片编辑功能,方便用户通过拼接影片片段来快速构建电影,同时这款软件还添有背景音乐和滤声器。

当时担任Google+负责人的维克·古多塔(Vic Gundotra)现已离开了谷歌,过去他曾表示,这款Photo Sphere服务正“试图改变摄影界”。

好文章,需要你的鼓励

-

Snowflake AI挑战传统语言学:万千茫茫文字中,LLM真的只是"随机鹦鹉"吗?

这项由Snowflake AI Research发表的研究挑战了传统语言学对大型语言模型的批评,通过引入波兰语言学家Mańczak的理论框架,论证了LLM的成功实际上验证了"频率驱动语言"的观点。研究认为语言本质上是文本总和而非抽象系统,频率是其核心驱动力,为重新理解AI语言能力提供了新视角。

-

Yale大学团队推出"免费博士劳工":让AI研究助手像真人团队一样工作的革命性框架

freephdlabor是耶鲁大学团队开发的开源多智能体科研自动化框架,通过创建专业化AI研究团队替代传统单一AI助手的固化工作模式。该框架实现了动态工作流程调整、无损信息传递的工作空间机制,以及人机协作的质量控制系统,能够自主完成从研究构思到论文发表的全流程科研工作,为科研民主化和效率提升提供了革命性解决方案。

-

德国马普所团队发明"智能大脑重新布线"技术:让AI专家模型学会即时调整自己

德国马普智能系统研究所团队开发出专家混合模型的"即时重新布线"技术,让AI能在使用过程中动态调整专家选择策略。这种方法无需外部数据,仅通过自我分析就能优化性能,在代码生成等任务上提升显著。该技术具有即插即用特性,计算效率高,适应性强,为AI的自我进化能力提供了新思路。

-

聊天机器人怎么不在线聊天中"迷路"?Algoverse AI研究团队的熵值导航新突破

Algoverse AI研究团队提出ERGO系统,通过监测AI对话时的熵值变化来检测模型困惑程度,当不确定性突然升高时自动重置对话内容。该方法在五种主流AI模型的测试中平均性能提升56.6%,显著改善了多轮对话中AI容易"迷路"的问题,为构建更可靠的AI助手提供了新思路。