甲骨文推出Social Station 旨在加强社会云

为在社会企业竞争中取得胜利,甲骨文公司仍继续为之奋斗着。当地时间本周三,甲骨文公司在其SRM平台内推出了一个新的工作区,该企业巨头表示,这个新工作区将通过“令人叹服的”新用户界面来提高用户工作效率。

甲骨文为这个工作区取名为Social Station,旨在给用户更多的分析能力和控制权,但却不需要用户太多的点击量。

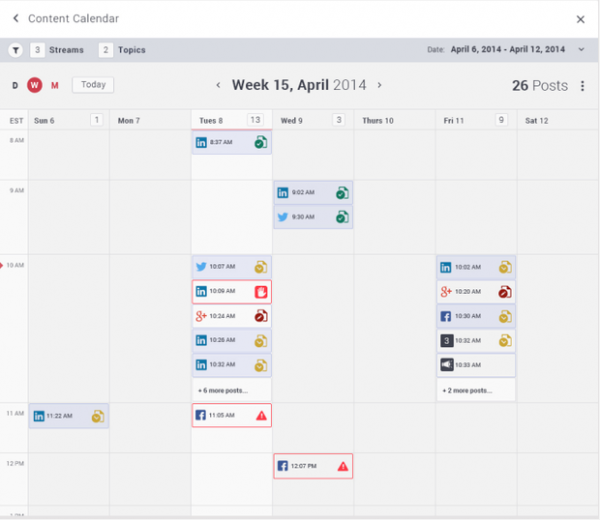

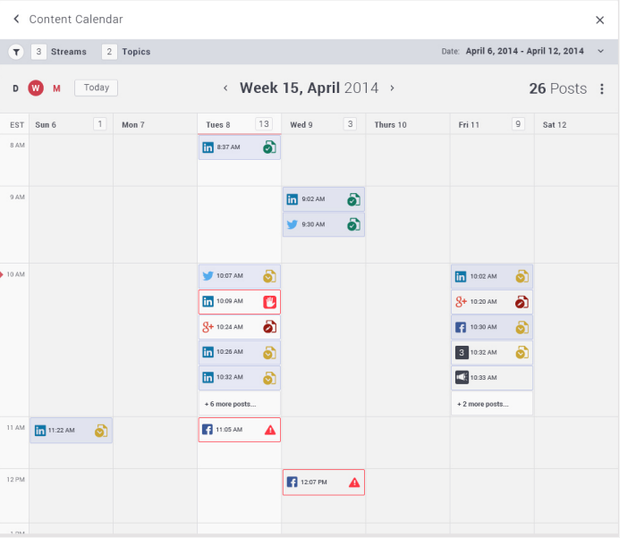

而这均通过新的用户体验得以实现的,其中主要以拖放操作功能、一键分享和多视图布局为特色。此外还有一个增强版日历模块,旨在为用户的网站内容、帖子、关系网和视图提供更多可视化的描述。同时,这个Social Station还推出了一个新的分析模块,允许用户通过大量的报告对对社会数据的自定义视图进行实时综合分析。

甲骨文社交云集团副总裁梅格·贝尔(Meg Bear)在一份声明中表示:“通过不断地改善我们的产品,我们希望能为我们的客户带来竞争优势,而Social Station便为他们提供了一个动态的用户体验,提供用户工作效率以及社会化商业成果。我们通过让用户比以往更轻松地在整个企业中理解、报告以及分析他们的社会见解,使我们的用户能够与时俱进,使他们能够影响企业的业务指标和策略。”

通过收购社交营销平台Vitrue、SNS监测平台Collective Intellect以及Involver,甲骨文整合加强了其SRM平台,并继续为其添加新功能,集成到平台中。

甲骨文表示,该公司计划继续通过新的模块来构建这个Social Station,例如增加内容管理、影响者的参与和指挥中心的创建等模块。

好文章,需要你的鼓励

-

Adobe与UCLA联手突破AI模型速度瓶颈:让图像生成快一倍的"稀疏化魔法"

Adobe研究院与UCLA合作开发的Sparse-LaViDa技术通过创新的"稀疏表示"方法,成功将AI图像生成速度提升一倍。该技术巧妙地让AI只处理必要的图像区域,使用特殊"寄存器令牌"管理其余部分,在文本到图像生成、图像编辑和数学推理等任务中实现显著加速,同时完全保持了输出质量。

-

不用再训练AI模型,香港科技大学团队发明"智能管家",让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

-

韩国KAIST让SVG动画脱胎换骨:AI如何破解矢量图形的"语义迷宫"让静态图标活起来

韩国KAIST开发的Vector Prism系统通过多视角观察和统计推理,解决了AI无法理解SVG图形语义结构的难题。该系统能将用户的自然语言描述自动转换为精美的矢量动画,生成的动画文件比传统视频小54倍,在多项评估中超越顶级竞争对手,为数字创意产业带来重大突破。

-

华为诺亚方舟实验室新突破:不加内存也能让AI变聪明的神奇方法

华为诺亚方舟实验室提出VersatileFFN创新架构,通过模仿人类双重思维模式,设计了宽度和深度两条并行通道,在不增加参数的情况下显著提升大语言模型性能。该方法将单一神经网络分割为虚拟专家并支持循环计算,实现了参数重用和自适应计算分配,为解决AI模型内存成本高、部署难的问题提供了全新思路。