经调查 苹果否认不雅照流出源于iCloud系统被攻破

苹果日前向科技网站Record表示,该公司正在“积极调查”其iCloud账户是否被黑,今天,苹果对近来发生的攻击事件和明星照片泄露发布了一份声明。

在当地时间周日,包括詹妮弗·劳伦斯和凯特·厄普顿等明星的不雅照及视频被发布到图片共享网站4chan后,苹果“动员了苹果旗下的工程师们探寻其泄露根源。”

在部分声明中,苹果表示:

“经过40多个小时的调查后,我们发现,某些明星的账户受损主要源于一个非常有针对性的攻击,这种攻击主要针对用户的用户名、密码和安全问题,而这种做法在互联网上已经非常普遍了。”

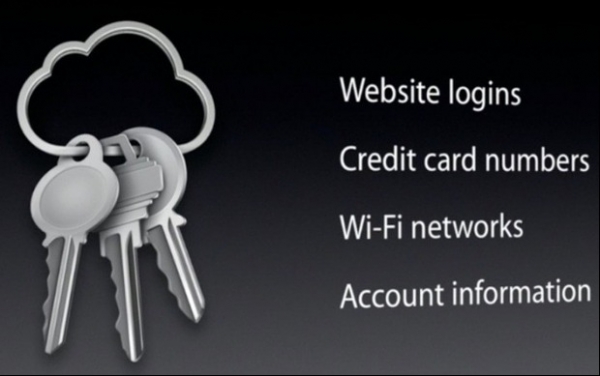

在这份声明中,苹果声称其iCloud和“找到我的iPhone”功能并未被攻破:

据我们调查,没有任何情况表明(本次泄露事件)是因任何苹果系统被攻破而造成的,包括iCloud和“找到我的iPhone”功能在内。

苹果精心地为这份声明进行了措辞,而且并没有直接否认这些数据来自iCloud或“找到我的iPhone”功能。相反,苹果表示在他们所调查的情况中,并未有原因表明苹果系统被攻破。这可以解释为,假设苹果的调查并不完整,那么到目前为止,调查并未发现有任何迹象指明iCloud被黑客攻破。

有人猜测,这些不雅照可能来自用户的iCloud备份(而非iCloud照片),因为这次泄露的数据中包含一些视频,而视频目前并不直接存储在iCloud中。

在图片共享网站4chan暗示这些不雅照可能来自“iCloud”后,苹果最初仅作为一个照片来源被提到。然而这很快便遭到了质疑,因为在几台非苹果设备上也发现了这些内容。

碰巧这些不雅照泄露的时间发生在周日,这也暗示着照片来源可能是苹果,因为HackApp在周六刚刚发布了一个iCloud漏洞的概念证明。苹果昨日修补了其FMF强力破解漏洞,并将在5次“找到我的iPhone”密码试验失败后关闭用户苹果ID。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。