TalkingData:10亿移动互联网设备都说了什么?

“滴滴和快的到底谁的客户多?美柚和大姨吗到底谁活跃?去哪儿真的比携程大吗?”人们每天手持各种设备,却不了解整个行业。

这时候就出现了一个蓝本:10亿说。10亿,来自第三方数据服务提供商TalkingData所覆盖的移动设备,包括iOS、Android,包括智能手机、平板、智能电视等。根据设备每天产生的数据,得出用户行为报告。

这份报告就是TalkingData《2014移动互联网数据报告》。与其他数据报告不同之处在于,TalkingData CEO崔晓波大胆披露,其他的第三方数据公司也在发布报告,也在发布数据,但他们的目的好像更多的是为了盈利。

TalkingData CEO崔晓波

TakingData 数据服务部高级总监陶京琪指出,通过对分布式运算架构、海量数据处理、数据挖掘算法的长期钻研,大数据已经成为TalkingData骨子里的基因。

带着大数据基因,除定期发布数据报告外,更重要的是,TalkingData会发布一个移动数据观象台,并免费开放给整个行业,揭开这层迷雾,让大家知道所有数据的真相。该观象台已于2014年9月对外免费公布。

崔晓波进一步介绍:“这个产品,包括以前我们服务美国的基金客户,他们利用这些产品,观察中国的股市,再研究这些公司的动态。但今天我们想把它免费开放出来,最重要的是,我们希望建立一个比较健康的产业环境,让大家揭开这层迷雾,去看一看退潮之后底下到底是什么。”

实际上,从创建初,TalkingData就定位于“第三方的中立数据平台”,借助中立优势,TalkingData与国内众多机构紧密合作,汇聚大量移动互联网用户数据。目前TalkingData为超过50000款应用、游戏提供数据统计、分析服务,覆盖超过10亿独立移动设备;为招商银行、中信银行、平安保险等企业提供数据服务。

那么,10亿移动互联网数据都说了什么?

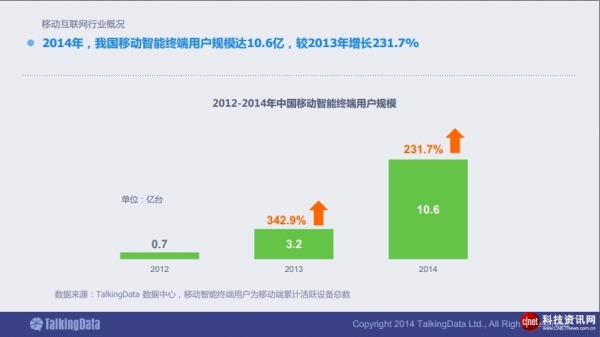

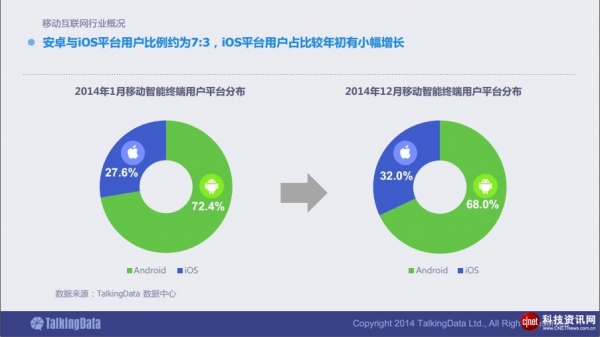

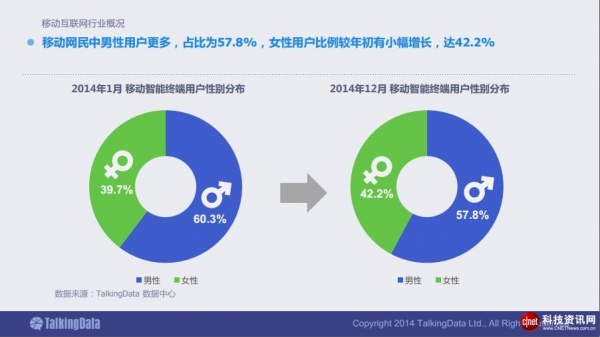

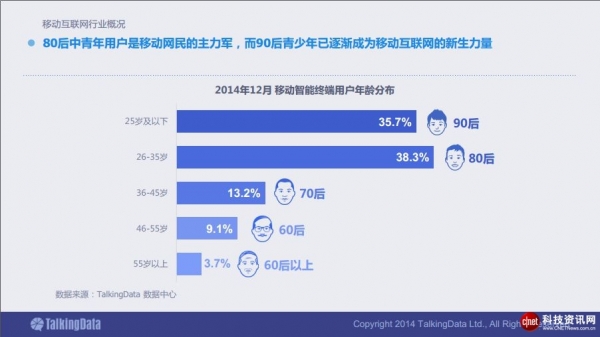

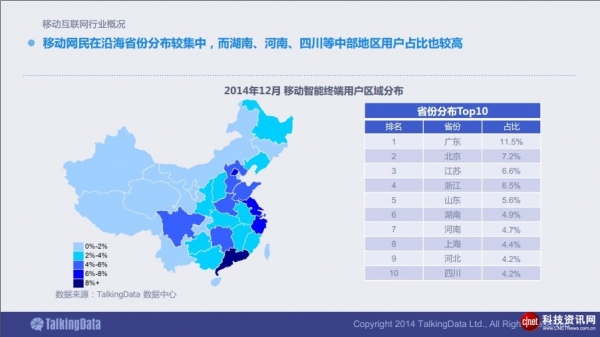

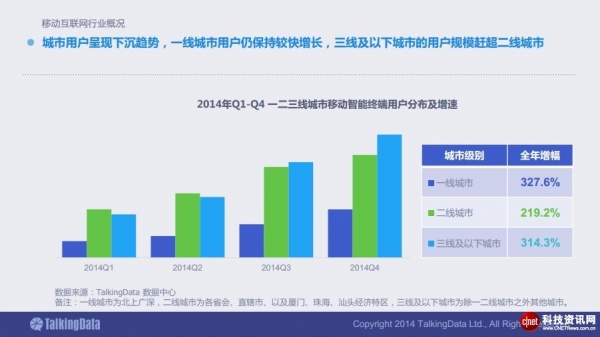

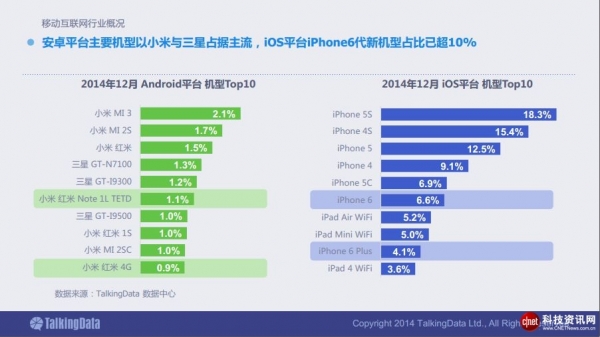

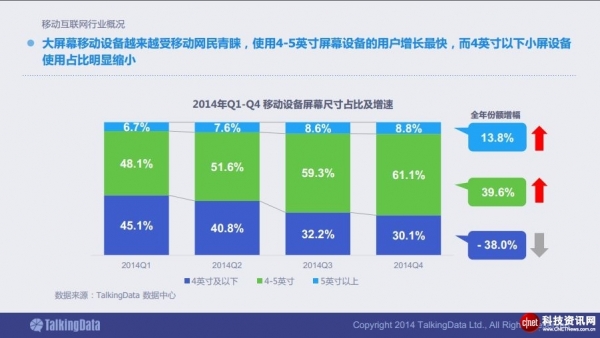

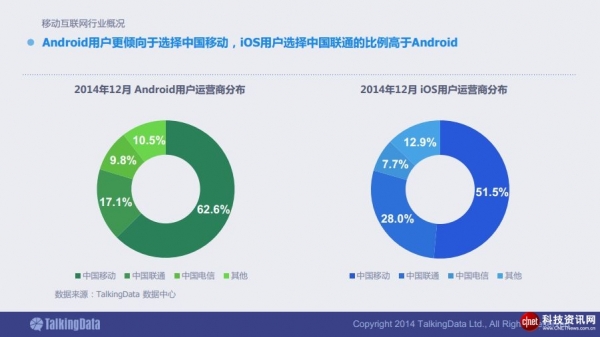

以上数据均来自TalkingData《2014移动互联网数据报告》,CNET从中摘取了一小部分,当然,也希望更多数据被TalkingData刷新。

好文章,需要你的鼓励

-

加州大学洛杉矶分校、腾讯混元等推出Unify-Agent:一个能搜索全世界图片知识的AI画师

加州大学洛杉矶分校等机构联合推出的Unify-Agent突破了传统AI图像生成的知识局限,通过整合"思考-搜索-整理-绘制"四步工作流程,让AI画师具备主动查找资料的能力。该系统在FactIP基准测试中相关性指标提升61%,特别擅长处理需要准确世界知识的长尾内容和文化特色图像生成任务。

-

中科院团队首创FlowPIE:让AI像进化生物一样自动"孵化"科学创意,告别千篇一律的研究思路

中科院团队开发的FlowPIE系统首次将动态文献探索与创意进化相结合,突破传统AI科学创意生成的同质化局限。该系统通过流引导蒙特卡洛树搜索实现文献检索与创意生成的紧密耦合,并采用类生物进化机制持续优化创意质量。实验显示,FlowPIE在新颖性、可行性等维度显著超越现有方法,展现出强大的跨领域泛化能力,为AI辅助科研开辟了新路径。

-

阿里巴巴DAMO院推出虚拟细胞世界:Lingshu-Cell让单细胞生物学迎来AI革命

阿里巴巴DAMO研究院推出Lingshu-Cell虚拟细胞建模系统,采用掩码离散扩散模型技术,能够精确模拟和预测细胞在基因编辑、药物刺激等干预下的反应。该系统在国际虚拟细胞挑战赛中表现出色,为个性化医疗和药物开发开辟了全新路径,标志着数字生物学时代的到来。

-

上海AI实验室推出GEMS:让小模型也能像大师一样生成完美图像

上海AI实验室联合多所高校发布GEMS技术,通过智能团队协作机制让60亿参数的小模型在图像生成上超越顶级商业模型。该系统包含循环优化、记忆管理和技能库三大核心,采用多轮迭代和专业技能匹配,在主流测试中提升14分以上,为资源受限环境下的高质量AI应用提供新方案。