谷歌抓取300亿条应用内信息 搜内容会推荐应用

北京时间4月16日上午消息,谷歌刚刚面向Android平台推出了一项新的移动搜索功能,可以在用户搜索内容时向其展示移动应用安装广告。

这相当于把谷歌移动搜索页面变成一个应用发现服务,对于移动开发者而言或许会成为一大福音。

随着计算行业从桌面端向移动端全面转移,优质内容往往都通过应用来展示,在这种情况下,搜索引擎的用途便有所降低。为了解决这一问题,谷歌在2013年推出了应用索引,使之可以抓取部分应用的内容,并将链接显示在搜索页面中。

不过,在初期版本中,用户必须首先安装相关应用才能通过链接查看内容,今年早些时候则开始通过Google Now Cards显示相关内容。谷歌今后将面向所有开发者开放这个项目。

而移动搜索的最新升级则进一步加强了应用索引的概念,帮助用户通过尚未安装的应用找到相关内容。

应用索引项目现在已经获得了300多亿个深度链接——这是谷歌第一次公布这一数据,但该公司尚未披露具体有多少开发者部署了这个项目。

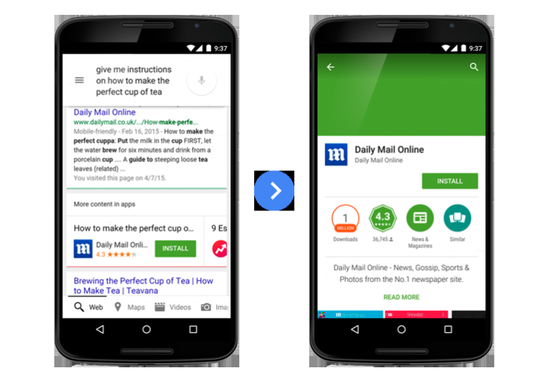

该项目的大致模式是:如果你通过Android手机搜索菜谱,而谷歌算法认为某款应用恰恰可以提供这一信息,你便会在搜索结果中看到相关应用, 旁边还会附带一个醒目的“安装”按钮。只要点击该按钮,便会跳转到Google Play商店,以便安装应用。应用安装完毕后,只要点击“继续”按钮,应用就会打开,并为你展示刚刚查找的信息。

此举对移动应用开发者而言至关重要。毕竟,应用发现仍是一个没有完全解决的问题,只要能将安装按钮和相关应用展示给更多人,都将给应用开发者带来福音。

“这个项目的目的是方便开发者继续在应用内创造优质内容,并通过深度链接让用户可以直接访问这些内容。”负责该项目的谷歌工程师拉吉安·帕特尔(Rajan Patel)说。

帕特尔还表示,该团队正在寻找各种方法来做大规模,使之不仅仅局限于Android平台。但他目前不肯披露详细信息。

好文章,需要你的鼓励

-

Adobe与UCLA联手突破AI模型速度瓶颈:让图像生成快一倍的"稀疏化魔法"

Adobe研究院与UCLA合作开发的Sparse-LaViDa技术通过创新的"稀疏表示"方法,成功将AI图像生成速度提升一倍。该技术巧妙地让AI只处理必要的图像区域,使用特殊"寄存器令牌"管理其余部分,在文本到图像生成、图像编辑和数学推理等任务中实现显著加速,同时完全保持了输出质量。

-

不用再训练AI模型,香港科技大学团队发明"智能管家",让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

-

韩国KAIST让SVG动画脱胎换骨:AI如何破解矢量图形的"语义迷宫"让静态图标活起来

韩国KAIST开发的Vector Prism系统通过多视角观察和统计推理,解决了AI无法理解SVG图形语义结构的难题。该系统能将用户的自然语言描述自动转换为精美的矢量动画,生成的动画文件比传统视频小54倍,在多项评估中超越顶级竞争对手,为数字创意产业带来重大突破。

-

华为诺亚方舟实验室新突破:不加内存也能让AI变聪明的神奇方法

华为诺亚方舟实验室提出VersatileFFN创新架构,通过模仿人类双重思维模式,设计了宽度和深度两条并行通道,在不增加参数的情况下显著提升大语言模型性能。该方法将单一神经网络分割为虚拟专家并支持循环计算,实现了参数重用和自适应计算分配,为解决AI模型内存成本高、部署难的问题提供了全新思路。