苹果展开中国新环境项目 已与多家公司合作

苹果宣布在中国开展新的可再生能源以及环境保护项目,其中包括一项与世界自然基金会长期合作多年的计划,此项目将改善中国负责管理森林将近百万英亩的森林,这些森林是纤维纸浆、纸张和木材的重要来源。

此外,苹果公司在中国还有很多环境相关的项目,包括三个星期前,在中国四川建立了第一个太阳能发电项目,这个项目产生的能源远远高于苹果中国地区所有消耗。

与乐山电力股份有限公司、四川发展(控股)有限责任公司、天津津联投资控股有限公司、天津中环半导体股份有限公司和美国SunPower公司合作,建设了两个20兆瓦的太阳能农场。该项目每年将生产8000万千瓦时的清洁能源,足以提供大致相当于6.1万个中国家庭的用电量。

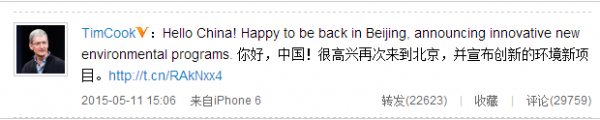

苹果公司CEO库克表示“我们通过让数据中心,零售店和办公设施使用清洁能源树立榜样,并且已经准备好去引领大家在生产制造中实现碳排放的减少。这不可能一蹴而就,实际上需要多年的努力,但这是一件必须要做的重要工作,而苹果愿意主动带头来实现这一远大的目标。这是我们的责任。我们很高兴能够和那些愿意走在中国绿化转型的前沿的供应链中的领导者一起努力。”

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。