运营商变得“老土” 爱立信在努力让他们“洋气”起来

苹果、三星等手机上有了Wi-Fi通话的时候,中国运营商的服务还没见踪影;当商场、博物馆、机场越建越雄伟的时候,运营商愈发犯愁室内覆盖……这些,其实爱立信都能帮运营商出主意:比如用手机拨号就能直接实现Wi-Fi语音通话,比如有像女生用的粉饼大小的支持TD-LTE的爱立信点系统。

Wi-Fi语音电话就是这样简单

iPhone iOS8发布的时候,中国用户第一次见识到了Wi-Fi语音通话,随后,微信电话本推出,腾讯快速切入了Wi-Fi语音通话市场。这在业内人士看来,是苹果抛给运营商的一大难题。现在来看,爱立信可以帮运营商迅速补齐这一产品。

其实,基于Wi-Fi的语音通话的需求最早来自于北美运营商,T-Mobile是第一个商用此方案的运营商。T-Mobile为了吸引用户,还为申请这一服务的用户赠送了个人小基站,这样,即便用户身处异国他乡,也一样可以用Wi-Fi语音通话来享受优惠的资费。

在地广人稀的北美,室内的语音覆盖是运营商经常遇到的一个棘手问题,Wi-Fi语音通话能有效地利用家庭、企业、公共Wi-Fi热点补充传统宏网络的语音覆盖。除此之外,Wi-Fi上的语音通话还能提供更高质量的语音电话服务与数据服务,充分挖掘移动增值业务收入的潜力。

借助此服务,T-Mobile在美国市场的份额从第四跃升到第三。

现在,爱立信的Wi-Fi语音通话解决方案已经就绪,能够提供端到端的商用Wi-Fi语音方案,支持VoLTE与Wi-Fi语音之间无缝衔接,并且得到了主流芯片厂商高通和英特尔的支持。

值得一提的是,在用户体验上,爱立信的解决方案可以在手机自带的拨号中实现呼叫,不管是呼出的体验,还是语音通话的体验,都不会让用户感受到与普通的语音通话有什么不同。

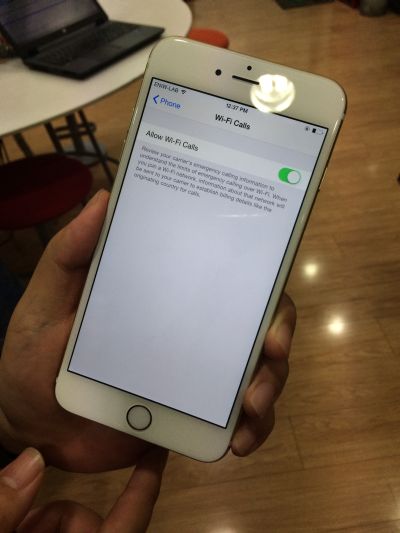

图:在手机拨号里面就可以直接呼出Wi-Fi电话,不需要另行安装APP

图:用户可以根据自己的需要进行拨号设置,选择是否Wi-Fi电话优先

据介绍,2014年10月,爱立信在北京向中国电信演示了这一技术,并完成了国内的第一个Wi-Fi电话。

室内覆盖可以“颜值很高”

拨出一个Wi-Fi电话,很酷,当然还有更酷的,那就是一个像女生用的粉饼大小的爱立信点系统,只要插上一根普通网线,就能实现室内覆盖。

这个小东西只有300g重,只要固定到屋顶上都可以,而且屋顶也完全可以承受这个重量,建筑本身装修一般也都会预留网线,利用一根网线,就可以快速部署,降低了60%的馈缆成本。

图:爱立信点系统非常小巧

爱立信的工程师们自称这是一款“颜值很高”的产品,小巧、做工精细。

图:在爱立信东北亚区无线创新实验演示中心(WILD Center)的屋顶上就部署了点系统,如果没有工程师的标识,很难发现

目前,Claro、MTS、新加坡电信、西班牙电信、Verizon和沃达丰等都已开展了测试并进行了部署。在世界各地的实际部署结果表明,移动数据吞吐量增加了5倍,通话中断率降至零,大大提升了LTE的室内覆盖效果。

在2015年3月的巴塞罗那全球移动通信大会上,爱立信携手中国移动首次展示了支持TD-LTE的点系统。

创新积攒底气

能够“洋气”的根源还是来自爱立信在创新上的投入。

位于南京的爱立信熊猫通信有限公司,现在是爱立信全球的三大供应中心之一,南京熊猫通信有限公司的总裁唐伟德介绍,南京爱立信熊猫通信有限公司生产的产品主要是在中国的北京,还包括其他的研发机构来进行开发的,开发之后的产品主要是在爱立信南京进行工业化和进行量产的,面向全球的客户进行交付和发货。

在过去六年当中,南京研发中心提交了116项的专利,其中36项获得了批准,同时还提出了163项的改进实施。

尽管受到毛利率下降的困扰,但是,唐伟德指出,精益和敏捷的方式来去开发生产是需要继续秉承的,也是由此进一步提升爱立信的核心竞争力的路径,从而提升利润水平。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。