NASA举办智能手表应用设计大赛 为宇航员设计应用

自人类进入太空以来,他们的手腕上就一直带有手表,其中最著名的是美国宇航局宇航员佩戴的欧米茄超霸系列手表。随着智能手表时代的来临,宇航员也可能“鸟枪换炮”。

进入太空的智能手表的功能,将不仅仅是需要手动上发条的超霸系列手表能提供的计时和计数功能。美国宇航局已经在Freelancer上发起竞赛活动,要求参赛者设计一款能被宇航员在太空中使用的智能手表应用,获胜应用的开发者将获得1500美元奖金。

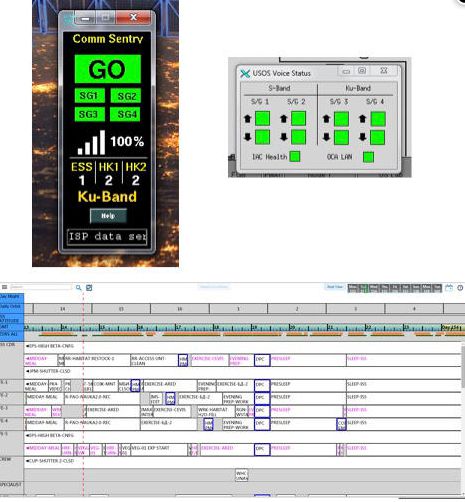

宇航员使用的当前接口的示范屏幕,顺时针方向从左上角依次是:警告、地面通信状态和宇航员的时间表

美国宇航局在文件中称,“我们对新兴的智能手表技术很有兴趣,希望利用这一技术,开发一款对宇航员有用的智能手表应用。这次竞赛,旨在设计供在国际空间站上使用的智能手表应用通用用户界面。”

这款应用将用来显示对宇航员来说重要的信息。例如,宇航员时间明细表的日常工作事项视图,目前宇航员通过iPad或笔记本查看时间明细表;不同颜色的警告信息;表明国际空间站能否与地面通讯的通讯状态;定时装置。

应用应当能使宇航员关注他们需要的信息,提供对宇航员动作的回馈,适合在智能手表的显示屏内实现。所有这些功能需要在一款能在三星Gear 2上运行的应用内实现。

参赛者不需要真正开发出应用。他们的任务是设计应用的用户界面,以图像文件的形式提交参赛作品即可。美国宇航局这次竞赛的目的可能是:解决宇航员在穿戴笨重的宇航服的情况下如何操纵智能手表的触摸屏。

好文章,需要你的鼓励

-

加州大学洛杉矶分校、腾讯混元等推出Unify-Agent:一个能搜索全世界图片知识的AI画师

加州大学洛杉矶分校等机构联合推出的Unify-Agent突破了传统AI图像生成的知识局限,通过整合"思考-搜索-整理-绘制"四步工作流程,让AI画师具备主动查找资料的能力。该系统在FactIP基准测试中相关性指标提升61%,特别擅长处理需要准确世界知识的长尾内容和文化特色图像生成任务。

-

中科院团队首创FlowPIE:让AI像进化生物一样自动"孵化"科学创意,告别千篇一律的研究思路

中科院团队开发的FlowPIE系统首次将动态文献探索与创意进化相结合,突破传统AI科学创意生成的同质化局限。该系统通过流引导蒙特卡洛树搜索实现文献检索与创意生成的紧密耦合,并采用类生物进化机制持续优化创意质量。实验显示,FlowPIE在新颖性、可行性等维度显著超越现有方法,展现出强大的跨领域泛化能力,为AI辅助科研开辟了新路径。

-

阿里巴巴DAMO院推出虚拟细胞世界:Lingshu-Cell让单细胞生物学迎来AI革命

阿里巴巴DAMO研究院推出Lingshu-Cell虚拟细胞建模系统,采用掩码离散扩散模型技术,能够精确模拟和预测细胞在基因编辑、药物刺激等干预下的反应。该系统在国际虚拟细胞挑战赛中表现出色,为个性化医疗和药物开发开辟了全新路径,标志着数字生物学时代的到来。

-

上海AI实验室推出GEMS:让小模型也能像大师一样生成完美图像

上海AI实验室联合多所高校发布GEMS技术,通过智能团队协作机制让60亿参数的小模型在图像生成上超越顶级商业模型。该系统包含循环优化、记忆管理和技能库三大核心,采用多轮迭代和专业技能匹配,在主流测试中提升14分以上,为资源受限环境下的高质量AI应用提供新方案。