谷歌无人驾驶汽车与公交相撞 首次承担部分责任

北京时间3月1日消息,据科技网站AppleInsider报道,谷歌无人驾驶汽车过去曾卷入多起交通事故,不过在这些交通事故中,其他车辆司机都负全责。但是,在本月早些时候发生在加利福尼亚州的一起交通事故中,谷歌无人驾驶汽车需要承担部分责任。

有媒体当地时间周一报道,向加利福尼亚州机动车辆管理局(以下简称“DMV”)提交的文件披露了这次交通事故。文件显示,一辆采用无人驾驶技术的雷克萨斯RX450h在山景城与一辆公交车相撞。

报告显示,当时,无人驾驶的雷克萨斯试图并入车道,并避开前方道路上的沙袋。它显然通过后视镜“看到”了公交车,并“断定”它会停车或减速,但公交车并未停车或减速。

好在当时两辆车速度都很慢,雷克萨斯时速仅为2英里,公交车时速为15英里。事故没有造成人员伤亡,报告只是称雷克萨斯受到损伤。

在有关这次交通事故的消息“触网”后,谷歌解释了原因,称“有人驾驶汽车每天都会发生类似事故。这是驾驶活动中协商的经典案例——我们尝试相互预测对方行为。在这次交通事故中,我们显然负有责任,因为如果我们的汽车不出现在那里,就不会造成两车相撞。随车测试人员认为公交车会停车或减速,使我们的汽车并入车道,并认为两车之间距离足够大”。

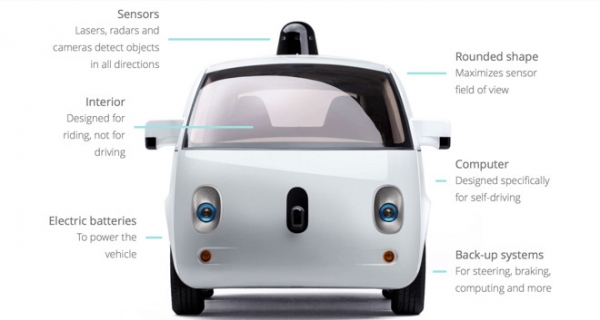

谷歌无人驾驶汽车示意图

谷歌无人驾驶汽车曾遭遇17起交通事故,但据称这些交通事故责任全在对方,使得发生在2月14日的这起事故,成为谷歌无人驾驶汽车负部分责任的首起交通事故。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。