让机器会说更生动的句子,阿里巴巴论文入选计算机视觉顶级会议

CNET科技资讯网 7月28日 北京消息:今天,阿里巴巴的“NASA大脑”iDST(Institute of Data Science Technology)表示,《Hierarchical Multimodal LSTM for Dense Visual-Semantic Embedding》入选2017年国际计算机视觉大会ICCV,即计算机视觉领域的顶级会议之一。

这也是阿里巴巴本月内第三次公布论文入选国际顶级学术会议的好消息。

据了解,这篇论文涉及的是计算机视觉(Vision)和自然语言处理(Language)两个独立领域结合的学术研究,提出了对图像(或图像显著区域)更为细致精确的描述,显示出阿里巴巴在Vision&Language研究方向的持续挖掘。

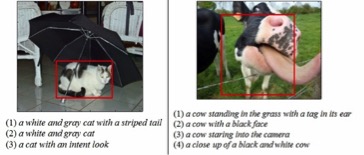

该论文通过创新的多模态、层次化的递归神经网络(Hierarchical Multimodal LSTM)方法,可以将整个句子、句子中的短语、整幅图像及图像中的显著区域同时嵌入语义空间,并且自动学习出“句子-图像”及“短语-图像区域”间的对应关系,生成包含更多形容词的稠密语义空间,对图像或图像区域进行更详细和生动的描述。

也就是说,计算机以后不仅能说“一只鸟站在树枝上”,还能说出“一只羽翼未丰的小鸟站在春天抽芽的树枝上”、“一只张嘴乞食的小鸟”、“一只小鸟站在抽芽的树枝上,扑腾翅膀学习飞翔”这样更为生动复杂的句子。

论文作者介绍,这一研究将被用于“看图说话(Image Captioning)”任务及其他颇有意义的应用场景。如应用于自动导盲系统,将拍摄的图像转换成文字和语音,以便提示盲人避障。

此外,还能用于“跨模态检索(Cross-media Retrieval)”任务,当用户在电商搜索引擎中输入一段描述性文字如“夏季宽松波西米亚大摆沙滩裙”,系统就能为用户提供最相关的商品。

ICCV全称为IEEE International Conference on Computer Vision,与CVPR(计算机视觉模式识别会议)和ECCV(欧洲计算机视觉会议)并称计算机视觉方向的三大顶级会议。

在本月早些时候,阿里巴巴先后发布三篇论文入选国际多媒体会议ACM MM,四篇论文入选国际计算机视觉与模式识别会议CVPR的消息。

今年3月,阿里巴巴宣布启动NASA计划,要为未来20年研发核心科技。在这一计划的号召下,阿里正在人工智能领域全面发力,在机器学习、视觉识别等领域不断追赶世界顶尖的学术水平。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。