麻省理工研究出新摄像头技术,搞定了一个自动驾驶的致命性问题(附视频)

用肉眼观察角落另一边的盲区或许不太现实,然而经过科学家们多年研究,已经可以利用专门的激光器实现了。而现在,麻省理工计算科学与人工智能实验室(MIT CSAIL)的研究者们又向前迈进了一步:他们开发了一套成像系统CornerCameras,可以从地面反射的微光中探测到物体。

[video]uu=dfa091e731&vu=1b7b9c1c3a&auto_play=0&width=600&height=450[/video]

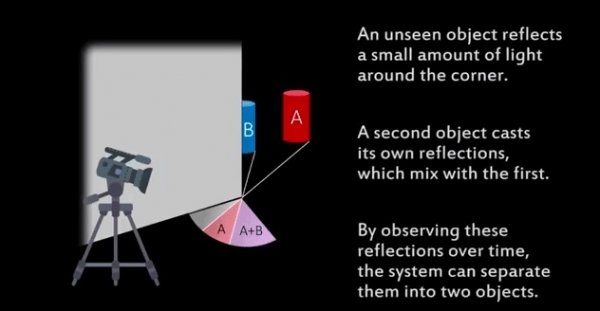

这项研究的原理很简单:所有物体都会反射光线,CornerCameras系统能够使用智能手机摄像头采集的视频,实时测量隐藏物体的速度和轨迹。当然,人眼是无法看清这种变化的,但摄像头可以,通过观察角落附近的地面,再根据地面阴影的变化,判断另一边是否有东西在移动。

MIT CSAIL一位发言人说,这项技术有一系列应用场景,包括消防队员在焚烧的建筑物内寻找人,以及自动驾驶汽车探测盲区内的行人等等,在这种应用场景中,它并不需要任何细节,只要知道那边有东西就行了。他还说,这个系统方便的地方在于,可以使用智能手机摄像头采集的视频。

博士毕业生Katherine Bouman是该系统论文的主要作者,她表示,“即使这些‘半影’(模糊的阴影)实际上对于摄像头来说并不可见,我们还是可以通过系统看到它们,以确定它们在哪里,以及它们要去哪里。”

而且,为了观察这种方法对自动驾驶汽车是否可行,她们在阴影角度拍摄了一段远处角落的视频,结果依然能够获得明确的信号。也就是说,即便汽车距离角落很远,也依然能够使用这套系统。

不过,这种方法也存在一些弊端:尽管它可以检测盲区内障碍物的移动速度、位置,但无法辨认该物体的任何细节信息,包括边缘、形状或纹理。相较于激光器的激光反弹原理,这种技术只能检测出在明亮环境下移动的人或物体。而且,用于分析的视频源也必须保持稳定,否则也会出现纰漏。

尽管存在漏洞,但就目前而言,这套系统已经是一项突破了。它在室外明亮光下表现得很出色,甚至在雨中也能工作。

关于雨中作业,Bouman比较惊讶,“由于雨水改变了地面的颜色,所以我认为,系统无法看到光线中千分之一的微小差异。” 不过,“由于系统整合了几十张图像的信息,足以抵消雨滴的影响,所以你可以看到物体的移动。”

CornerCameras系统目前需要一台笔记本来进行必要的图像处理,但Bouman说,这个问题可以在未来得到解决:“从计算角度看,该系统完全可以在手机上运行,只不过我们还没有这么做而已。”

Bouman同麻省理工学院教授Bill Freeman、Antonio Torralba和Greg Wornell共同撰写了这篇论文,Bouman将在本月晚些时候在威尼斯举办的International Conference on Computer Vision(国际计算机视觉大会)上介绍最新工作。

<来源:the Verge;编译:科技行者>

好文章,需要你的鼓励

-

谷歌DeepMind等顶级机构联合揭秘:为什么所有AI安全防护都是纸老虎?

谷歌DeepMind等顶级机构联合研究揭示,当前12种主流AI安全防护系统在面对专业自适应攻击时几乎全部失效,成功率超过90%。研究团队通过强化学习、搜索算法和人类红队攻击等多种方法,系统性地突破了包括提示工程、对抗训练、输入过滤和秘密检测在内的各类防护技术,暴露了AI安全评估的根本缺陷。

- 2025-11-19 16:15

西蒙弗雷泽大学和Adobe研究院联手打造视频制作新神器:让静态图片学会"按剧本演戏"

西蒙弗雷泽大学和Adobe研究院联合开发的MultiCOIN技术,能够将两张静态图片转换为高质量的过渡视频。该技术支持轨迹、深度、文本和区域四种控制方式,可单独或组合使用。采用双分支架构和分阶段训练策略,在运动控制精度上比现有技术提升53%以上,为视频制作提供了前所未有的灵活性和精确度。

-

英国国王学院突破传统:让AI像人类思考一样"反复斟酌",生成速度飞跃10倍

英国国王学院研究团队开发了潜在精炼解码(LRD)技术,解决了AI文本生成中的速度与准确性平衡难题。该方法通过两阶段设计模仿人类思考过程:先让AI在连续空间中"深思熟虑",保持多种可能性的混合状态,然后"果断行动",逐步确定答案。实验显示,LRD在编程和数学推理任务中准确性提升最高6.3个百分点,生成速度提升最高10.6倍,为AI并行文本生成开辟了新路径。

-

清华大学团队发布ViSurf:让AI视觉模型学习更聪明的新方法

清华大学团队开发的ViSurf是一种创新的大型视觉语言模型训练方法,巧妙融合了督导式学习和强化学习的优势。该方法通过将标准答案整合到强化学习过程中,让AI既能从正确答案中学习又能保持自主推理能力。实验显示ViSurf在多个视觉任务上显著超越传统方法,特别是在处理模型知识盲区时表现突出,同时有效避免了灾难性遗忘问题,为AI训练提供了更高效稳定的新范式。