一块芯片掀起CES“自动驾驶风云”,硬件玩家英伟达却说软件定义才是未来

CNET科技行者 1月12日 拉斯维加斯消息(文/黄当当): 当全球媒体还沉浸在CES Unveiled,这一具有标志性开幕的狂欢,几乎同时,相隔一个街道之外的MGM会议中心,却隔空投来一枚“核弹”。于是,出现了下面这一幕。

面对不断流失的人群,直接让CES Unveiled举办地Mandalay Bay工作人员“炸了锅”,纷纷议论起Nvidia。起因是,英伟达与CES“第一站”预展都将发布时间定在了Las Vegas当地时间1月7日晚。

此刻,英伟达Keynote所在地,六条纵向延伸的签到长队,座无缺席被挤爆的会场,任一一者都足以说明,为什么每个人都对英伟达如此期待与兴奋。

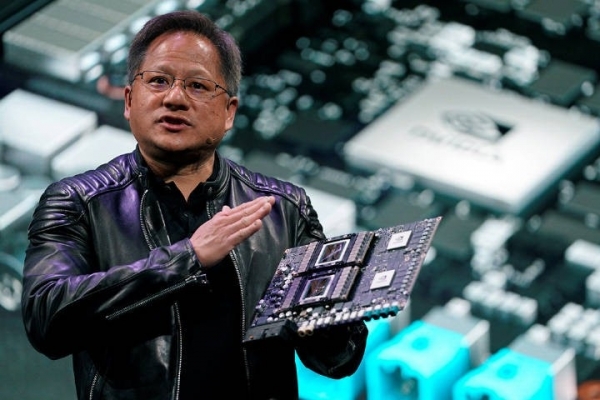

“Hey you guys!”一个机车范boy——NVIDIA创始人兼首席执行官黄仁勋登场,标志性的皮夹克装扮,却不曾料到这位霸道总裁“高冷”外形之下,擅长推销“反差萌”的一面。

在这场时长近90分钟的主题演讲中,黄老板至少有6次拿起自家产品,并情不自禁手舞足蹈,甚至在现场开启推销模式,高喊“Save Money”,在意识到自己玩嗨时,又会默念一句“it's a Joker”恢复平静。

正是这样一个激情满满,控场力Max的皮衣老板,让他领导下的英伟达,仍然像一个初创公司一样不断创新、果断决策、快速执行,

备受推崇。如果你还在为错过这场Keynote而感到遗憾,相信这个坐落于CES核心展区Las Vegas Convention Center北馆7019的英伟达展位,依旧分分钟能掀起赌城“自动驾驶风云”。

相比于Keynote上偌大有格调的会议厅,英伟达在CES展台布置也十分讲究“形式感”:一辆Nvidia 标准绿色装配的Roborace参赛车威严屹立在展台,颇有几分黄老板Style,而该区域左侧则是可定义更换汽车外观,还有内饰、零件的VR体验区。从现场来看,仅这两个区域,已经可以用“people mountain people sea”来形容了。

当然,重头戏依旧是“自动驾驶”。在今年CES主题演讲上,英伟达重新梳理产品思路,并勾勒出一个全新 DRIVE系列产品发展架构,一共分为4层:底层是最新发布的Drive Xavier自主机器处理器,往上依次是:Drive AV自动驾驶车辆平台、Drive AR增强现实软件开发套件、Drive IX智能体验软件开发套件。

特别注意的是,在今年CES展台,英伟达就将这款最新Drive Xavier带到人们眼前。然而,这款放置在玻璃橱窗,被围观人群堵得“水泄不通”纷纷都想一饱眼福的,号称 “每秒运行30万亿次计算,功耗仅为30瓦”的最强自动驾驶处理器,究竟为何如此备受关注?

我们不妨将时间线,再拉回至黄老板在几日前的Keynote上,狠狠秀出的几张关于“自动驾驶”漂亮的成绩单。

Drive Xavier——“这是世界上最强大的SOC芯片”

其实英伟达早在2016年9月就宣布了Drive Xavier,但当时只是设计,连样片也没发布。直到今年CES,黄老板才终于将全新Xavier对外发布,当然,性能比当初要更强劲。

它是英伟达20亿美金自动驾驶AI研发投入的成果,动用了2000个工程师,研发耗时4年。按照英伟达的口径:“这是世界上最强大的SOC芯片”,Xavier可处理来自车辆雷达、摄像头、激光雷达和超声波系统的5级自主驾驶数据,能效比市场上同类产品更高,体积更小。

Xavier的内置晶体管超过90亿个,含一颗定制的8核CPU、一颗512核Volta GPU、一个8K HDR视频处理器、一个深度学习加速器、数个新型计算机视觉加速器以及30瓦功率下每秒可执行30万亿次操作的能力。

“这大约是将一台服务器压缩进一个芯片。”CES发布会现场,每当黄老板介绍到Drive Xavier时,他总是一脸坏笑,像还隐藏着更大的计划,但又附着一副就不告诉你的神秘表情。

直到发布会临近尾声,黄老板的一页PPT,左侧清晰展示出全新Drive系列产品发展架构,而右侧的标题“未来汽车将由软件定义”,此刻,他收起了脸部丰富的表情,认真解释到,为何硬件擅长的英伟达却说软件定义才是未来。

不断扩大的生意图谱,“软硬通吃”策略完美奏效

作为半导体芯片商的英伟达,聪明之处在于,并没有只把Xavie是看作处理器,更重要的是,它支持了两大软件平台,Drive IX和Drive AR(两者又属于英伟达Pegasus AI计算平台)。

其中Drive IX是人工智能层,主要负责处理和驾驶体验和操作控制相关的数据,可以通过分析汽车内外部数据,基于乘客和司机的面部、声音和手势,提供AI助理功能。英伟达正把Drive IX作为汽车安全性和便利性的终极SDK来对待,一个典型的场景是比如叫醒一个陷入沉睡的司机。

而Drive AR,是一个汽车内的增强现实平台,英伟达同时在CES上介绍了AutoSim,这是一个实时的,虚拟驾驶环境。因为Drive IX和Driver,和它们之上的Pegasus,黄仁勋强调,英伟达正在提供一个全栈的自动驾驶软件平台。而不仅仅是Xavier这个硬件平台。正如英伟达的GPU很强大,但是CUDA计算平台也同等重要。

“这就如同手机一样,现在的智能手机由于有了操作系统,可以运营各种软件,享受上网、娱乐、购物等各种服务;未来用软件定义的汽车,可以智能驾驶、可以连接服务、可以减少交通事故、更加节能环保。”英伟达自动驾驶技术讲解人员Tim Wong认为,软件定义汽车将是大势所趋,而软硬一体化,正是英伟达在AI领域的强大竞争力所在。

黄仁勋也表示,英伟达开发了整套自主车辆软件,现在已拥有超过320个客户在开发英伟达Drive。“软硬通吃”正在英伟达与合作伙伴之间,发生奇妙的化学反应。

除了Keynote上刚宣布的几项最新合作: 百度和采埃孚的合作项目,选择使用最新的Drive Xavier平台;英伟达和AURORA联合打造自动驾驶车辆计算平台;Uber和特斯拉联手打造全自动驾驶的Uber;大众集团选择英伟达作为未来AI能力发展的合作伙伴。

本次CES展会期间,还带来一个好消息:黄仁勋在梅赛德斯-奔驰的活动中与该公司高管同台,宣布两家公司正在合作开发一款采用AI技术的汽车,且该车有望于2018年问世。

看来,黄老板的生意图谱中要再添一员大将了。

就像黄仁勋所说,英伟达一开始做人工智能时其实完全没有想到生意的问题,正是这份坚持与韧性,让这家做显卡起家的公司,所受到的热爱,一如它一路上涨的股价,是华尔街、硅谷的宠儿,更是全球的焦点。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。