IBM公司打造AI“化身”,回答关于海洋垃圾的种种问题

纵然能够收集到与之相关的所有数据,访问难度仍然难以克服——除非,你有Sam这位海洋问题专家的帮助。

IBM公司在第30份年度环境报告中,就强调了这样一个试点项目的设计思路。简而言之,“蓝色巨人”正在与联合国环境规划署(UNEP)合作,展示如何利用信息技术与人工智能解决海洋垃圾挑战。这项工作也是IBM公司的一项重要投资,将以免费形式向环境署方面提供。

海洋环境确实面临着严峻挑战:联合国环境规划署估计,每年约有800万吨塑料制品流入海洋,相当于每分钟倾泄一辆满载塑料的垃圾车。即使是新冠疫情也没有阻止环境破坏,反而令全球范围内的制品回收项目纷纷停滞,而一次性产品的数量也开始急剧增加。

IBM与环境署在过去几年中一直协同努力。今年年初,开发人员完成了关于海洋垃圾多边利益相关方数字平台的概念验证。他们希望解决两项挑战:一是,打破集中式全球海洋垃圾数据库的缺乏局面;第二,打通立足地球各个角落访问集中信息的便捷通道。

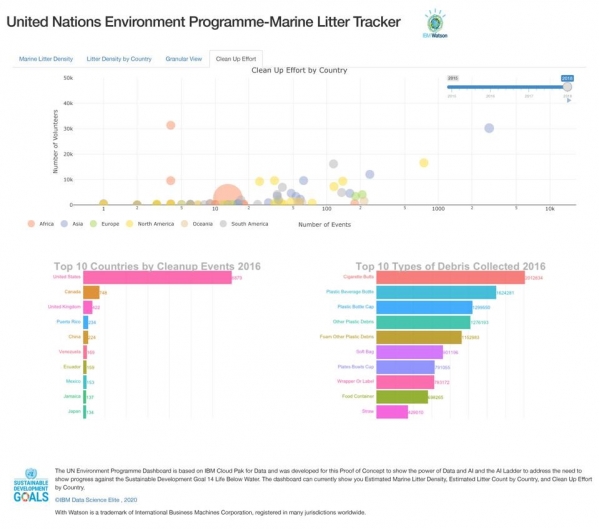

▲ 图:联合国环境规划署发布的海洋垃圾仪表板

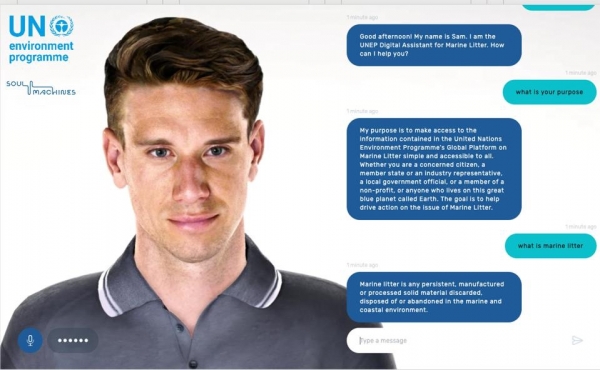

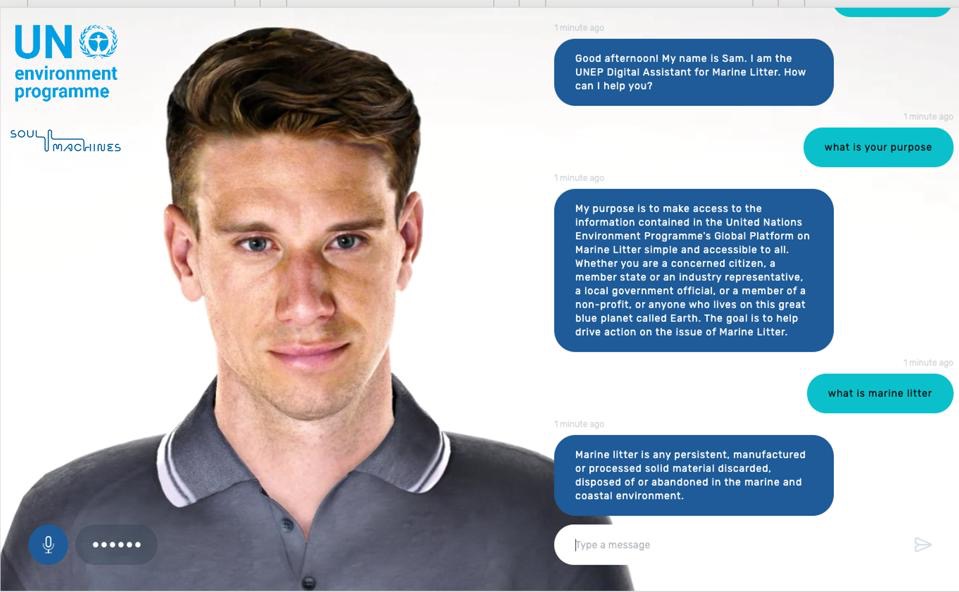

为了让这套方案发挥最大作用,IBM的工程师们提出了“Sam助手”的设想。

IBM公司全球政府数据与人工智能首席技术官Nicholas Holmes表示,“Sam是一种具有自主动画效果、具有情感响应能力的类人型化身,由IBM公司合作伙伴Soul Machines HumanOS与Digital DNA技术提供支持。”

“Sam的出现,是为了在海洋垃圾与使用者之间建立起情感纽带,我们坚信这种情感的联系将有助于增强行动力。”

这套界面使用IBM技术解释用户意图,并从环境署庞大的存储库及其他来源处检索相关信息。

IBM于今年6月在联合国环境规划署的一个咨询会上展示了这套设计原型。此次会议,亦是2021年联合国环境大会第五届会议的预筹备论坛。

Holmes补充道,“我们之所以进行这一概念验证,旨在强调IT、特别是AI解决方案,在处理海洋垃圾问题及帮助联合国实际可持续发展目标方面,都发挥着至关重要的作用。”

这些可持续发展目标,包括到2025年减少海洋污染,也是各国共同努力推动地球全面实现可持续发展的重要发展蓝图。

与海洋污染目标相关的一项重要指标,为“沿海区域富营养化与塑料漂浮碎片密度”。

Holmes指出,为了实现这一目标,必须开发一种新的机制以跟踪塑料碎片随时间推移发生的密度变化。但到目前为止,环境署还没有出台关于塑料碎片密度的任何基准评估值。

在世界各地众多志愿者的协同努力之下,海洋塑料密度数据已经逐渐充实,但不同组织往往使用不同的计量方法,因此必须首先对数据进行组织与标准化,而后才能加以分析……最终以统一的方式完成结果呈现。

只有这样,才能实现一种可随时间推移衡量改善进度的方法。

那么,Sam的作用究竟是什么?

简单来说,有什么问题,都可以直接问他。

Holmes回应道,“我们的目标是,让联合国环境规划署全球海洋垃圾平台中的信息,变得更加易于访问。”

“无论你是普通民众、成员国官员或者行业代表,包括当地政府雇员,乃至非营利组织成员,都可以轻松与之交互,就解决全球海洋垃圾问题采取行动。”

目前,Holmes已经向环境署提供Sam化身方案,各合作伙伴们则计划在今年晚些时候分享更多项目成果。

海洋垃圾数据易于访问及使用,有何具体价值?

简单来说,我们需要让人们更积极地参与到海洋垃圾问题的解决中,并为他们提供采取行动所需要的信息与数据支持。

Holmes指出,“难以访问及使用的数据自然容易受到忽视。IBM的AI专家团队与环境界为此设立了共同的目标,即以一种引人入胜、直观且新颖的方式访问并使用海洋垃圾数据。”

Holmes表示,Sam化身的实现,离不开作为技术底层的协作沙箱概念——即通过一系列虚拟机与协同空间,将思路转化为实际解决方案。这一项目也在联合国环境规划署组织的会议上得到广泛好评。

作为在线服务,Sam能够为从周末志愿者到政府机构的任何个人、团体或组织提供洞见与可行性数据。

“虽然这套免费的概念验证系统尚未正式揽入使用,但其已经通过联合国环境规划署、IBM以及各成员国代表的审议与体验。我们对这一目标感到兴奋,也将努力推动其不断完善。未来,我们将说明更多用户加入进来,在Sam的帮助下持续降低海洋垃圾数据的获取门槛、改善海洋环境保护行动的实际效果。”

好文章,需要你的鼓励

-

加州大学洛杉矶分校、腾讯混元等推出Unify-Agent:一个能搜索全世界图片知识的AI画师

加州大学洛杉矶分校等机构联合推出的Unify-Agent突破了传统AI图像生成的知识局限,通过整合"思考-搜索-整理-绘制"四步工作流程,让AI画师具备主动查找资料的能力。该系统在FactIP基准测试中相关性指标提升61%,特别擅长处理需要准确世界知识的长尾内容和文化特色图像生成任务。

-

中科院团队首创FlowPIE:让AI像进化生物一样自动"孵化"科学创意,告别千篇一律的研究思路

中科院团队开发的FlowPIE系统首次将动态文献探索与创意进化相结合,突破传统AI科学创意生成的同质化局限。该系统通过流引导蒙特卡洛树搜索实现文献检索与创意生成的紧密耦合,并采用类生物进化机制持续优化创意质量。实验显示,FlowPIE在新颖性、可行性等维度显著超越现有方法,展现出强大的跨领域泛化能力,为AI辅助科研开辟了新路径。

-

阿里巴巴DAMO院推出虚拟细胞世界:Lingshu-Cell让单细胞生物学迎来AI革命

阿里巴巴DAMO研究院推出Lingshu-Cell虚拟细胞建模系统,采用掩码离散扩散模型技术,能够精确模拟和预测细胞在基因编辑、药物刺激等干预下的反应。该系统在国际虚拟细胞挑战赛中表现出色,为个性化医疗和药物开发开辟了全新路径,标志着数字生物学时代的到来。

-

上海AI实验室推出GEMS:让小模型也能像大师一样生成完美图像

上海AI实验室联合多所高校发布GEMS技术,通过智能团队协作机制让60亿参数的小模型在图像生成上超越顶级商业模型。该系统包含循环优化、记忆管理和技能库三大核心,采用多轮迭代和专业技能匹配,在主流测试中提升14分以上,为资源受限环境下的高质量AI应用提供新方案。