入局智驾的印奇,看到了怎样的未来?

作者 | 金旺

栏目 | 具身资讯

2024年7月,年仅36岁的印奇开启了他的第二次创业。

第一次创业,印奇和自己在清华姚班的两位同学唐文斌、杨沐一起创立的旷视科技,旷视科技后来成长为国内第一批“AI四小龙”,三位创始人也成了中国AI领域关键人物。

第二次创业,印奇在2024年成立江河顺遂,江河顺遂作价24.3亿元受让吉利旗下公司所持有的力帆科技部分股份后,力帆科技更名为千里科技,印奇于同年任职千里科技董事长。

从人工智能明星企业转入智能驾驶赛道算不上跨界,但对于印奇而言,这仍是一次新的尝试,一次凭借AI改变汽车行业的尝试。

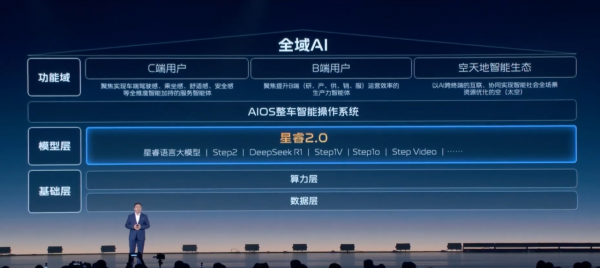

3月3日,继在上海GDC 2025上与吉利汽车、阶跃星辰联合官宣打造汽车全域智能后,在吉利AI智能科技发布会上,千里科技董事长印奇作为主咖,在发布会上阐述了他的“AI+车”理念。

01 2025,“AI+车”元年

在汽车圈,吉利是在大模型领域早起的那个人。

早在2021年,吉利就部署了AI技术,并在行业还不明朗时启动了基础大模型的研究。

吉利汽车集团CEO淦家阅在发布会上指出,“目前吉利已经将AI技术应用到了架构、动力、座舱、底盘等汽车全域和全价值链中,这让吉利成为了AI造车第一车企。”

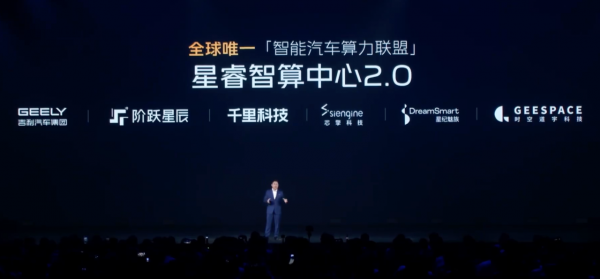

要成为AI造车第一车企,只有吉利汽车自己的研发力量是不够的,于是,吉利基于星睿智算中心2.0成立了智能汽车算力联盟。

作为吉利生态战略合作伙伴,以及吉利汽车智驾系统技术供应商,千里科技自然也是这一联盟中的一员。

作为千里科技董事长,印奇认为,人工智能技术进步与汽车产业发展有着共振。

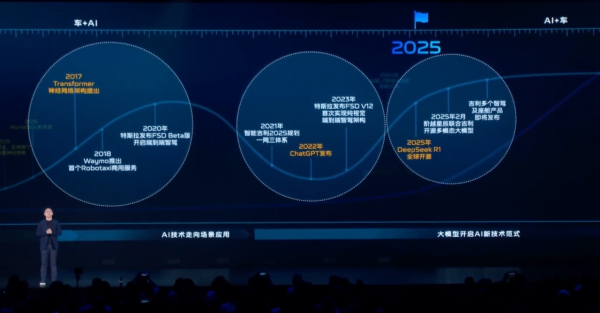

关于人工智能与汽车产业的共振,印奇特别提到了三个时间节点:

第一个节点,2017年,以Transformer为代表的全新AI技术架构正式推出,一年后,Waymo推出了Robotaxi第一个商用服务,接着,特斯拉在2020年上线了FSD Beta版本;

第二个节点,2021年,吉利发布“智能吉利2025战略”、打造了“一网三体系”,一年后,OpenAI发布了震惊全球的ChatGPT,接着,特斯拉在2023年发布了首次实现纯视觉端到端智驾架构的FSD V12;

第三个节点,2025年,DeepSeek R1全球开源,再次引爆全球人工智能领域,紧随其后,吉利与阶跃星辰联合开源两款多模态大模型,与此同时,今年也是“智能吉利2025战略”的收官之年,更多智驾和座舱产品即将涌现。

正是藉由人工智能技术突破,以及在汽车产业中的应用情况,印奇认为,2025年是“AI+车”的元年。

02 “AI+车”的三个趋势

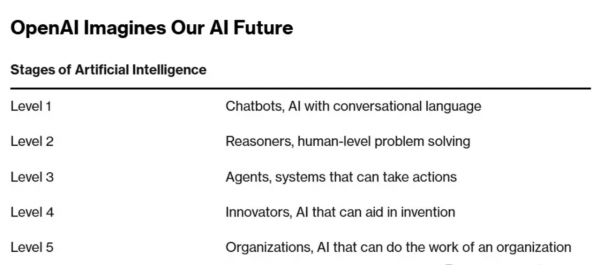

2024年,掀起这次人工智能浪潮的OpenAI,就AGI(通用人工智能)技术提出了五级分级架构,在这一架构中,人工智能技术被划分为五个阶段,分别为:

L1:聊天机器人(ChatBots),具有对话能力的AI;

L2:推理者(Reasoners),可以像人类一样解决问题的AI;

L3:智能体(Agents),不仅能思考,还可以采取行动的AI系统;

L4:创新者(Innovators),可以协助发明创造的AI;

L5:组织者(Organizations),可以完成组织工作的AI。

印奇认为,当前人工智能正在从L2的推理者向L3的智能体本质跨越,2025年也会成为智能体爆发的一年。

实际上,无论是智能语音系统,还是多模态大模型,在过去几年已经逐渐被用到了汽车上,乃至座舱中。

而就现在多模态智能体发展趋势下,印奇提出了他认为的“AI+车”三大趋势:

第一个趋势,超自然人机交互的诞生。

从当年PC上的GUI发展到移动互联网时代的Touch UI,如今我们在汽车,乃至更多场景下,正在迈入一个超自然的Ultra Nature UI交互形态。

千里科技与吉利正在重新定义的具备超自然对话、AgentOS、跨域协同的下一代座舱系统,预计将在今年内发布,并在银河品牌车上上线。

第二个趋势,自动驾驶及自动执行的全面落地。

机器人领域机械臂的VLA模型,以及世界生成模型的高速发展,未来将会有越来越多机器人应用场景和自动执行场景迎来爆发, 而汽车将会是最趋向机器人,也是最大规模的机器人落地场景。

吉利联合生态企业推出的千里浩瀚,将作为具备L3量产能力的解决方案今年搭载到银河品牌车型上。

第三个趋势,车联网大模型量级升维。

从模型的数据量来看,目前智驾大模型大约会用到1000万个视频片段,但是人工智能基础大模型会用到10亿个视频片段;

从模型的物体识别类别来看智能驾驶识别的障碍物类别在百级,大部不能被识别的障碍物被简单地归类为通用可移动/不可移动障碍物,而如今最先进的多模态大模型能够识别的物体种类能够能达十万级别。

真正的AI大模型实际上比现在车上的AI模型先进1-2代,如果能将大模型应用到车上,这将会智能汽车带来巨大潜力。

印奇认为,汽车将会在未来化身为一个超级智能体,乃至一个“出行智慧生命体”。

这或许正是长于人工智能技术的印奇,第二次创业进入智能汽车赛道,看到的那个充满诱惑力的未来。

好文章,需要你的鼓励

-

南方科技大学等机构联手破解AI推理训练难题:让大模型"一次思考"就学会解题

本文介绍了由南方科技大学等机构于2026年4月发表的研究(arXiv:2604.08865),提出了名为SPPO的大模型推理训练新方法。该方法将推理任务重新建模为"序列级情境赌博机",用一个轻量级价值模型预测题目难度,以单次采样替代GRPO的多次采样,解决了标准PPO的"尾部效应"问题。实验显示,SPPO在数学基准测试上超越GRPO,训练速度提升约5.9倍,配合小尺寸价值模型还能显著降低显存占用。

-

香港科技大学数学系研究者:扩散模型原来是一个"魔法恒等式"拆成了两半

这项由香港科技大学数学系完成的研究(arXiv:2604.10465,2026年ICLR博客论文赛道)提出了一种从朗之万动力学视角理解扩散模型的统一框架。研究指出,扩散模型的前向加噪和逆向去噪过程,本质上是朗之万动力学这一"分布恒等操作"被拆成了两半。在这个视角下,VP、VE-Karras和Flow Matching等不同参数化的模型可被精确互译,SDE与ODE版本可被统一解释,扩散模型相对VAE的理论优势得以阐明,Flow Matching与得分匹配的等价性也得到了严格论证。

-

中国人民大学研究团队打造的"AI科学家":让机器自主完成几十小时的科研工程,它是怎么做到的?

中国人民大学高岭人工智能学院等机构联合开发了AiScientist系统,旨在让AI自主完成机器学习研究的完整工程流程,包括读论文、搭环境、写代码、跑实验和迭代调试,全程无需人工干预。系统核心设计是"薄控制、厚状态":由轻量指挥官协调专业代理团队,通过"文件即通道"机制将所有中间成果持久化存储,使每轮工作都能建立在前一轮积累的基础上。在PaperBench和MLE-Bench Lite两个基准上,系统表现显著优于现有最强对比系统,论文发布于2026年4月。

-

字节跳动发布GRN:像人类画家一样"边画边改"的AI图像生成新范式

这项由字节跳动发布的研究(arXiv:2604.13030)提出了生成式精化网络(GRN),一套模仿人类画家"边画边改"直觉的视觉生成新框架。其核心包括两项创新:层级二进制量化(HBQ)通过多轮二分逼近实现近乎无损的离散图像编码,以及全局精化机制允许模型在每一步对整张图像的所有位置重新预测并随时纠错,从根本上解决了自回归模型的误差积累问题。配合基于熵值的自适应步数调度,GRN在ImageNet图像重建(rFID 0.56)和生成(gFID 1.81)上均创下新纪录,并在文本生成图像和视频任务上以20亿参数达到同等规模方法的领先水平。