使用多模态技术自动给语音贴情绪标签:MIKU-PAL如何突破情感语音合成的瓶颈

**多模态情感语音标注的新突破:MIKU-PAL系统详解**

在人工智能快速发展的今天,让AI能够用丰富的情感说话已成为研究热点。然而,制作高质量的情感语音合成系统一直面临一个关键瓶颈:缺乏大规模且一致性强的情感语音数据。2025年5月,来自Fish Audio(美国圣克拉拉)的研究团队Yifan Cheng、Ruoyi Zhang以及卡内基梅隆大学的Jiatong Shi发表了一篇突破性论文《MIKU-PAL: An Automated and Standardized Multimodal Method for Speech Paralinguistic and Affect Labeling》,提出了一种全新的自动化情感标注方法,有望彻底改变情感语音合成的研究格局。该论文发表于arXiv(arXiv:2505.15772v1),为语音合成领域带来了新的研究视角和解决方案。

一、为什么情感语音合成一直是个难题?

想象一下,如果你的智能音箱不仅能机械地回答你的问题,还能用欢快的语气祝贺你,或用关切的声音询问你的状况,这样的交互会让科技产品更像人类伙伴而非冷冰冰的机器。但要实现这一点,AI需要大量带有情感标签的语音数据来学习。

问题就出在这里。当前主流的语音语言模型通常基于数百万小时的语音数据训练,但带有情感标签的语音数据集却极其有限。比如IEMOCAP、MELD和MSP-Podcast等经典情感语音数据集,通常包含不足300小时的数据,且这些数据都需要人工标注,这一过程既昂贵又耗时。

更关键的是,现有数据集通常仅包含5-8种基本情感类别(通常基于Ekman的基本情感框架),而心理学研究表明,人类情感远比这复杂丰富得多。相比之下,自然语言处理领域的情感数据集已经包含多达27种情感类别。这种差距严重限制了情感语音合成的表现力和自然度。

二、MIKU-PAL:自动化情感标注的突破性解决方案

Fish Audio和卡内基梅隆大学的研究团队提出了一个名为MIKU-PAL(Multimodal Intelligence Kit for Understanding - Paralinguistic and Affect Labeling)的框架,这是一个全自动的多模态情感标注系统。

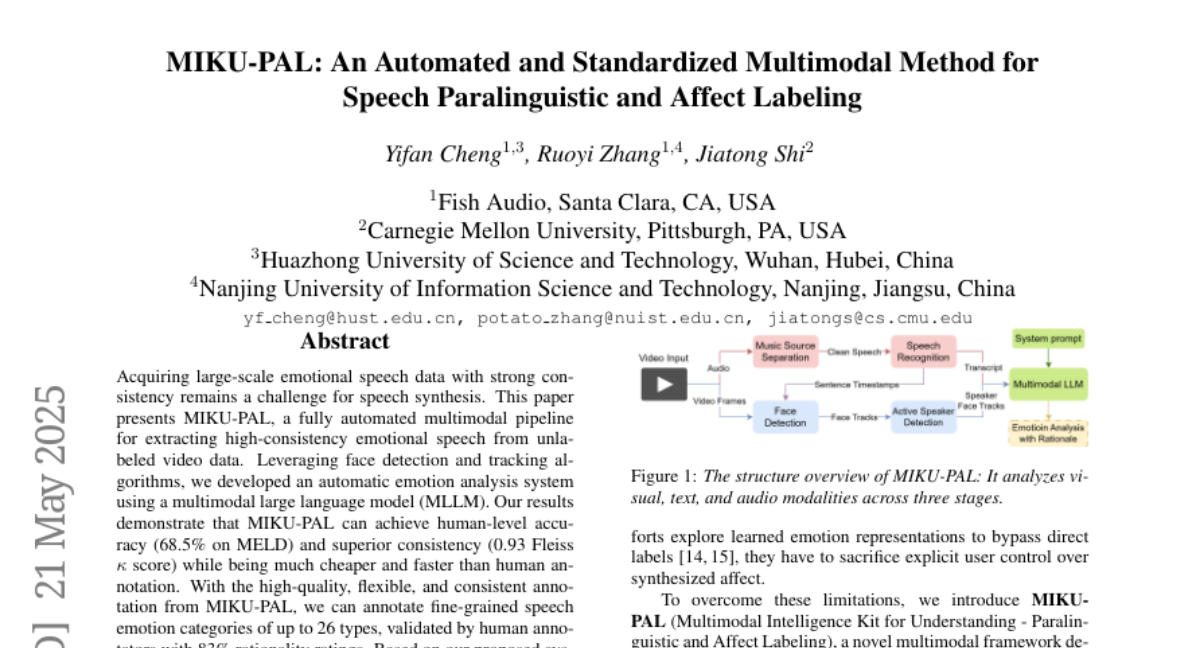

想象MIKU-PAL就像一位精通心理学的电影评论家,它不仅听角色说了什么,还观察他们的面部表情和肢体语言,然后结合所有线索做出综合判断。具体来说,MIKU-PAL通过三个主要阶段工作:

首先是音频预处理阶段。原始视频中的语音往往混杂着背景音乐和环境噪音,这会影响情感分析的准确性。MIKU-PAL使用一种叫做MDX-Net的音乐源分离模型提取纯净的人声,就像从混杂的派对声音中分离出某个人的声音一样。研究团队分析了30集《老友记》片段,发现这一步骤将信噪比提高了36%。随后,系统使用Whisper-large v3模型转录语音内容并获取时间戳,这为后续的视觉处理提供了时间参考。

其次是视觉预处理阶段。系统使用S?FD或DSFD算法进行人脸检测,就像在照片中标记出所有人的脸一样。研究团队特别指出,由于他们分析的视频中说话者通常处于画面中央且比较突出,因此他们优先考虑处理速度而非最大准确率。此外,系统还集成了TalkNet算法来识别正在说话的人,准确率高达92%。这一步骤非常关键,因为它确保了系统能正确匹配音频和对应说话者的面部表情。研究团队的消融实验显示,添加视觉预处理后,情感分析准确率提高了25.6%。

最后是MLLM情感分析阶段。研究团队采用了Gemini 2.0 Flash大型多模态语言模型进行情感分析。你可以把这个模型想象成一位经验丰富的心理学家,它能同时分析一个人的言语内容、语调和面部表情来判断情感状态。研究团队精心设计了系统提示,包括任务描述、情感文本描述和输出结构,引导模型评估不同模态的情感特征,并最终给出自然语言形式的判断理由。

三、MIKU-PAL的26种情感分类系统

传统的情感语音数据集通常只包含愤怒、厌恶、恐惧、喜悦、悲伤和惊讶等基本情感类别。然而,随着心理学研究的深入,这种简化的分类越来越不能满足实际需求。

研究团队参考了Cowen等人的心理学研究,构建了一个包含26种情感类别的更全面系统。这些类别包括:崇拜、爱慕、审美、愉悦、愤怒、焦虑、敬畏、尴尬、无聊、平静、困惑、渴望、厌恶、感同身受的痛苦、着迷、兴奋、恐惧、恐怖、兴趣、喜悦、浪漫/爱情、怀旧、宽慰、悲伤、满足和惊讶。(出于伦理考虑,原始研究中的一个类别被移除)

为了验证MIKU-PAL捕捉这26种情感类别的能力,研究团队对10,000个随机收集的YouTube视频片段进行了混合情感标注实验。他们使用t-SNE技术将所有情感标注结果降维到二维空间并可视化。结果图谱揭示了人类情感的轨迹和分布,展示了从爱慕到爱情,从喜悦到满足再到兴奋等情感转变。这些观察到的模式与原始心理学研究的结论高度一致,证明了MIKU-PAL捕捉扩展情感分类的合理性。

为了进一步验证MIKU-PAL的标注是否符合人类感知,研究团队招募了5名没有相关背景的人类标注者评估1000个平衡样本,结果显示83%的MIKU-PAL标注被认为是合理的。这表明该系统的情感判断与人类认知高度一致。

四、MIKU-PAL的性能评估

研究团队从工程性能、准确性、一致性和情感TTS性能四个方面全面评估了MIKU-PAL系统。

在工程性能方面,MIKU-PAL在配备8个NVIDIA RTX 4090 GPU的标准工作站上展现出显著优势。处理720p 30fps视频时,系统的处理速度比约为1:12,意味着系统处理12小时的原始视频需要1小时。从随机收集的YouTube视频中,系统保留了约42%的内容作为最终音频。整个流程支持并行处理,GPU处理速度是主要瓶颈。使用最新的Google Gemini 2.0 Flash模型,MIKU-PAL生成1小时情感语音数据集的成本约为50美分,远低于人工标注的成本。

在准确性方面,研究团队在IEMOCAP和MELD数据集上验证了系统的准确率,总体准确率约为65%。通过分析混淆矩阵发现,错误分类主要发生在"沮丧"和"中性"情绪之间。有趣的是,这两种情绪类别在心理学情绪分类中并不被认为是独立的基本情绪,而通常被认为包含在其他更广泛的情绪类别中。当排除这两种情绪时,MIKU-PAL的准确率达到约75%,超过了人类标注者的平均准确率。

在一致性方面,研究团队计算了MIKU-PAL在IEMOCAP和MELD数据集上的Fleiss' Kappa分数。在五次独立标注实验中,保持一致的提示和模型配置,MIKU-PAL在IEMOCAP上达到了0.93的Fleiss' Kappa分数,在MELD上达到了0.95。这表明标注一致性非常高,显著超过了人类标注者通常达到的一致性水平。

在情感TTS性能方面,研究团队使用MIKU-PAL重新标注了IEMOCAP和MELD数据集,并使用特殊情感标记微调Fish-Speech模型。与基于原始数据集微调的基线模型相比,这一微调模型在平均意见得分(MOS)上获得了显著提升(+0.08)。此外,两个模型都在TTS中展示了有效的显式情感控制能力。这一结果证实了MIKU-PAL标注数据对情感TTS任务的有效性。

五、MIKU-EmoBench:一个新的情感语音基准数据集

基于MIKU-PAL系统,研究团队开发了一个名为MIKU-EmoBench的新数据集,旨在解决现有情感数据集在数据规模和情感粒度方面的关键限制。

MIKU-EmoBench包含131.2小时的情感标注音频,分为65,970个片段,平均持续时间为7.16秒(最短2秒)。为确保多样性,数据集包含来自各种场景(如访谈、电影、日常对话)、国家和地区(如美国、欧洲、亚洲)以及种族(如白人、亚洲人、非裔)的音频。这种丰富的多样性提供了情感语音的广泛表示。标注覆盖26种混合情感,每种情感都有强度得分和文本理由,提供详细而细致的情感信息。

研究团队选择Fish-Speech和CosyVoice作为基线模型进行评估。他们使用IEMOCAP、MELD(训练集)、MSP-Podcast和MIKU-EmoBench微调Fish-Speech,并在MELD测试集上统一测试它们。评估指标包括词错率(WER)、说话者相似度(使用VERSA测量)、人类标注的平均意见得分(MOS)和情感相似度(使用FunASR情感向量计算)。结果表明,使用MIKU-EmoBench微调的模型在保持TTS质量的同时,在MOS和情感相似度方面都有所提升。这证明了MIKU-PAL和MIKU-EmoBench在情感TTS任务中的有效性。

六、MIKU-PAL的意义与未来展望

MIKU-PAL的出现解决了情感语音合成领域长期存在的数据瓶颈问题。传统的人工标注方法成本高、耗时长且一致性差,严重限制了情感语音数据集的规模和多样性。MIKU-PAL提供了一种全自动、标准化的解决方案,能够高效、低成本地从未标注视频中提取高一致性的情感语音数据。

更重要的是,MIKU-PAL扩展了情感类别,从传统的5-8种基本情感扩展到26种心理学验证的情感类别,这为下一代情感语音合成系统提供了更丰富、更细致的情感表达能力。

当然,研究团队也承认MIKU-PAL存在一些局限性,如模型依赖性和来自YouTube数据的潜在偏见。未来的工作将进一步提升MIKU-PAL的准确性、鲁棒性和适应性。

总的来说,MIKU-PAL代表了情感语音合成领域的重要突破,为解决长期存在的数据瓶颈问题提供了一种可行且有效的解决方案。基于MIKU-PAL开发的MIKU-EmoBench数据集将为未来的情感语音研究提供重要基础,推动情感语音合成技术向更自然、更人性化的方向发展。如果你对这项研究感兴趣,可以在arXiv上搜索"2505.15772v1"获取完整论文,或访问研究团队在Hugging Face上发布的MIKU-EmoBench数据集(https://huggingface.co/datasets/WhaleDolphin/MIKU-EmoBench)。

好文章,需要你的鼓励

-

南方科技大学等机构联手破解AI推理训练难题:让大模型"一次思考"就学会解题

本文介绍了由南方科技大学等机构于2026年4月发表的研究(arXiv:2604.08865),提出了名为SPPO的大模型推理训练新方法。该方法将推理任务重新建模为"序列级情境赌博机",用一个轻量级价值模型预测题目难度,以单次采样替代GRPO的多次采样,解决了标准PPO的"尾部效应"问题。实验显示,SPPO在数学基准测试上超越GRPO,训练速度提升约5.9倍,配合小尺寸价值模型还能显著降低显存占用。

-

香港科技大学数学系研究者:扩散模型原来是一个"魔法恒等式"拆成了两半

这项由香港科技大学数学系完成的研究(arXiv:2604.10465,2026年ICLR博客论文赛道)提出了一种从朗之万动力学视角理解扩散模型的统一框架。研究指出,扩散模型的前向加噪和逆向去噪过程,本质上是朗之万动力学这一"分布恒等操作"被拆成了两半。在这个视角下,VP、VE-Karras和Flow Matching等不同参数化的模型可被精确互译,SDE与ODE版本可被统一解释,扩散模型相对VAE的理论优势得以阐明,Flow Matching与得分匹配的等价性也得到了严格论证。

-

中国人民大学研究团队打造的"AI科学家":让机器自主完成几十小时的科研工程,它是怎么做到的?

中国人民大学高岭人工智能学院等机构联合开发了AiScientist系统,旨在让AI自主完成机器学习研究的完整工程流程,包括读论文、搭环境、写代码、跑实验和迭代调试,全程无需人工干预。系统核心设计是"薄控制、厚状态":由轻量指挥官协调专业代理团队,通过"文件即通道"机制将所有中间成果持久化存储,使每轮工作都能建立在前一轮积累的基础上。在PaperBench和MLE-Bench Lite两个基准上,系统表现显著优于现有最强对比系统,论文发布于2026年4月。

-

字节跳动发布GRN:像人类画家一样"边画边改"的AI图像生成新范式

这项由字节跳动发布的研究(arXiv:2604.13030)提出了生成式精化网络(GRN),一套模仿人类画家"边画边改"直觉的视觉生成新框架。其核心包括两项创新:层级二进制量化(HBQ)通过多轮二分逼近实现近乎无损的离散图像编码,以及全局精化机制允许模型在每一步对整张图像的所有位置重新预测并随时纠错,从根本上解决了自回归模型的误差积累问题。配合基于熵值的自适应步数调度,GRN在ImageNet图像重建(rFID 0.56)和生成(gFID 1.81)上均创下新纪录,并在文本生成图像和视频任务上以20亿参数达到同等规模方法的领先水平。