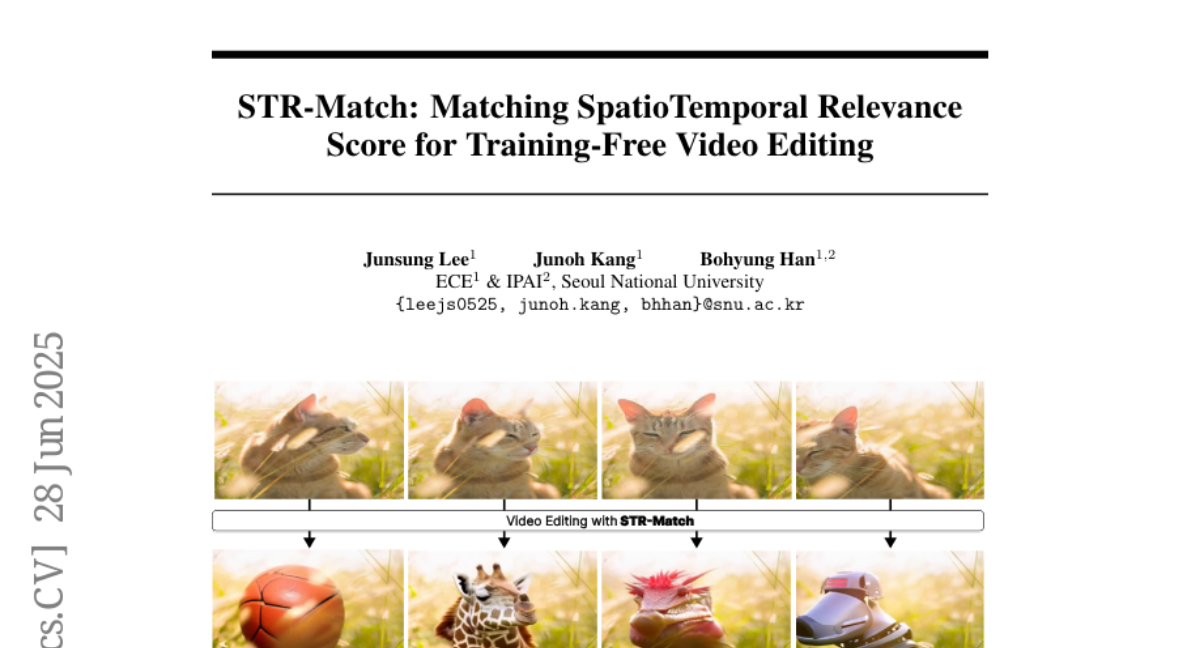

STR-Match:视频编辑的新革命,首尔国立大学团队让视频换装就像换衣服一样简单

这项由首尔国立大学电子与计算机工程学院以及人工智能研究院的李俊成、姜俊午和韩宝炯教授团队开发的突破性技术,于2025年6月28日发表在计算机视觉领域的顶级学术平台arXiv上(论文编号:arXiv:2506.22868v1),感兴趣的读者可以通过该编号在arXiv官网上找到完整论文。

一、当视频编辑遇到了真正的难题

平时我们刷抖音或者B站的时候,经常会看到一些令人惊叹的视频特效:一只猫突然变成了龙,游泳的金鱼瞬间变成了鲨鱼,或者背景从橙色夕阳换成了清澈的蓝天。这些看似神奇的效果背后,其实隐藏着视频编辑技术的一个巨大挑战。

回想一下你用手机剪辑软件编辑视频的经历。当你想把视频里的某个物体换成别的东西时,是不是经常遇到这样的问题:换完之后的视频看起来很不自然,物体会闪烁跳动,或者整个画面变得模糊扭曲?这就像你想给一个人换件衣服,结果不仅衣服穿歪了,连这个人的动作都变得僵硬古怪。

现有的视频编辑方法就像是一个技艺不精的裁缝。当你要求它把视频中的狗换成猫时,它要么只换了个头,身体还是狗的样子;要么干脆把整个背景也弄乱了,原本清晰的花园变成了一片模糊的色块。更糟糕的是,在处理连续的视频帧时,这个"裁缝"经常会前后不一致,上一秒钟猫还在左边,下一秒就突然跳到了右边,完全没有遵循原来的运动轨迹。

问题的根源在于,这些传统方法就像是只看了一张静态照片就开始工作的裁缝,它们无法理解视频中不同帧之间的时间关系,也不能准确把握空间中不同像素点之间的关联。当面临巨大的变化——比如把一只温顺的家猫变成一条威武的龙——这些方法就彻底"抓瞎"了。

二、STR-Match的突破性解决方案

首尔国立大学的研究团队提出了一个叫做STR-Match的全新方法,这个名字代表"时空相关性匹配"。如果把传统方法比作只会看静态照片的裁缝,那么STR-Match就像是一个具有"时空透视眼"的超级裁缝,它不仅能看清每一帧画面,还能理解不同时间点和不同位置之间的微妙关系。

STR-Match的核心创新在于提出了一个叫做"STR分数"的概念。这个分数就像是视频中每个像素点的"身份证",记录着它与周围像素点以及前后时间帧中对应位置的关系强度。传统方法只能看到孤立的像素点,而STR分数能够捕捉到像素点之间的"社交网络"——哪些像素是"好朋友",它们在时间和空间上如何相互影响。

这种方法的巧妙之处在于,它不需要重新训练任何人工智能模型,而是充分利用现有的文本到视频生成模型中已经包含的空间注意力机制和时间注意力机制。空间注意力就像是在每一帧画面中画出一张"关系地图",标明哪些像素点彼此相关;时间注意力则像是在不同时间帧之间建立"时间隧道",连接相同位置在不同时刻的像素点。STR分数巧妙地将这两种注意力机制结合起来,形成了一个完整的时空关系网络。

具体来说,STR分数的计算过程就像是在做一道复杂的数学题。对于视频中任意两个像素点,比如第i帧中位置p的像素和第j帧中位置q的像素,STR方法会计算它们之间的"双向相关性"。这种计算不是简单的直线连接,而是考虑了多条路径:一条路径是通过时间连接(从第i帧的p位置到第j帧的p位置,再到第j帧的q位置),另一条路径是通过空间连接(从第i帧的p位置到第i帧的q位置,再到第j帧的q位置)。最终的STR分数是这两条路径相关性的综合。

更进一步,为了获得整个视频的时空信息,STR-Match会将每个像素点与其相邻帧中所有像素点的双向相关性进行汇总。这就像是为每个像素点建立了一个"朋友圈",记录着它与周围所有"朋友"的关系强度总和。这个汇总过程确保了方法能够捕捉到视频中的关键视觉特征,比如物体的运动模式和结构布局。

三、优化策略:如何让视频编辑变得既精准又自然

有了STR分数这个强大的工具,STR-Match采用了一种叫做"潜在空间优化"的策略来实现视频编辑。这个过程就像是在一个特殊的"梦境空间"中进行手术,而不是直接在现实的视频画面上动刀。

整个编辑过程分为几个关键步骤。首先,系统会对原始视频进行"正向扩散"处理,这个过程就像是把一张清晰的照片逐渐加上噪点,直到变成完全的随机噪声。在这个过程中,系统会在每个时间步骤记录下对应的STR分数,形成一系列"指纹"。这些指纹包含了原始视频在不同噪声级别下的时空关系信息。

接下来,系统开始"反向生成"过程。它从最后的噪声状态开始,逐步去除噪声,同时引入目标文本描述(比如"猫变成龙")的指导。关键的创新在于,在每个去噪步骤中,系统都会计算当前生成结果的STR分数,并将其与之前记录的原始视频STR分数进行比较。

这个比较过程使用的是"负余弦相似度"作为优化目标。余弦相似度是衡量两个向量方向相似程度的数学指标,值越接近1表示越相似。通过最大化STR分数之间的余弦相似度,系统确保生成的视频在时空关系上与原始视频保持一致,同时又能体现出目标文本描述的特征。

为了进一步提升编辑质量,STR-Match还引入了一个"潜在掩码策略"。这就像是给不需要编辑的区域戴上"保护罩",确保它们在编辑过程中不会被意外改变。系统使用SAM-Track等视频分割工具自动识别需要编辑的前景对象,然后为背景和其他不相关区域创建一个二进制掩码。在优化过程中,被掩码保护的区域会直接使用原始视频的内容,而只有需要编辑的区域才会应用STR优化。

这种掩码策略的巧妙之处在于使用了"膨胀操作"。就像在保护区域周围画一圈缓冲带,这确保了编辑区域与保护区域之间有平滑的过渡,避免出现生硬的边界效果。同时,这种操作还允许目标对象进行一定程度的形状变化,比如当猫变成龙时,龙可以比原来的猫稍微大一些。

四、实验验证:从日常编辑到极限挑战的全面测试

研究团队对STR-Match进行了全面而严格的测试,既包括定量的数据分析,也包括定性的视觉效果比较。实验设计就像是给不同的"视频编辑师"出了一系列从简单到困难的考题,看看谁能交出最满意的答卷。

在实验设置方面,团队收集了54个测试视频,每个包含16帧画面。这些视频既包括来自TGVE数据集的标准测试样本,也包括从互联网上收集的各种真实场景视频。为了确保测试的客观性,团队使用VideoLLaMA3-7B这个预训练的视频描述模型来自动生成源视频的文本描述,然后通过随机改变名词的方式构造目标编辑描述。

定量评估采用了四个关键指标,每个指标都像是从不同角度检验编辑质量的"评委"。帧一致性指标测量视频的平滑度,就像检查动画师是否画出了流畅的动作。CLIP相似度评估编辑结果是否符合目标文本描述,相当于检查"货品是否对版"。背景LPIPS分数计算保护区域的保真度,确保不该变的地方确实没变。运动误差指标量化原始视频与编辑视频之间的运动差异,验证动作是否保持了原有的节奏和轨迹。

在定性比较中,STR-Match展现出了明显的优势。在"婴儿变成睡着的婴儿"这个相对简单的编辑任务中,其他方法往往会改变婴儿的肤色或者背景的色调,而STR-Match能够保持整个画面色调的一致性。在"莲花变成雏菊"的案例中,许多基线方法要么完全无法替换莲花,要么在成功替换的同时意外改变了背景,而STR-Match成功地进行了高保真度的替换,同时完美保持了背景的完整性。

在处理动态内容时,STR-Match的优势更加明显。在"斑马变成马"的测试中,大多数现有方法要么无法捕捉到马抬腿的动作,要么在保持动作的同时牺牲了外观质量。Ground-A-Video等方法甚至会破坏整个场景的一致性。相比之下,STR-Match不仅完美复现了原始的运动模式,还保持了高度的视觉保真度。

更令人印象深刻的是STR-Match在极端编辑场景中的表现。在"猫变成篮球"这个挑战人类想象力的任务中,大多数现有方法都彻底失败了,而DMT虽然能生成篮球,但代价是严重的背景扭曲。类似地,在"鱼变成红薯"的测试中,DMT和FLATTEN只能进行部分修改,且伴随着背景失真或低保真度问题,其他方法则完全无法执行编辑。STR-Match在这些极端案例中都能成功完成形状转换,保持高视觉保真度的同时完美保护背景。

定量结果进一步证实了这些观察。在雷达图分析中,STR-Match无论是否使用掩码策略,都占据了更大的面积,表明在所有评估维度上都有优秀的表现。与基于文本到图像模型的方法相比,STR-Match在帧一致性方面表现出明显优势,这证明了STR分数确实有效捕捉了文本到视频模型中的时空像素相关性。与其他基于文本到视频模型的方法相比,STR-Match在所有评估指标上都取得了最佳或接近最佳的性能,显示出了方法的全面性和鲁棒性。

五、核心技术的深度剖析:为什么STR分数如此有效

STR-Match的成功关键在于其对时空相关性的独特建模方式。传统方法往往将空间注意力和时间注意力分开处理,就像是两个各自为政的部门,缺乏有效的沟通协调。STR分数的创新在于将这两种注意力机制有机融合,创造出一个统一的时空表示。

这种融合的数学基础相当精巧。对于视频中的任意两个像素点,STR方法定义了"方向相关性"的概念。以像素Ii(p)(第i帧中位置p的像素)到像素Ij(q)(第j帧中位置q的像素)为例,方向相关性的计算包含两个乘积项。第一个乘积项是时间注意力和空间注意力的组合:从Ii(p)到Ij(p)的时间连接强度,乘以从Ij(p)到Ij(q)的空间连接强度。第二个乘积项是空间注意力和时间注意力的另一种组合:从Ii(p)到Ii(q)的空间连接强度,乘以从Ii(q)到Ij(q)的时间连接强度。最终的方向相关性是这两个乘积项的和。

双向相关性进一步扩展了这个概念,将从Ii(p)到Ij(q)和从Ij(q)到Ii(p)的方向相关性相加。这种设计确保了相关性的对称性,反映了像素点之间关系的双向性质。最终的STR分数是某个像素点与其邻近帧中所有像素点的双向相关性的累加,形成了一个综合的时空特征描述。

这种设计的巧妙之处在于它完全基于现有文本到视频模型的内部表示,无需任何额外的计算开销或模型训练。与那些需要计算完整3D注意力的方法相比,STR分数只需要已有的2D空间注意力和1D时间注意力,大大降低了计算复杂度。同时,由于STR分数是通过乘法运算得到的,它在优化过程中提供了更大的灵活性,避免了简单连接操作可能带来的约束过强问题。

六、消融实验:验证设计选择的合理性

为了验证STR分数设计的有效性,研究团队进行了详细的消融实验。他们设计了一个基线方法,直接优化空间注意力和时间注意力的连接,而不是使用STR分数的乘积形式。实验结果清晰地显示了STR分数的优势。

在"狗变成猫"的测试中,基线方法生成的视频出现了严重的过饱和问题,色彩失真明显。在"海龟变成鲨鱼"的案例中,基线方法无法成功改变目标对象的形状特征。这些问题的根源在于,简单的连接操作施加了过于严格的约束,限制了编辑的灵活性。相比之下,STR分数通过乘积运算提供了适当的约束强度,既保持了关键特征,又允许必要的变化。

定量比较进一步证实了这个观察。虽然基线方法在背景保护和运动保持方面表现稍好(这是约束过强的直接结果),但在保真度相关指标上明显不如STR-Match。更重要的是,基线方法经常无法完成预期的编辑任务,这使得其他指标的优势变得毫无意义。

研究团队还对超参数λ(控制优化强度的系数)进行了敏感性分析。实验测试了0.005、0.01和0.015三个值。结果显示,较小的λ值(0.005)能获得更高的保真度分数,但在背景保护和运动保持方面表现较差。较大的λ值(0.015)在保护原始内容方面更有效,但可能牺牲编辑质量。λ=0.01被证明是一个理想的平衡点,在所有指标上都取得了满意的性能。

七、方法的通用性和适应性

STR-Match的一个重要优势是其出色的通用性。虽然主要实验使用LaVie作为基础的文本到视频模型,但方法可以轻松适配其他具有时间模块的视频生成模型。研究团队使用Zeroscope模型进行的验证实验证明了这种适应性。

在"猫变成狗"、"金鱼变成小丑鱼"和"红玫瑰变成橙色郁金香"的测试中,基于Zeroscope的STR-Match展现出了与基于LaVie版本相似的编辑质量。这种跨模型的一致性表明,STR分数捕捉的时空相关性是视频生成模型的一个基本特性,而不是特定于某个模型架构的偶然现象。

这种通用性为STR-Match的实际应用提供了巨大的灵活性。用户可以根据自己的需求选择不同的基础模型,比如追求速度的可以选择轻量级模型,追求质量的可以选择更复杂的模型,而STR-Match都能在其基础上提供一致的编辑能力。

八、技术局限与未来展望

尽管STR-Match在视频编辑领域取得了显著进展,但研究团队也诚实地指出了方法的当前局限性。最主要的限制是无法同时编辑多个对象到不同的目标。例如,如果想要在同一个视频中将猫变成狗,同时将背景中的花变成树,目前只能分别进行两次编辑操作,这显然效率较低。

另一个局限性是在处理尺寸变化显著的对象时,编辑质量可能下降。虽然方法支持一定程度的形状变化,但当目标对象的尺寸与源对象差异过大时,可能出现不自然的效果。这个问题的根源在于STR分数主要建模相对位置关系,对绝对尺寸的变化适应性有限。

从计算效率的角度看,虽然STR-Match避免了3D注意力的计算开销,但优化过程仍然需要多次前向传播,这在处理长视频时可能成为瓶颈。未来的改进方向可能包括开发更高效的优化算法或者设计近似计算方法。

研究团队也提到了潜在的社会影响问题。由于STR-Match依赖于预训练的文本到视频模型,存在生成不当内容的风险。虽然这个问题可以通过控制基础模型的训练数据来缓解,但在实际应用中仍需要建立适当的内容审核机制。

九、实际应用前景与产业影响

STR-Match的出现为视频编辑产业带来了新的可能性。在短视频内容创作领域,创作者可以更容易地实现各种创意想法,无需复杂的专业技能或昂贵的软件工具。一个美食博主可以轻松地将视频中的苹果换成橙子,测试不同水果的视觉效果;游戏主播可以将自己变成游戏角色,增强直播的娱乐性。

在教育领域,STR-Match可以帮助制作更生动的教学视频。历史老师可以将现代场景中的元素替换成古代对应物,帮助学生更直观地理解历史背景;科学教师可以将抽象概念可视化,比如将分子运动的动画中的球体换成更具体的原子模型。

电影和广告行业也能从这项技术中受益。在预制作阶段,导演可以快速测试不同的视觉方案,无需重新拍摄就能比较不同道具或场景的效果。广告公司可以为不同地区的市场快速定制广告内容,将产品或背景元素替换成本地化的版本。

然而,技术的普及也带来了新的挑战。视频内容的可信度可能受到质疑,因为观众很难区分哪些是原始内容,哪些是AI编辑的结果。这要求平台和创作者建立更透明的标识机制,确保受众能够了解内容的真实性。

十、与现有技术生态的融合

STR-Match的设计哲学体现了当前AI技术发展的一个重要趋势:充分利用现有模型的能力,而不是从零开始构建新系统。这种"站在巨人肩膀上"的方法不仅提高了开发效率,也降低了技术门槛。

这种设计思路与当前的开源AI生态高度契合。随着越来越多的高质量文本到视频模型开源发布,STR-Match可以作为一个"插件"为这些模型增加编辑能力。这种模块化的设计使得技术的传播和应用更加容易,开发者可以根据自己的需求选择合适的基础模型和编辑工具。

从技术栈的角度看,STR-Match填补了生成式AI工具链中的一个重要空白。目前的工具主要集中在从零开始生成内容,而对现有内容的精确编辑能力相对薄弱。STR-Match的出现为这个生态系统增加了重要的一环,使得整个workflow更加完整。

说到底,STR-Match代表了视频编辑技术的一个重要里程碑。它不仅解决了传统方法在时空一致性方面的根本性问题,还为整个领域提供了新的思路和方向。通过巧妙地结合空间和时间注意力机制,这项技术让复杂的视频编辑变得像编辑文档一样简单直观。

当然,任何技术都不是完美的,STR-Match也有其局限性。但正如研究团队所展示的,这些局限性为未来的改进指明了方向。随着基础模型的不断进步和计算能力的提升,我们有理由相信,视频编辑将变得越来越智能、越来越便民。

对于普通用户来说,STR-Match的意义在于它降低了创意表达的门槛。你不再需要成为专业的视频编辑师,就能将脑海中的创意想法变成现实。对于研究者和开发者来说,这项工作提供了一个优雅的解决方案,证明了理论创新和实际应用可以完美结合。

如果你对这项技术的具体实现细节感兴趣,不妨查阅研究团队发布的完整论文。技术的进步离不开每个人的关注和支持,而STR-Match只是人工智能赋能创意表达这个宏大故事中的一个精彩章节。

Q&A

Q1:STR-Match是什么?它能做什么? A:STR-Match是首尔国立大学开发的视频编辑技术,它能够根据文字描述智能地修改视频内容,比如将视频中的猫变成龙、金鱼变成鲨鱼等,同时保持视频的动作流畅和背景完整。最重要的是,它不需要重新训练AI模型,可以直接使用现有的视频生成工具。

Q2:STR-Match会不会让视频变得不自然或者有明显的AI痕迹? A:不会。STR-Match的核心优势就是保持视频的自然性。它通过分析视频中像素点之间的时空关系,确保编辑后的视频在动作、光影、背景等方面都与原视频保持一致,避免了传统方法常见的闪烁、扭曲等问题。

Q3:普通人可以使用STR-Match吗?需要什么技术背景? A:目前STR-Match还是一个研究阶段的技术,需要一定的技术背景来部署使用。但研究团队已经开源了相关代码,感兴趣的开发者可以基于此开发更友好的应用工具。未来很可能会有基于STR-Match技术的消费级视频编辑软件出现。

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。