哈工大团队发现AI学新技能不忘老本事的秘诀:用一千个通用样本就够了!

这项由哈尔滨工业大学张育南、姜朔然、赵梦晨等研究人员主导的研究发表在《Journal of LaTeX Class Files》第14卷第8期(2021年8月),为大语言模型的持续学习难题提供了突破性解决方案。有兴趣深入了解的读者可以通过论文代码库https://github.com/Qznan/GeRe获取完整资料。

当今的人工智能就像一个极其聪明但健忘的学生。它能快速掌握新知识,却常常在学会新技能后忘记之前学过的内容。这种现象在学术界被称为"灾难性遗忘",是困扰AI研究多年的核心难题。

考虑这样一个场景:你有一个AI助手,最初它能流利地进行日常对话,还具备丰富的常识知识。然后你教它学习医学知识,它很快就能回答各种医学问题。但问题来了——当你再问它一些基本的生活常识时,它却开始胡言乱语,仿佛完全忘记了之前掌握的基础能力。这就是大语言模型在持续学习过程中面临的核心困境。

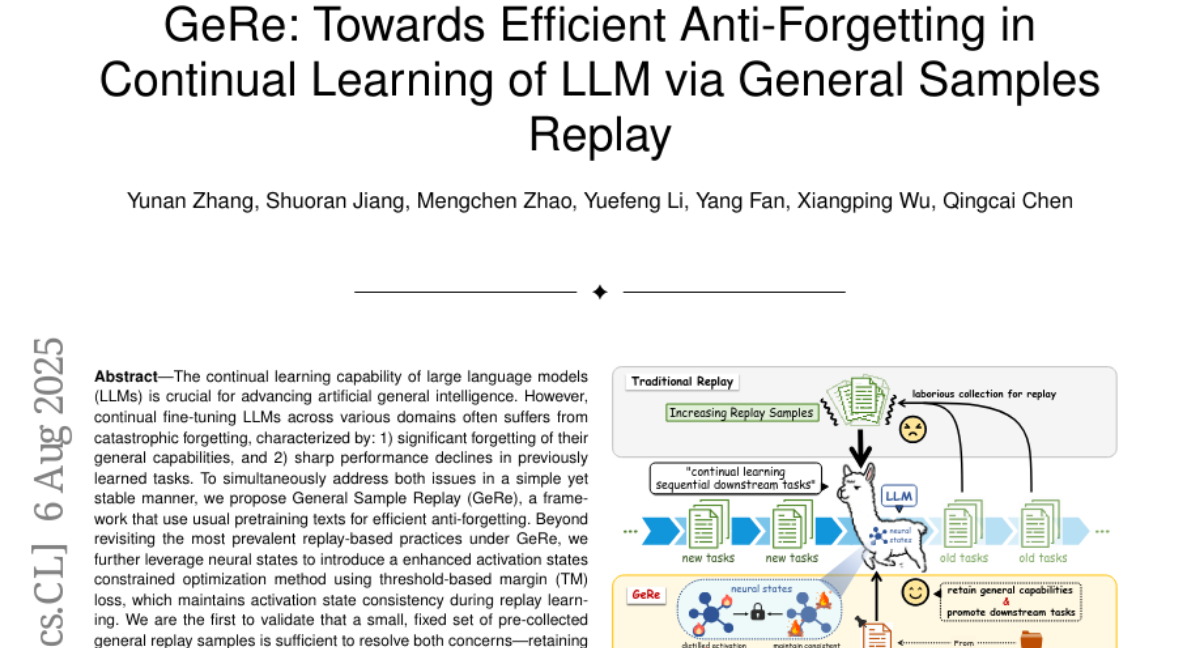

哈工大的研究团队发现了一个令人惊喜的解决方案。他们提出了一个名为GeRe(General Sample Replay,通用样本回放)的框架,最关键的发现是:只需要一千个从互联网上随机挑选的普通文本,就能让AI在学习新技能的同时保持原有能力不退化。

这个发现颠覆了传统认知。以往的研究认为,要让AI记住旧技能,必须不断收集和存储每个任务的专门样本,这就像一个学生要想记住所学的每门课程,就必须保留每门课的所有笔记和练习题。但哈工大团队发现,只要有一份"通用备忘录"——也就是那一千个普通文本样本——就足够了。

这些普通文本样本就像是AI的"营养均衡餐"。正如人体需要各种营养素来维持健康一样,AI也需要多样化的文本内容来保持其语言理解能力的完整性。研究团队从SlimPajama-627B这个大型文本数据集中随机抽取了一千个样本,这些样本涵盖了各种主题和写作风格,从健身建议到动物百科,从商业描述到技术文档,应有尽有。

更加精妙的是,研究团队不仅仅是简单地让AI重复学习这些样本,而是开发了一种全新的"神经激活状态约束优化方法",他们称之为阈值边际损失(TM)。这个方法的核心思想是监控AI大脑中神经元的激活状态,确保在学习新任务时这些状态保持稳定。

把这个过程比作调音师调节钢琴。钢琴有很多琴弦,每根弦都有其特定的音调。当钢琴师弹奏不同曲子时,不同的琴弦会被触发。如果某些琴弦的音调发生了漂移,整个钢琴的和声就会变得不协调。TM损失就像一个精密的调音器,它时刻监控着AI"大脑"中每个"琴弦"(神经元)的状态,确保它们在学习新曲子(新任务)时仍然保持原有的音调(激活模式)。

研究团队的实验设计极其严密。他们选择了Llama-3.1-8B这个拥有80亿参数的大语言模型作为实验对象,让它依次学习15个不同的下游任务。这些任务涵盖了情感分析、自然语言推理、文本分类等多个领域,就像让一个学生连续学习语文、数学、物理、化学等不同学科。

实验结果令人振奋。传统的持续学习方法在面对这15个任务时表现得非常糟糕:不使用任何防遗忘措施的基线方法,在MMLU(一个衡量AI常识能力的标准测试)上的得分从66.5分暴跌到38.3分,平均任务表现也从理想的81.0分下降到37.5分。这就像一个原本成绩优秀的学生,在学习新课程后反而连基础知识都忘记了。

但使用GeRe框架的AI表现截然不同。在全参数微调设置下,它不仅将MMLU得分维持在60.7分的高水平,15个任务的平均表现也达到了74.4分。在LoRA(一种参数高效的微调方法)设置下,表现更加出色:MMLU得分保持在66.3分,任务平均表现为64.4分。

这些数字背后蕴含着深刻的意义。GeRe方法证明了一个重要理论:维护AI的通用能力本身就能促进特定任务的表现。这就像一个拥有扎实基础知识的学生,在学习新学科时往往能够触类旁通,表现更加优异。

研究团队还发现了一个有趣的现象。他们通过优化景观可视化技术分析了不同方法在训练过程中的行为。结果显示,GeRe方法具有更好的鲁棒性,就像在崎岖山路上行驶的越野车,它能够在各种复杂地形上保持稳定,而传统方法则像普通轿车,在遇到路况变化时容易失控。

特别值得一提的是,GeRe方法对学习率这个关键参数表现出了惊人的鲁棒性。学习率就像驾驶时的油门,踩得太轻学不到新知识,踩得太重又容易忘记旧知识。传统方法需要精心调节这个参数,稍有不慎就会导致性能急剧下降。但GeRe方法即使在学习率增加3到10倍的情况下,仍能保持稳定的性能表现。

研究团队还通过大量的对比实验验证了TM损失的优越性。他们比较了多种不同的回放策略,包括简单的标签拟合、基于KL散度的逻辑模仿、基于L1/L2损失的特征模仿等。结果表明,TM损失在各种设置下都能取得最佳性能,展现出更好的鲁棒性和泛化能力。

这项研究的意义远超学术范畴。在实际应用中,大语言模型需要不断适应新的领域和任务。比如,一个客服AI可能需要从处理一般咨询逐步扩展到处理技术支持、投诉处理、销售咨询等多个专业领域。传统方法要求为每个新领域专门收集和存储大量训练样本,不仅成本高昂,还面临数据隐私和存储空间的限制。

GeRe方法的出现彻底改变了这种状况。它只需要一次性准备一千个通用文本样本,就能支持模型在任意多个任务上的持续学习。这就像拥有了一把万能钥匙,能够打开所有领域的大门。

从技术实现角度来看,GeRe方法也展现出了极强的实用性。研究团队提供了完整的开源代码和数据,任何研究者或开发者都可以轻松复现和应用这项技术。更重要的是,这种方法不依赖于特定的模型架构或训练框架,具有很好的通用性。

当然,这项研究也有其局限性。一千个样本虽然相对简单,但如何选择这些样本仍然需要一定的技巧。研究团队使用的是随机抽样方法,但在特定应用场景下,可能需要更加精心的样本选择策略。此外,虽然GeRe方法在多个基准测试上表现优异,但在更加复杂和多样化的实际应用中的表现还需要进一步验证。

展望未来,这项研究为大语言模型的持续学习开辟了新的道路。随着AI技术的快速发展,我们有理由相信,未来的AI系统将能够像人类一样,在不断学习新知识的同时保持已有能力,实现真正意义上的终身学习。

说到底,哈工大团队的这项研究不仅解决了一个重要的技术难题,更重要的是,它证明了简单往往比复杂更有效。一千个普通的文本样本,配合巧妙的算法设计,就能让AI获得近乎人类的学习能力。这种"以简驭繁"的智慧,或许正是人工智能发展的正确方向。

Q&A

Q1:GeRe框架具体是怎么工作的?为什么只需要一千个样本?

A:GeRe框架的核心是使用一千个从互联网随机收集的普通文本作为"营养均衡餐",在AI学习新任务时同时让它复习这些通用样本。这些样本就像维生素,能保持AI的基础能力不退化。之所以一千个就够,是因为这些样本覆盖了足够多样的语言模式和知识领域,能够维持AI神经网络的整体平衡状态。

Q2:阈值边际损失(TM)比传统方法好在哪里?

A:TM损失就像一个精密的调音器,它不是简单地要求AI完全复制旧的输出,而是监控AI大脑中神经元的激活状态,只要这些状态保持在合理范围内就行。这比传统的L1/L2损失更加灵活,避免了过度严格的约束,让AI在学习新知识时有更大的适应空间,同时又不会偏离太远。

Q3:这项技术对普通用户使用AI产品有什么影响?

A:这项技术最直接的影响是让AI产品更加稳定可靠。以后你使用的AI助手在学会新技能后不会忘记基本常识,比如一个AI客服在学会处理技术问题后仍然能够进行正常的日常对话。对AI公司来说,这大大降低了维护成本,因为不需要为每个新功能都收集大量专门的训练数据。

好文章,需要你的鼓励

-

南方科技大学等机构联手破解AI推理训练难题:让大模型"一次思考"就学会解题

本文介绍了由南方科技大学等机构于2026年4月发表的研究(arXiv:2604.08865),提出了名为SPPO的大模型推理训练新方法。该方法将推理任务重新建模为"序列级情境赌博机",用一个轻量级价值模型预测题目难度,以单次采样替代GRPO的多次采样,解决了标准PPO的"尾部效应"问题。实验显示,SPPO在数学基准测试上超越GRPO,训练速度提升约5.9倍,配合小尺寸价值模型还能显著降低显存占用。

-

香港科技大学数学系研究者:扩散模型原来是一个"魔法恒等式"拆成了两半

这项由香港科技大学数学系完成的研究(arXiv:2604.10465,2026年ICLR博客论文赛道)提出了一种从朗之万动力学视角理解扩散模型的统一框架。研究指出,扩散模型的前向加噪和逆向去噪过程,本质上是朗之万动力学这一"分布恒等操作"被拆成了两半。在这个视角下,VP、VE-Karras和Flow Matching等不同参数化的模型可被精确互译,SDE与ODE版本可被统一解释,扩散模型相对VAE的理论优势得以阐明,Flow Matching与得分匹配的等价性也得到了严格论证。

-

中国人民大学研究团队打造的"AI科学家":让机器自主完成几十小时的科研工程,它是怎么做到的?

中国人民大学高岭人工智能学院等机构联合开发了AiScientist系统,旨在让AI自主完成机器学习研究的完整工程流程,包括读论文、搭环境、写代码、跑实验和迭代调试,全程无需人工干预。系统核心设计是"薄控制、厚状态":由轻量指挥官协调专业代理团队,通过"文件即通道"机制将所有中间成果持久化存储,使每轮工作都能建立在前一轮积累的基础上。在PaperBench和MLE-Bench Lite两个基准上,系统表现显著优于现有最强对比系统,论文发布于2026年4月。

-

字节跳动发布GRN:像人类画家一样"边画边改"的AI图像生成新范式

这项由字节跳动发布的研究(arXiv:2604.13030)提出了生成式精化网络(GRN),一套模仿人类画家"边画边改"直觉的视觉生成新框架。其核心包括两项创新:层级二进制量化(HBQ)通过多轮二分逼近实现近乎无损的离散图像编码,以及全局精化机制允许模型在每一步对整张图像的所有位置重新预测并随时纠错,从根本上解决了自回归模型的误差积累问题。配合基于熵值的自适应步数调度,GRN在ImageNet图像重建(rFID 0.56)和生成(gFID 1.81)上均创下新纪录,并在文本生成图像和视频任务上以20亿参数达到同等规模方法的领先水平。