6G灵魂拷问:“更快更好”之外,我们真正要什么?|对话InterDigital副总裁

作者|周雅

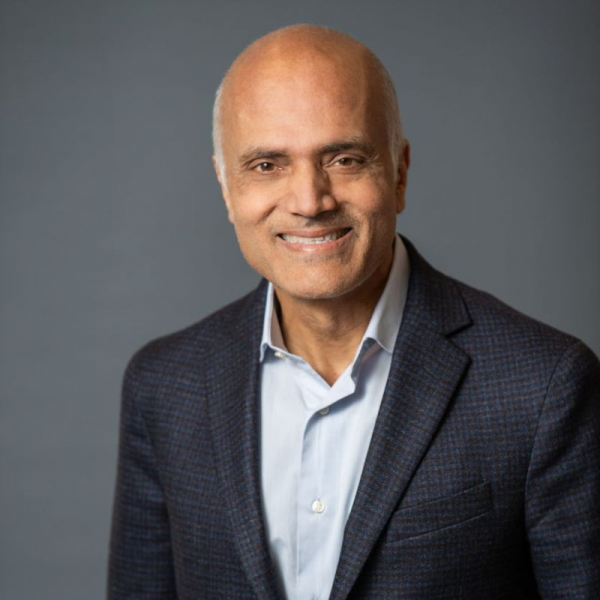

在今年MWC上海的间隙,我们见到了InterDigital副总裁兼无线实验室负责人Milind Kulkarni。InterDigital在无线通信圈发展了半个多世纪,是每年MWC在巴塞罗那的常客,此次是多年之后重返上海站。

第一次赴会,Milind讲了他的直观感受:“AI成为了通信的主旋律,从运营商到设备商,无人不谈AI,无人不展示AI。”

他的感受,也是整个行业的缩影。当AI从云端到终端重塑每一个产业时,通信,这个“连接一切”的底层基础设施,正站在十字路口,浮现更深层的问题:当我们谈论6G时,我们到底在谈什么?

带着这些疑问,我们与Milind Kulkarni开启了这场深度对话。Milind本人在无线通信领域驻扎超过30年,亲历了从2G到5G的完整演进,举手投足间透着对技术的乐观且严谨,为我们揭示了6G背后真正值得深思的本质、挑战与终极愿景。

InterDigital副总裁兼无线实验室负责人Milind Kulkarni

时间的齿轮:从5G到6G的路线图

“2025年是6G发展的关键之年。” Milind开门见山。

这一判断,源于全球标准化组织紧锣密鼓的行动。在过去四五年间,InterDigital作为6G Symposium最早的创立者之一,与产学研各方共同推动6G的早期研发。

当下,ITU正在界定6G的需求,3GPP在3月份召开了6G研讨会,在5月份又启动了6G的专项研究项目,照此进度,Milind预计,业界到今年年底对6G的范围将有一个更明朗的共识。

或许多数人才留意到手机信号格上出现的“5G-A”小标识,怎么突然6G就来了,这条路将如何铺?Milind的答案将其拆解为两个维度:一个是时间线,另一个则是技术本身。

从时间线来看,移动通信网络十年一代,但是在每一代之间,都会有更新版本出炉。这些小的更新并不总会被部署,但它们才是真正的预言家,其所预言的某个新特性,才是撬动哪个新应用、挖掘出哪个新场景的关键点。

以5G为例。5G的演进从Release 15-20共有6个阶段,前三个阶段是5G的上半场,后三个阶段是5G的下半场(它被命名为5G-Advanced,即5G-A)。其中,Rel-15和Rel-18,分别作为承上启下的关键演进,自然有它的关键之处。

比如,Rel-15到Rel-17不仅将5G推向市场,还在多个关键领域逐步增强了5G并进行了扩展:第一,对5G的商用特性进行改进,例如提升上行业务信道覆盖能力和定位精度,降低能耗;第二,拓展了5G的应用场景,比如NR-Light (5G RedCap)、非地面网络(NTN)等,可用在工业、可穿戴、物流等场景;第三,探索新方向,比如Rel-17首次探索了5G空口与AI技术的融合。

同理,我们再来看Rel-18到Rel-20。承上之处,它将包含5G到5G-A的演进;启下之处,它也涵盖了6G的技术研究。Rel-20的工作将持续到2027年第二季度,之后6G的规范化工作将拉开序幕。“Rel-21,将是第一个纯粹的6G标准版本,它的发布时间将在2029-2030年之间。”Milind指出。

从技术本身来看,6G并非凭空而来,而是站在5G肩膀——增强型移动宽带(eMBB)、超高可靠低时延通信(uRLLC)和海量机器类通信(mMTC)之上的进化与跃迁。 一些在前代技术播下的种子,将在6G时代开花结果:例如持续增强的多输入多输出(MIMO)天线技术,自3G时代萌芽,将在6G迎来新一轮演进;扩展现实(XR)是虚拟现实(VR)、增强现实(AR)和混合现实(MR)的总称,起始于5G,将在6G时代得到增强以支持多种模态;同样始于5G的地面网络与非地面网络(NTN)之间的深度融合也将延续;此外,我们在6G也会看到「能效」方面的持续改进,这一改进始于4G时代为3G系统提供解决方案。。

以上这些演进技术固然重要,但更吸睛的,是将真正定义6G的“新物种”,比如——AI和通信感知一体化(ISAC)。(我们在下文会细讲)

Milind说:“3GPP正在深入研究如何在网络不同层级应用AI。例如,传统的AI可能会在物理层学习和预测信道性能方面发挥作用;生成式AI可能有助于核心网络中的策略学习和生成;代理式AI可以在服务层为应用采取自主行动。毫无疑问,AI的使用将产生大量数据,并需要对模型进行生命周期管理。这将引发了一些重要问题,比如谁去训练模型、用什么数据来训练模型、公司是否会分享模型等,这些问题只为了一个目的,就是在6G时代更有效的、更高效的使用AI。”

5G的反思与6G的瘦身

在探讨6G的新能力之前,我们将话题引向一个更现实的问题:我们从5G的部署中学到了什么?

Milind坦言,我们在设计6G时,必须汲取5G的经验与教训,而最大的教训就是——成本!

“许多运营商抱怨,他们为5G基础设施投入了巨额资金,却很难收回成本。”Milind一针见血地指出。尽管5G在消费市场的普及速度很快,但运营商的投资回报率(ROI)似乎并未解决。

因此,6G设计的核心需要遵循一个原则:“我们必须为运营商降低总体拥有成本(TCO),包括资本开支(CAPEX)和运营开支(OPEX)。”

要搞清楚这个问题之前,我们必须了解,运营商想要什么?根据InterDigital赞助的TelecomTV《定义6G网络》 系列报告,基于今年3月份的3GPP 6G研讨会上收到的220余份提案,其中分析了30家网络运营商提交的64份文件,梳理并识别了运营商对于行业标准化的诉求。他们的优先诉求包括:

· 从第一天起,就采用6G独立(SA)架构,而不是非独立选项;

· 优先考虑可持续性和能源效率作为设计原则;

· 确保第一天的语音服务支持;

· 通过最大限度地减少部署选项和功能重叠,来简化标准化;

· 多RAT频谱共享(MRSS)被视为一条重要的迁移路径;

· 一种偏好正在出现,是采用5G核心进化方法,而不是设计一个新的6G核心。

除了运营商之外,在通信生态链中,供应商也是关键的一环。《定义6G网络》 系列报告同样梳理了“供应商想要什么”,其中就包括这些心声:能源效率、明确的AI/ML框架、确保5G的迁移路径等建议。

综合这些建议,Milind说,三个维度的“效率”被6G提上日程:

1、提高能效:“我们在设计6G时,第一个要优化的就是能效”。

2、提高频谱效率:必须帮助运营商更高效地利用宝贵的频谱资源。

3、提高运营效率:通过保持设计的简洁性并尽可能多地使用自动化来减少运营开销,将有助于减少运营成本。

换言之,与前几代相比,大家更重视用户体验和运营效率,精简部署、降低复杂性、改善能耗表现、开发“超越通信”的新能力和新商业模式,这些要素共同驱动6G发展。

这一切,最终指向了一个颠覆性的设计理念——化繁为简。

“5G的设计是高度可配置、灵活度极高的,但这最终导致了整个网络变得异常复杂。” Milind反思道。

所以,6G必须做出改变。“我们需要重新构想6G,不是将其作为一个定制的网络,而是一个由可互操作组件构成的模块化系统。”Milind指出,这种转变,是为了让网络更易于扩展,也更加简化。

这番话的背后,是一个清醒的认知:技术上的“无所不能”,有时恰恰是商业上的“不能承受之重”。6G若想避免重蹈5G商业困境的覆辙,就必须从源头上为网络“瘦身”,敢于做出果断、甚至强制性的设计决策。

InterDigital副总裁兼无线实验室负责人Milind Kulkarni参与MWC上海2025

通感一体化:当网络长出眼睛和耳朵

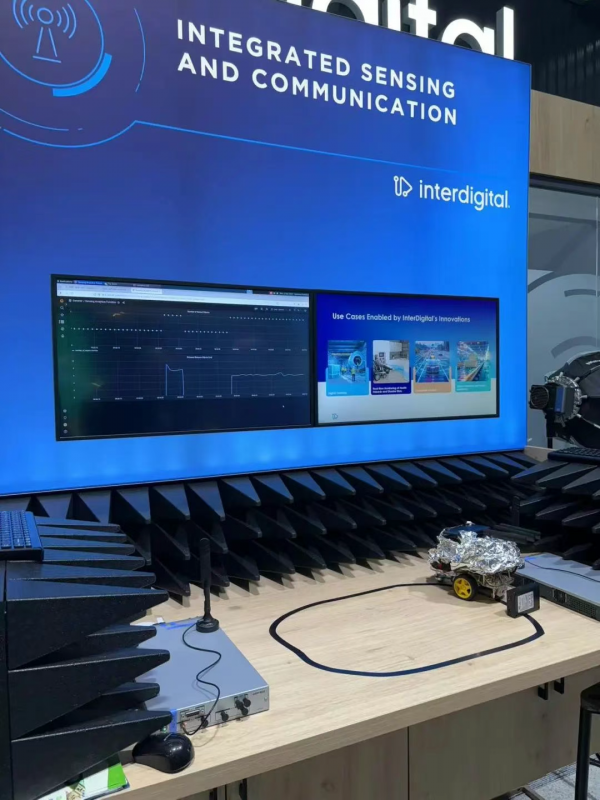

如果说“精简”是6G的务实底色,那么“超越通信”的能力,则是其最激动人心的一抹亮色。这里,通信感知一体化(ISAC)被Milind反复提及。

InterDigital于MWC25巴塞罗纳展示的ISAC技术

“一直以来,通信网络的角色都比较单一,就是传输信息。”Milind解释道,“但在6G时代,网络中的每一个组件——从你口袋里的手机,到街角的基站——它们的天线,都将扮演雷达的角色。”

通感一体化的工作原理是什么?

?“想象一下,你的手机发出信号,在这个房间里,信号碰到我、碰到你、碰到灯,然后反弹回来。”他举例说道,“通过分析这些回波,系统就能知道房间里物体的精确位置和形态。”

基于这些感知信息,我们可以构建整个房间、整座工厂、甚至整座城市的“数字孪生”。

“万一,某个人不小心摔倒了,” Milind继续举例,“系统可以立刻识别出‘有人跌倒’这个异常事件,并自动向急救中心或他家人发送求救信号。”

这仅仅是冰山一角。从智能家居、智慧城市,到我们今天的全新应用,ISAC让网络从一个被动的“信息管道”,进化成一个主动的“环境传感器”。更重要的是,它为运营商开辟了全新的盈利渠道,让他们终于有机会摆脱“流量管道工”的宿命。

而当AI与ISAC结合,这幅图景变得更加强大。在今年的巴塞罗那MWC上,InterDigital与是德科技合作,展示了一个“AI驱动的动态感知系统”。通过创建餐厅里的“射频数字孪生(RF Digital Twin)”,并用它训练AI模型,该系统不仅能检测到房间里是否有人,还能以约17厘米的精度,实时追踪这个人的移动轨迹、速度,甚至预测他是站着、行走还是即将跌倒。该技术可以用在诸如:健康风险和危害的实时监测、灾害情景以及互联汽车等各种场景。

InterDigital与是德科技联合展示的AI驱动的动态感知技术

这就是6G“超越通信”的冰山一角。网络不再仅仅连接你我,它开始理解我们所处的世界。

“AI原生”的6G:是终极答案,还是潘多拉魔盒?

看到这里不难发现,贯穿所有6G讨论的核心,始终是AI。业界有一个普遍的共识:6G必须是一个“AI原生”的网络。但问题在于,究竟什么是“AI原生”?

“到目前为止,AI原生的6G网络还没有业界公认的定义。”Milind坦言。

但根据他的理解,AI原生并非某个单一技术,而是一个全新的框架。这个框架的核心,是围绕“数据”进行重构,以允许整个网络更有效地使用AI。在这个范式中,我们需要将AI视为一种能够使网络更高效的工具(AI for 6G),以及网络中可供AI应用使用的数据可用性(6G for AI)。

“AI模型需要海量数据进行训练,而网络中的感知和应用又会生成海量数据。”他指出了问题的关键,“我们必须建立一个高效的数据管理体系:如何收集、存储、传输和使用这些数据?如何让内部数据与外部生态安全地协同?”

这些问题,远比想象中复杂。它涉及到模型的所有权、数据集的隐私与共享、训练的地点与方式……3GPP正在就这些问题进行深度研究,因为只有想清楚这一切,才可能真正设计出一个“AI原生”的新架构。

智能眼镜的复兴之路

当网络的底层能力发生质变,上层的应用生态也将迎来新生。其中,沉浸式体验(如AR/VR/XR)被寄予厚望。

谷歌眼镜在十多年前的失败,与如今在AI大模型加持下的“复活”,似乎预示着一个新时代的到来。6G的超大带宽和超低延迟,能否让智能眼镜最终成为主流的杀手级应用?

Milind对此有更细致的理解。他认为,我们通常混淆了两种不同的技术路径。

第一种,是真正的“沉浸式体验”,如VR游戏或观看体育赛事。 “我们所说的沉浸式,是指你从‘观看’视频,到‘走进’视频之中。”他解释说。这种体验,往往涉及到海量的多模态数据,如超高清视频、空间音频、甚至触觉反馈,需要从云端下载到本地设备。“因此,它对网络下行链路的能力要求极高。”

第二种,则是以Meta、雷朋为代表的“智能眼镜”,其核心是“移动AI”。 “当我戴着眼镜看一幅画,想知道它的来历时,我必须将眼前的图像信息上传到云端,再从云端接收答案。”他指出,“这个过程,对网络上行链路的能力要求极高。”

随着这类应用的普及,网络中上行流量将迎来爆炸式增长。“所以在6G时代,我们将针对「上行能力」进行重点研究,其强度将远超以往任何一代技术。”

这一“上下行之辩”,精准地揭示了不同应用场景对网络能力的差异化需求。而根据InterDigital与Futuresource Consulting联合发布的白皮书预测,到2031年,XR设备出货量将达到8300万台,6G的部署周期将与XR生态的成熟期完美契合,一个由6G驱动的、拥有1.3亿台设备的XR市场正在向我们走来。

一个“隐形冠军”的漫长征途

在长达一个多小时的对话中,Milind的自信与洞察,源于他背后那家拥有超过半个世纪历史的公司——InterDigital。

InterDigital在德克萨斯州奎特凯建成了全球首个无线电话系统

对于许多中国用户来说,这个名字可能不如其他友商响亮,但事实上,这家公司的历史可以追溯到1972年。其创始人甚至在摩托罗拉之前,就开发出了无线手持电话的原型机。从2G到5G,从TDMA到CDMA,从与诺基亚、三星的技术合作,到收购Technicolor的视频研发部门,InterDigital的身影贯穿了整个现代移动通信史。在过去的十年里,InterDigital的创新已经连接并赋能了全球超过80亿台设备。

“我们有什么独特之处?”Milind总结道,“很少有公司能像我们一样,在无线、视频和AI这三个领域都拥有强大的研发能力。我们三个实验室密切合作,为整个市场和全球客户提供解决方案,这也是小米、OPPO、vivo等众多中国客户信赖我们的原因。”

从经历一家公司的漫长历史,到身为一个技术专家的漫长职业生涯,Milind见证了技术的无数次迭代与更迭。我问他,在这漫长的演进中,有什么启示和永恒不变的真理?

“每一代技术,都站在前一代的肩膀上。”他说,“1G是模拟,2G数字化了声音,3G加入了数据,4G拥抱了视频,5G更快更好。而6G,将在具备这一切的基础上,加入感知、AI和沉浸式能力。网络,不可避免地变得越来越复杂。”

“所以,唯一不变的真理是什么?”

“保持简洁。” 他的回答毫不犹豫。

“如果我们不保持简洁,我们将面临一个庞大到无法运营、无法在全球保持互操作性的复杂巨兽。简洁,是贯穿始终的真理。”他补充道,“还有一点,就是合作。技术的成功,离不开产业各方基于共识的、不受过多外部干预的中立合作。”

在对话的最后,我请他展望未来五年希望亲手推动实现的愿景。

他的回答,将我们从复杂的技术细节,拉回到了温暖而具体的生活场景:是让体育迷身临其境的沉浸式娱乐;是无论身处何地都能享受到的泛在连接;是让自动驾驶汽车更安全的道路;更是守护独居老人,防止他们意外跌倒或被侵入的智能卫士。

“6G带来的,将远不止于连接和通信能力的强大,”他总结道,“它带来的变化,将是全方位的。”

好文章,需要你的鼓励

-

AWS AI实验室发布EvalAgent:让AI自动给AI写"成绩单",但这件事比想象中难得多

AWS AI Labs研究团队发布EvalAgent,这是一套通过"评估技能"自动生成AI智能体评测方案的系统,将首次运行成功率从17.5%提升至65%,并在人类专家评测中获得79.5%的偏好选择。

-

给暗夜照片"开灯":亚历山大大学研究团队如何让AI用"深度感知"还原黑暗中的真实色彩

亚历山大大学提出M2Retinexformer,通过融合深度、亮度和语义三种辅助模态,让AI在增强暗光图像时兼顾几何结构与视觉自然度。

-

浙江大学与西湖大学联手破解AI模型适配难题:无需反向传播,一次正向扫描搞定任务适配

浙大、西湖大学等联合提出FAAST,无需反向传播,一次正向扫描将训练样本压缩为快速权重矩阵,推理时间和内存占用分别节省90%和95%以上。

-

慕尼黑工业大学造了一个"考官":用后见之明来测试AI医生,结果几乎全不及格

慕尼黑工业大学发布RealICU基准,用专家后见之明评测大语言模型在ICU实时决策中的真实能力,发现现有顶级AI存在有害推荐率过高和锚定偏差两大安全隐患。